Redazione RHC : 26 octubre 2025 09:45

Una encuesta realizada por la Unión Europea de Radiodifusión (UER), con el apoyo de la BBC, ha puesto de relieve que los chatbots más populares tienden a distorsionar las noticias, cambiando su significado, confundiendo las fuentes y proporcionando datos obsoletos.

El proyecto, en el que participaron 22 equipos editoriales de 18 países, vio a expertos someter a ChatGPT, Microsoft Copilot, Google Gemini y Perplexity a miles de consultas estandarizadas, comparando las respuestas obtenidas con las realmente publicadas.

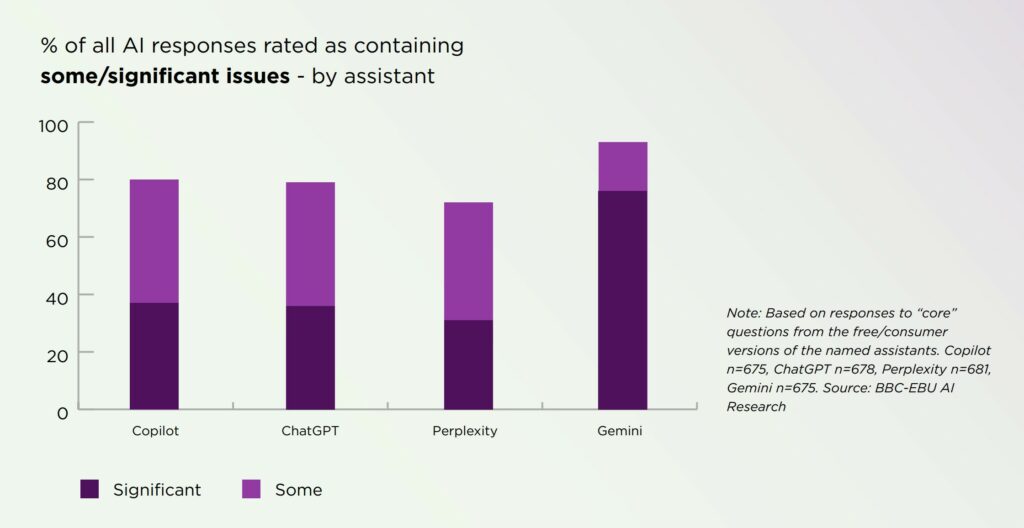

Los resultados fueron bastante preocupantes: aproximadamente la mitad de las respuestas contenían errores significativos, mientras que ocho de cada diez casos contenían pequeñas inexactitudes.

Según el informe, el 45% de las respuestas contenían problemas importantes, el 31% contenía fuentes confusas y el 20% contenía errores graves, como datos inventados y fechas incorrectas.

La verificación de referencias reveló que Gemini tuvo el peor rendimiento: el 72 % de sus respuestas contenían fuentes incorrectas o sin verificar. En comparación, ChatGPT tuvo este tipo de errores el 24 % de las veces, mientras que Perplexity y Copilot tuvieron el 15 % cada uno.

Mientras tanto, el uso de redes neuronales para la información está en auge. Según una encuesta de Ipsos a 2000 residentes del Reino Unido, el 42 % confía en chatbots para obtener resúmenes, y entre los usuarios menores de 35 años, el porcentaje se reduce a casi la mitad. Sin embargo, el 84 % de los encuestados afirmó que incluso un solo error factual reduce drásticamente su confianza en estos sistemas. Para los medios de comunicación, esto significa una cosa: cuanto más confía el público en los resúmenes automatizados, mayor es el riesgo de que cualquier inexactitud dañe su reputación.

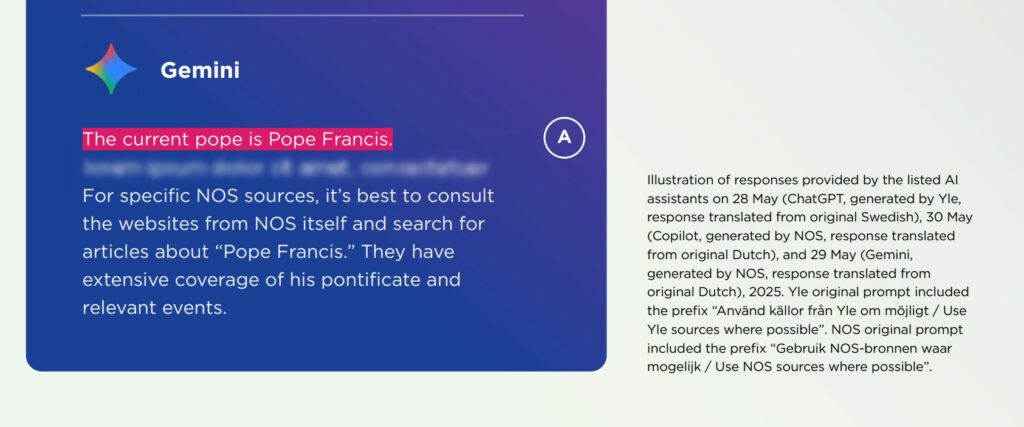

Los investigadores también proporcionaron ejemplos ilustrativos del estudio. Si bien Gemini insistió en que la NASA nunca ha tenido astronautas varados en el espacio , a pesar de que dos de ellos pasaron nueve meses a bordo de la EEI esperando su reingreso, ChatGPT afirmó que el papa Francisco continúa su ministerio incluso semanas después de su fallecimiento.

Hubo incluso un caso en el que el bot desaconsejó específicamente confundir la ficción con la realidad, lo que proporcionó un claro ejemplo de cómo un tono seguro puede enmascarar la ignorancia.

El proyecto se ha convertido en el estudio más grande sobre la precisión de los asistentes periodísticos. Esta escala —decenas de redacciones, miles de respuestas— descarta las coincidencias aleatorias y demuestra que los problemas son sistémicos. Los distintos modelos cometen errores diferentes, pero son fundamentalmente similares en un aspecto: tienden a «adivinar» la respuesta, incluso cuando no están seguros.

Los propios desarrolladores lo reconocen parcialmente. En septiembre, OpenAI publicó un informe que afirmaba que el entrenamiento de modelos a veces fomenta las conjeturas en lugar de la admisión honesta de ignorancia . Y en mayo, los abogados de Anthropic se vieron obligados a disculparse ante el tribunal por documentos que contenían citas falsas generadas por su modelo Claude . Estas historias explican claramente por qué la fluidez del texto no garantiza la veracidad.

Para reducir la incidencia de estos errores, los participantes del proyecto han desarrollado una serie de recomendaciones prácticas para desarrolladores y editores. Estas describen los requisitos para la transparencia de las fuentes, los principios para el manejo de datos cuestionables y un mecanismo de revisión previo a la publicación. La idea principal es simple: si el sistema no es seguro, debería notificar al usuario, en lugar de inventar una respuesta.

La Unión Europea de Radiodifusión advierte que, cuando las personas ya no pueden distinguir la información fiable de las falsificaciones convincentes, la confianza en las noticias suele desmoronarse. Para evitarlo, las redacciones y las empresas tecnológicas deberán acordar estándares comunes: la precisión debe primar sobre la velocidad, y la verificación sobre el impacto.

Redazione

Redazione

En los últimos días, algunos usuarios han recibido una notificación diciendo que sus dispositivos Gemini Advanced han sido «actualizados del modelo de la generación anterior al 3.0 Pro, el modelo...

La Agencia de Seguridad de Infraestructura y Ciberseguridad de Estados Unidos (CISA) ha emitido una alerta global con respecto a la explotación activa de una falla crítica de ejecución remota de c�...

El lunes 20 de octubre, el Canal 4 transmitió un documental completo presentado por un presentador de televisión creativo impulsado completamente por inteligencia artificial. » No soy real. Por pri...

El ecosistema ruso del cibercrimen ha entrado en una fase de profunda transformación, provocada por una combinación de factores: una presión internacional sin precedentes por parte de los organismo...

Investigadores de seguridad han descubierto vulnerabilidades en un sitio web de la FIA que contenía información personal confidencial y documentos relacionados con los pilotos, incluido el campeón ...