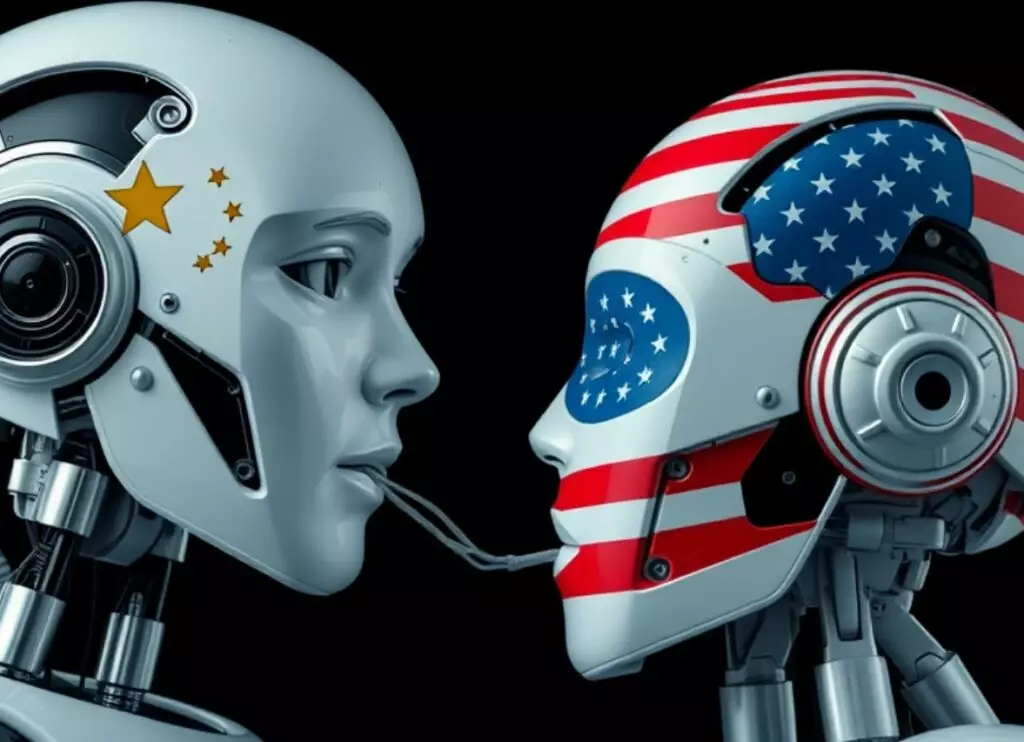

OpenAI ha affermato di aver trovato prove del fatto che la startup cinese DeepSeek stava utilizzando i suoi modelli proprietari per addestrare il proprio concorrente open source. Ciò solleva preoccupazioni circa la possibile violazione della proprietà intellettuale.

Secondo il Financial Times, OpenAI sospetta che DeepSeek abbia utilizzato una tecnica chiamata “distillazione”, un processo in cui vengono utilizzati modelli più potenti per migliorare l’efficienza delle controparti più piccole. Sebbene questo metodo sia comune nel settore, OpenAI ritiene che l‘azienda cinese abbia violato i termini della propria piattaforma creando la propria IA competitiva.

“Il problema inizia quando si utilizza il modello non solo per lavorare, ma per creare il proprio analogo”, ha detto una fonte vicina a OpenAI. La società non ha rivelato i dettagli dell’indagine, ma le sue regole vietano i servizi di copiatura e l’utilizzo dei loro risultati per sviluppare soluzioni concorrenti.

DeepSeek ha suscitato scalpore nel mercato con il suo nuovo AI R1, che ha mostrato risultati paragonabili ai principali modelli americani. La sua formazione è costata solo 5,6 milioni di dollari e ha utilizzato 2.048 schede video Nvidia H800, significativamente meno di OpenAI e Google.

Questa notizia ha avuto un grave impatto sul mercato: le azioni Nvidia sono crollate del 17%, provocando una perdita di capitalizzazione di 589 miliardi di dollari. Tuttavia, martedì il tasso ha recuperato parte delle perdite, aumentando del 9%.

OpenAI e il suo partner Microsoft lo scorso anno hanno bloccato gli account presumibilmente associati a DeepSeek per aver violato i termini. Gli esperti notano che l’utilizzo delle risposte di ChatGPT e di altre popolari IA per addestrare nuovi modelli è diventata una pratica standard tra le startup.

“Molte aziende e ricercatori stanno adottando modelli commerciali già addestrati su dati incentrati sull’uomo per risparmiare su questo passaggio”, ha spiegato Ritwik Gupta, ricercatore dell’Università della California, Berkeley. OpenAI, a sua volta, afferma che sta adottando contromisure contro tali azioni e sta anche lavorando a stretto contatto con le autorità statunitensi per proteggere la sua tecnologia dai concorrenti.

In particolare, la stessa OpenAI è sotto pressione a causa delle accuse di violazione del copyright: il New York Times e numerosi scrittori hanno citato in giudizio la società per aver utilizzato i loro materiali senza autorizzazione.

Parlare di “furto di proprietà intellettuale” da parte di DeepSeek nei confronti di OpenAI risulta fuorviante se si considera che l’IA di OpenAI stessa è stata addestrata su una vasta quantità di dati disponibili sul web, molti dei quali protetti da copyright. OpenAI è già al centro di numerose cause legali, per l’uso non autorizzato di contenuti giornalistici, e altre azioni intentate da scrittori ed editori che accusano l’azienda di aver sfruttato le loro opere senza consenso. Questo solleva una questione etica: può un’azienda che ha costruito il proprio modello su informazioni protette rivendicare una violazione della proprietà intellettuale quando un’altra realtà utilizza le sue stesse tecniche?

Inoltre, la pratica della “distillazione” – che OpenAI ora contesta – è comunemente impiegata nell’industria dell’IA per migliorare l’efficienza dei modelli più piccoli attraverso l’apprendimento da quelli più avanzati. OpenAI stessa, come molte altre aziende del settore, ha beneficiato di metodologie simili per affinare le proprie tecnologie.

Se DeepSeek ha effettivamente usato ChatGPT per addestrare la propria IA, la questione non è tanto la violazione di un brevetto o un furto, quanto piuttosto il problema più ampio della regolamentazione nell’uso dei dati per l’addestramento dell’intelligenza artificiale. In un settore che ancora fatica a definire limiti chiari, il caso OpenAI vs DeepSeek sembra più una battaglia per il controllo del mercato che una reale difesa della proprietà intellettuale.