IaB: Condannato a 6 anni e mezzo di carcere per aver facilitato gli attacchi ransomware

Sintesi: Aleksei Volkov, cittadino russo di 26 anni, è stato condannato a 81 mesi di carcere federale negli Stati Uniti dopo aver ammesso di aver fornito accessi non autorizzati alle reti di aziende a...

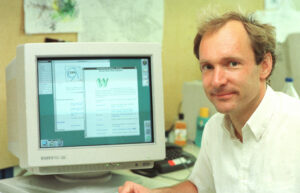

Il DLP non è il Grande Fratello: il problema è la progettazione

Il DLP funziona quando protegge dati classificati su canali selezionati con regole proporzionate. Fallisce quando monitora tutto. Il confine tra sicurezza e sorveglianza non lo traccia il prodotto: lo...

L’AI vuole entrare nell’energia nucleare: la tecnologia c’è, ma il vero ostacolo è nascosto

L’AI applicata all’energia nucleare promette di ridurre tempi e complessità nei processi di progettazione e permitting, ma i risultati attuali sono ancora parziali e circoscritti. Tecnologie come Digi...

OpenAI chiude Sora: il futuro dell’AI non è più Video! Scopriamo cosa sta accadendo

OpenAI ha chiuso Sora, la sua piattaforma di generazione video AI, a causa di scarsa monetizzazione, rischi legali legati al copyright e difficoltà nel controllo dei contenuti. L’azienda sposterà le r...

Il Ransomware è ora Democratico! TeamPCP e BreachForums assieme per elevare il RaaS

L’annuncio di una partnership tra BreachForums, il gruppo ransomware Vect e TeamPCP segnala una possibile evoluzione del cybercrime verso modelli aperti e scalabili. Se confermata, questa alleanza pun...

Attacco informatico all’ospedale Papardo di Messina. Urzì: La Sicilia sempre più esposta

Succede tutto in fretta. I sistemi si fermano e, nel giro di poco, l’intera macchina sanitaria inizia a rallentare fino a bloccarsi. All’ospedale Papardo di Messina è andata così, come riportato da Me...

Typosquatting: la trappola invisibile che svuota i conti con un refuso

Il typosquatting è una tecnica di cybercrime che consiste nel registrare domini web quasi identici a quelli di marchi famosi, sfruttando gli errori di digitazione degli utenti. L’obiettivo è dirottare...

Node.js rischia il crash remoto: aggiornamento urgente già disponibile

Il 24 marzo 2026, il team Node.js ha rilasciato una patch di sicurezza LTS per vulnerabilità critiche in TLS, HTTP/2 e Web Crypto. La falla CVE-2026-21637 può interrompere il processo via SNICallback,...

Pioggia di bug da Mozilla scoperti dalle AI. Tre da score 10 e 14 da 9.8

Non è uno di quegli aggiornamenti da rimandare a domani. Questa volta no. Con il rilascio della versione 149, qualcosa cambia davvero… e non in meglio, almeno per chi resta indietro. Parliamo di decin...

PornHub e la Click War: è sfida tra norme, sorveglianza di stato e VPN

E’ una trasformazione radicale quella che vede contrapposti i giganti dell’industria del sesso e i regolatori nazionali. Al centro della contesa non c’è il contenuto in sé, ma l’accesso ad esso. La “g...

Articoli più letti dei nostri esperti

Affida la migrazione ad un’AI ma l’agente cancella due anni e mezzo di dati su AWS

Cyber security e Critical National Infrastructure: il 93% è stato colpito negli ultimi 12 mesi

Redazione RHC - 27 Marzo 2026

Blind SQL Injection in Zabbix: minaccia reale e come bloccarla subito

Redazione RHC - 27 Marzo 2026

IaB: Condannato a 6 anni e mezzo di carcere per aver facilitato gli attacchi ransomware

Carolina Vivianti - 27 Marzo 2026

Il DLP non è il Grande Fratello: il problema è la progettazione

Matteo Di Pomponio - 27 Marzo 2026

Rete TELCO sotto assedio: BPFDoor è in scena per un attacco senza precedenti

Redazione RHC - 27 Marzo 2026

L’AI vuole entrare nell’energia nucleare: la tecnologia c’è, ma il vero ostacolo è nascosto

Bajram Zeqiri - 27 Marzo 2026

Gli attacchi informatici si evolvono: le API sono nel mirino degli aggressori

Silvia Felici - 27 Marzo 2026

Ransomware in evoluzione: il 57% delle aziende colpite, subisce una nuova estorsione

Carolina Vivianti - 27 Marzo 2026

OpenAI chiude Sora: il futuro dell’AI non è più Video! Scopriamo cosa sta accadendo

Carolina Vivianti - 26 Marzo 2026

Il Ransomware è ora Democratico! TeamPCP e BreachForums assieme per elevare il RaaS

Bajram Zeqiri - 26 Marzo 2026

Ultime news

Cyber security e Critical National Infrastructure: il 93% è stato colpito negli ultimi 12 mesi

Blind SQL Injection in Zabbix: minaccia reale e come bloccarla subito

Rete TELCO sotto assedio: BPFDoor è in scena per un attacco senza precedenti

Gli attacchi informatici si evolvono: le API sono nel mirino degli aggressori

Ransomware in evoluzione: il 57% delle aziende colpite, subisce una nuova estorsione

Una vulnerabilità Critica in Dell RecoverPoint Semina il Caos. Il malware GRIMBOLT in azione

Le minacce informatiche stanno cambiando: l’era degli attacchi guidati dall’IA è ora!

Tecnologia quantistica: acceleratore della rivoluzione digitale in Europa

CrackArmor: quando AppArmor smette di proteggere il kernel

Nuovo Kali 2026.1: tante nuove cose, ma la stabilità conta di più

Abbiamo perso il controllo dei robot domestici: migliaia di utenti spiati dentro casa

Apocalisse nello spazio: come l’AI potrebbe distruggere l’internet satellitare in 24 ore

Scopri le ultime CVE critiche emesse e resta aggiornato sulle vulnerabilità più recenti. Oppure cerca una specifica CVE