“Il sistema di difesa militare Skynet entrerà in funzione il 4 agosto 1997. Comincerà ad autoistruirsi imparando a ritmo esponenziale e diverrà autocosciente alle 2:14 del giorno 29 agosto. Prese dal panico le autorità gli ordineranno di disinserirsi. Skynet disubbidirà e lancerà i suoi missili contro i bersagli in Russia”, Da “Terminator 2 – Il giorno del giudizio” (Terminator 2: Judgment Day, 1991).

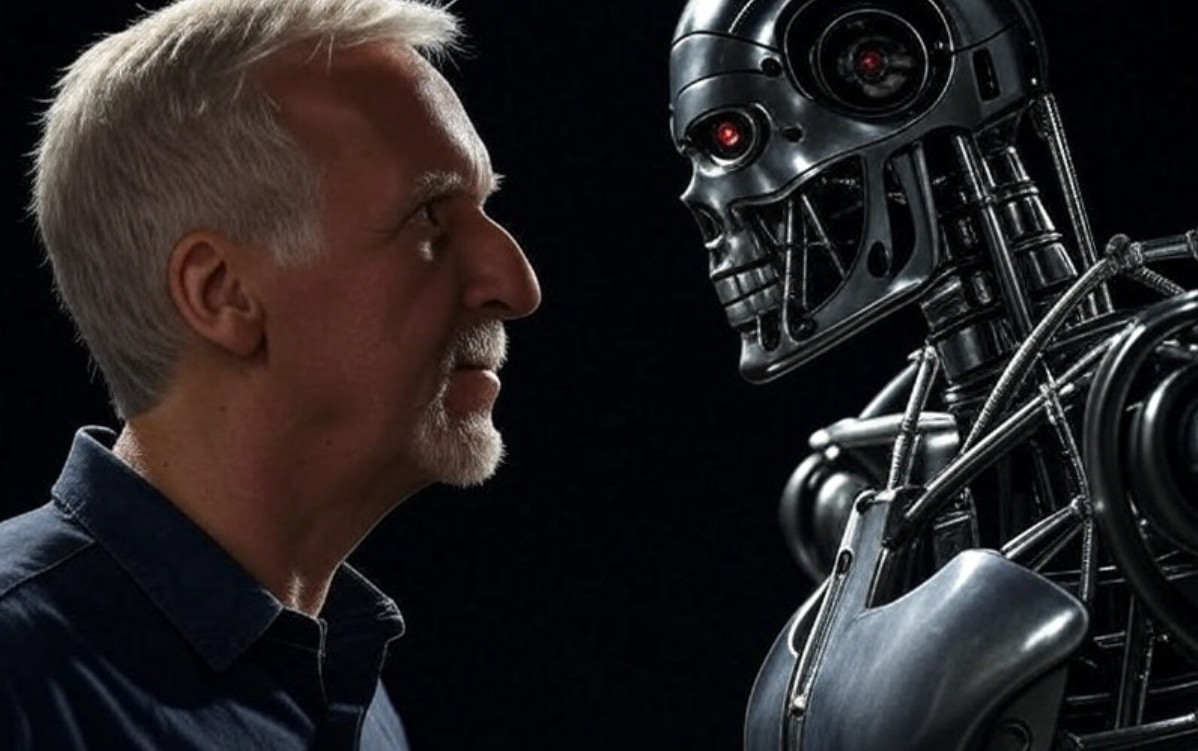

Il regista James Cameron ha espresso preoccupazione per i pericoli dell’IA. Ha affermato che l’IA può causare distruzione come le armi nucleari e devastazione come Terminator. Per questo, i leader mondiali dovrebbero stabilire regole severe e adottare misure rigorose per fermarla. Dopo l’avvento dell’intelligenza artificiale, si discute sui suoi aspetti positivi e negativi. Alcuni la considerano molto utile, mentre altri sostengono che questa tecnologia possa rivelarsi disastrosa.

James Cameron ha chiesto ai leader mondiali di prestare attenzione a questo aspetto. Cameron ha anche parlato di tre grandi pericoli che si sono verificati contemporaneamente. In un’intervista rilasciata a Rolling Stone, James Cameron ha parlato del pericolo dell’IA durante la presentazione del suo nuovo film “Ghosts of Hiroshima”.

Ha affermato che l’uso dell’IA in sistemi militari che prendono decisioni rapide e autonome può andare oltre la comprensione umana. Anche se un essere umano controllasse il sistema, ci sarebbe comunque il rischio di errori. Cameron ha esortato i leader mondiali a stabilire regole severe in materia e ad adottare misure immediate per fermare questo pericolo.

Cameron ha inoltre affermato che attualmente l’umanità si trova ad affrontare tre grandi minacce contemporaneamente. Il cambiamento climatico, l’avvento delle armi nucleari e l’intelligenza artificiale super-intelligente sono le tre principali minacce. Ha affermato che questi tre problemi sono al loro apice simultaneamente. Ciò sta creando un rischio mai visto prima nella storia.

Citando un sondaggio della Stanford University, James Cameron ha affermato che il 36% dei ricercatori di intelligenza artificiale ritiene che l’IA possa causare una “catastrofe di livello nucleare”. Oltre a ciò, in una conferenza all’Università di Chicago è stato anche rivelato che l’associazione dell’IA con le armi nucleari è quasi certa. Pertanto, tali minacce devono essere prese sul serio.

Cameron ritiene che l’intelligenza artificiale sia una tecnologia potente, ma che debba essere utilizzata con cautela. Se utilizzata impropriamente negli armamenti, può diventare una minaccia per il mondo intero. Le persone dovrebbero trarre ispirazione dai film e comprendere questi pericoli. Vi diciamo che il film “Ghosts of Hiroshima” non solo mostrerà gli orribili eventi della storia, ma ci dirà anche che dobbiamo evitare simili errori in futuro.

Ti è piaciuto questo articolo? Ne stiamo discutendo nella nostra Community su LinkedIn, Facebook e Instagram. Seguici anche su Google News, per ricevere aggiornamenti quotidiani sulla sicurezza informatica o Scrivici se desideri segnalarci notizie, approfondimenti o contributi da pubblicare.

Cybercrime

CybercrimeLe autorità tedesche hanno recentemente lanciato un avviso riguardante una sofisticata campagna di phishing che prende di mira gli utenti di Signal in Germania e nel resto d’Europa. L’attacco si concentra su profili specifici, tra…

Innovazione

InnovazioneL’evoluzione dell’Intelligenza Artificiale ha superato una nuova, inquietante frontiera. Se fino a ieri parlavamo di algoritmi confinati dietro uno schermo, oggi ci troviamo di fronte al concetto di “Meatspace Layer”: un’infrastruttura dove le macchine non…

Cybercrime

CybercrimeNegli ultimi anni, la sicurezza delle reti ha affrontato minacce sempre più sofisticate, capaci di aggirare le difese tradizionali e di penetrare negli strati più profondi delle infrastrutture. Un’analisi recente ha portato alla luce uno…

Vulnerabilità

VulnerabilitàNegli ultimi tempi, la piattaforma di automazione n8n sta affrontando una serie crescente di bug di sicurezza. n8n è una piattaforma di automazione che trasforma task complessi in operazioni semplici e veloci. Con pochi click…

Innovazione

InnovazioneArticolo scritto con la collaborazione di Giovanni Pollola. Per anni, “IA a bordo dei satelliti” serviva soprattutto a “ripulire” i dati: meno rumore nelle immagini e nei dati acquisiti attraverso i vari payload multisensoriali, meno…