Autore: Roberto Capra

Data Pubblicazione: 27/01/2021

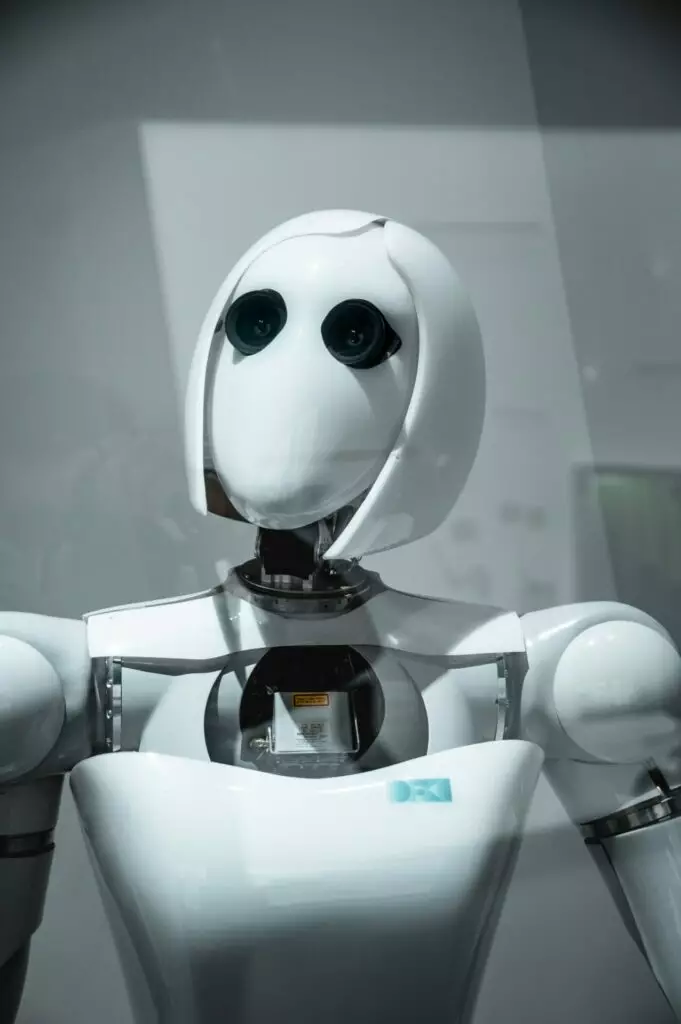

Le intelligenze artificiali, ovvero riproduzioni artificiali dell’intelligenza umana, ad oggi sono in via di sviluppo e per lo più progettate per compiti singoli. Non vi è alcun dubbio che, nel momento in cui si scrive, queste possano essere considerate come dei meri oggetti sottoposti allo stringente controllo di creatori ed utilizzatori.

Lo sviluppo di queste tecnologie continua incessantemente e si può ritenere ragionevolmente che lo sviluppo ci stia portando verso la “singolarità tecnologica”, cioè quel momento in cui lo sviluppo tecnologico consentirà di produrre macchine che eguaglieranno l’intelligenza umana, ma con il vantaggio di elaborare i dati in entrata (stimoli sensoriali e cognitivi) molto più velocemente rispetto al cervello umano.

È verosimile ritenere che, arrivando ad un tale punto di sviluppo tecnologico possano essere create intelligenze artificiali non specializzate in uno o più compiti, ma generaliste e dotate di una propria autonomia di pensiero.

In uno scenario di questo genere risulta quantomai opportuno chiedersi se queste “super-intelligenze” artificiali potranno mai essere in qualche modo equiparate agli esseri umani oppure se continueranno ad essere considerati oggetti, seppur iper-tecnologici.

In tal senso, almeno per quanto concerne l’Unione Europea, sono stati elaborati i primi orientamenti che vedono le IA come un’opportunità di sviluppo che possa mettere al centro la persona, richiedendo – altresì – che queste tecnologie vengano sviluppate in maniera “responsabile”.

L’elemento maggiormente caratterizzante le valutazioni è la consapevolezza

che lo sviluppo delle IA è inarrestabile e che questo avanzamento tecnologico può portare con sé grandi possibilità di progresso. Tale potenziale, tuttavia, non è esente da rischi e – proprio per questo motivo – sono in corso delle valutazioni che non tengono conto degli aspetti strettamente legati alle normative, ma anche degli aspetti etici legati alle IA ed al loro rapporto con l’ambiente circostante.

Partendo da questa consapevolezza, un gruppo di esperti – su incarico dell’UE – ha redatto un “White Paper” sull’intelligenza artificiale, pubblicato il 19 febbraio 2020.

Sin dalle primissime righe, viene evidenziato come le IA possano avere un grande impatto sulla società, ma comportino anche rischi potenziali, i quali dovranno essere il più possibile limitati mediante uno sviluppo rispettoso della dignità umana e della tutela della privacy.

Nell’ambito del paper vengono analizzati numerosi aspetti legati alle IA, sia dal punto di vista economico ed industriale che dal punto di vista normativo il quale – per rispondere alla domanda di inizio articolo – è quello fondamentale.

Nel paper, si riprende una comunicazione della Commissione Europea (COM(2019) 168 final) ove vengono fissati i requisiti fondamentali che dovranno rispettare queste intelligenze:

Da questo elenco, è possibile notare come queste tecnologie vengano viste come degli strumenti atti a migliorare la qualità della vita umana, evitando di interferire con essa più dello stretto necessario per lo svolgimento del compito assegnato e rimanendo

costantemente sotto il controllo umano.

Inoltre, queste tecnologie dovranno rispettare il principio di “trasparenza”, inteso non solo come spiegazione esplicita dei compiti ad esse di volta in volta demandati, ma anche come

dichiarazione esplicita di come l’IA tratterà i dati personali eventualmente raccolti durante lo svolgimento del suo lavoro.

Anche nella prosecuzione del documento si parla diffusamente della responsabilità delle azioni (e degli errori) delle IA, non dando mai ad esse una responsabilità diretta, ma chiedendo agli organi competenti di adeguare la normativa per garantire la giusta protezione agli utilizzatori, senza però gravare i produttori di adempimenti o obblighi eccessivamente gravosi.

Viene inoltre sottolineato il fatto che la sicurezza dei prodotti dovrebbe sempre essere garantita, anche in caso di prodotti non statici, ma mutevoli come le IA che possono apprendere con il tempo e l’uso, modificando dunque il comportamento nel tempo.