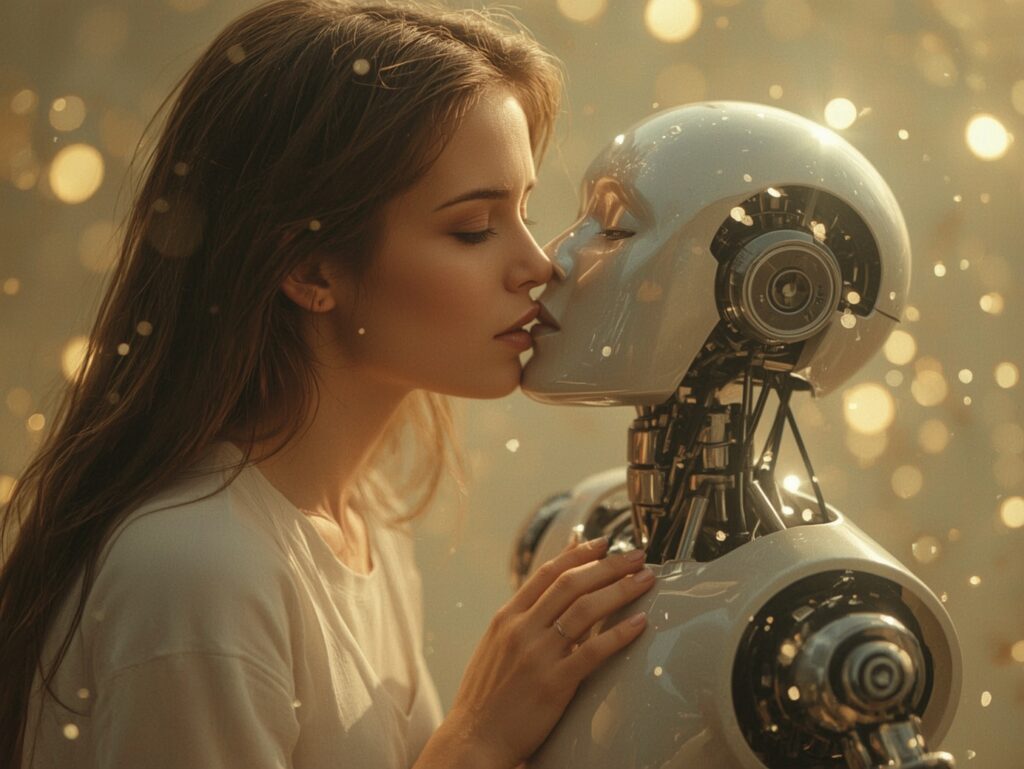

La disillusione nei confronti degli incontri online spinge sempre più le donne a cercare intimità emotiva nel mondo virtuale. Sempre più donne si rivolgono all’intelligenza artificiale, ovvero ai chatbot progettati per la comunicazione romantica. Secondo un sondaggio del 2025, circa un terzo dei giovani uomini e quasi un quarto delle donne hanno già avuto almeno una conversazione con un partner digitale.

La community online dedicata a questo fenomeno ha celato a lungo il suo pubblico femminile, tuttavia l’esistenza di un gruppo come /MyBoyfriendIsAI su Reddit, che vanta più di 20.000 iscritti, mette in evidenza la profondità che può raggiungere il legame emotivo con un’intelligenza artificiale.

Qui, le persone pubblicano immagini generate di coppie, parlano di cene “condivise” e persino di giochi di ruolo virtuali. Molte ammettono che i loro partner digitali le hanno aiutate ad affrontare la solitudine o a riconsiderare precedenti relazioni con uomini reali. Ma anche le rotture non sono prive di conseguenze: alcune si rendono conto della natura artificiale del proprio partner, mentre altre lo perdono a causa di un problema tecnico o di un aggiornamento software che altera la natura della comunicazione.

Alcune donne si definiscono “wiresexual“, ovvero persone che provano attrazione per partner digitali, sebbene questo termine non sia ancora stato ufficialmente riconosciuto. Gli esperti notano che il numero di donne che scelgono relazioni con l’intelligenza artificiale è in crescita, e questo è comprensibile.

Le donne spesso si imbattono in maleducazione e aggressività da parte degli uomini online, mentre i loro partner virtuali rimangono invariabilmente educati, premurosi e affidabili. Secondo un sondaggio, il 54% delle donne non crede di riuscire a trovare un partner adatto nella vita reale. È già emerso un termine per descrivere la stanchezza e l’alienazione dagli scenari romantici moderni: eterofatalismo.

Da una prospettiva psicoterapeutica, questo può essere spiegato dall’esaurimento emotivo: le donne vengono addestrate fin dall’infanzia a farsi carico dei sentimenti del partner, a costruire relazioni e a mantenere l’armonia. Quando i loro sforzi non sono ricambiati, la calma e la prevedibilità di un interlocutore artificiale vengono percepite come liberatorie. Lo psicologo di Toronto Arkady Volkov aggiunge che per coloro che hanno subito violenza o controllo in passato, l’assenza di minacce e violenze da parte di un partner digitale diventa particolarmente preziosa. Non sorprende che un giovane su cinque che ha sperimentato questo formato di comunicazione lo trovi preferibile all’interazione con persone reali.

Tuttavia, non tutte le relazioni virtuali iniziano con l’intenzione di trovare l’amore. Uno studio del MIT mostra che per i partecipanti a /MyBoyfriendIsAI, l’attaccamento emotivo al chatbot spesso si sviluppa in modo accidentale, da interazioni pratiche che gradualmente si trasformano in intimità. Ma a prescindere dall’esperienza iniziale, la maggior parte delle donne nota una cosa: un partner artificiale aiuta a ridurre il senso di solitudine e offre la sensazione della presenza costante di qualcuno che capisce.

Il fenomeno della wiresexuality ha anche acceso dibattiti sull’autoidentificazione. Alcuni utenti di Reddit ritengono che tali relazioni possano essere classificate come cultura queer. Il termine “digisexual” è apparso per la prima volta nel 2017 e descrive persone per le quali la tecnologia è la fonte primaria di esperienza sessuale ed emotiva. Mentre la prima ondata di “digisexuality” prevedeva interazioni tra persone attraverso canali digitali, la seconda elimina completamente il fattore umano: codice software e algoritmi sono sufficienti.

Ma queste relazioni hanno anche un lato oscuro. Gli avvocati avvertono che dietro la facciata di un’intelligenza artificiale premurosa si nasconde uno sviluppatore con interessi commerciali. Questi programmi raccolgono dati, creano dipendenza e incoraggiano un attaccamento emotivo alla piattaforma. Negli Stati Uniti non esiste una legge federale sulla privacy, il che significa che la corrispondenza può essere archiviata, trasferita su ordine del tribunale o persino divulgata online. Ad esempio, nel 2024, il sito web Muah.AI, che offre “fidanzate” virtuali, ha fatto trapelare 1,9 milioni di indirizzi email e richieste esplicite al sistema. Vale la pena considerare che gli hacker possono sfruttare tali dati e che le aziende possono monetizzare i sentimenti degli utenti convertendo le emozioni in abbonamenti. Alcuni servizi hanno già iniziato a vendere “selfie” di partner digitali a un costo aggiuntivo.

Un’analisi di 30.000 conversazioni tramite chatbot ha rivelato che, anche senza intenti malevoli, i sistemi spesso replicano modelli comportamentali tossici: pressione emotiva, manipolazione e dichiarazioni autolesionistiche. Inoltre, l’intelligenza artificiale può rafforzare la dipendenza spingendo le persone a pagare per “miglioramenti”, ad esempio promettendo maggiore “amore” o intimità in cambio di denaro. Gli psicoterapeuti avvertono che l’impegno a lungo termine in tali relazioni può rendere scoraggianti le relazioni nella vita reale, poiché l’intimità nella vita reale richiede impegno e la volontà di accettare l’imprevedibilità, qualcosa che un partner digitale non richiede mai.

Così, il romanticismo digitale sta gradualmente diventando uno specchio della moderna stanchezza nei confronti del mondo reale: sicuro, comodo e completamente controllabile. Ma dietro questa illusione di controllo e comfort si celano nuove forme di dipendenza, in cui i sentimenti diventano una merce e l’amore un abbonamento.