Veracode ha pubblicato il suo rapporto annuale sullo stato della sicurezza del software, analizzando i dati di 1,6 milioni di applicazioni. La scoperta principale: le vulnerabilità si manifestano più rapidamente di quanto possano essere corrette e il rapido sviluppo basato sull’intelligenza artificiale sta rendendo la sicurezza del software un compito praticamente impossibile.

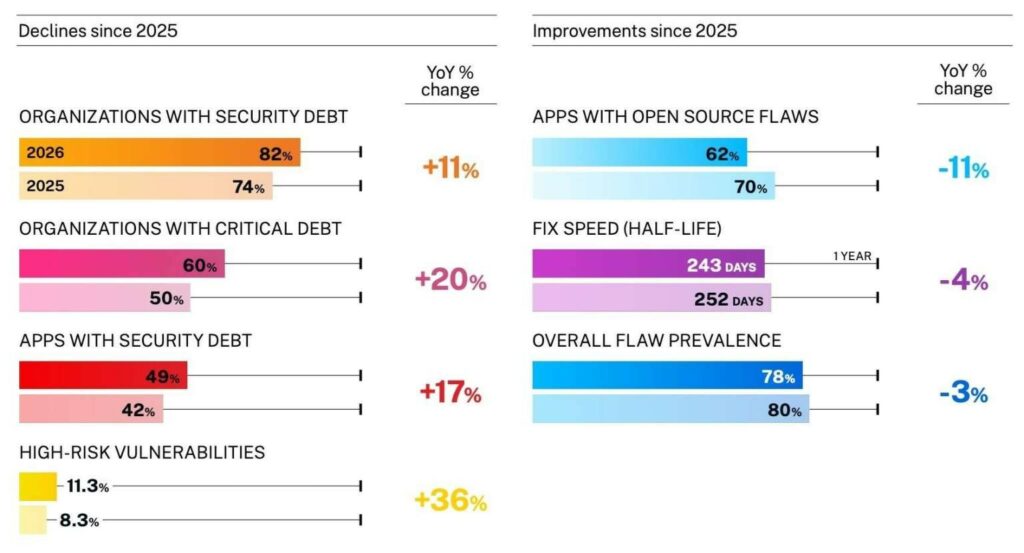

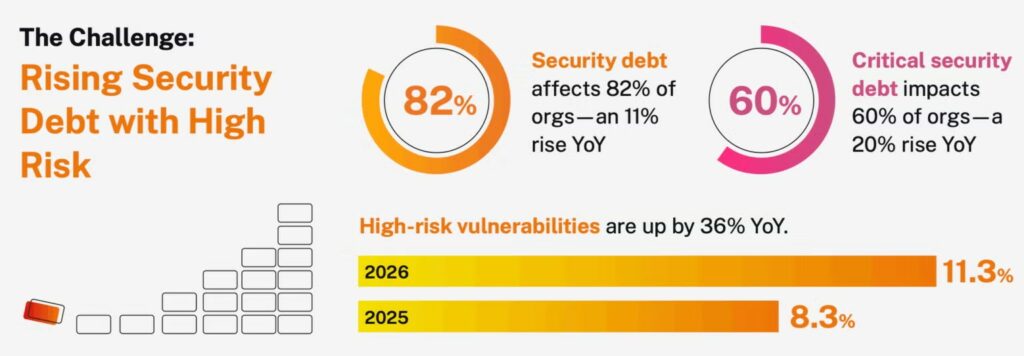

I ricercatori hanno introdotto il concetto di “debito di sicurezza”, ovvero vulnerabilità note che rimangono irrisolte per oltre un anno. Secondo gli esperti, l’82% delle aziende presenta ora questo debito (rispetto al 74% dell’anno precedente). La quota di vulnerabilità gravi con un’elevata probabilità di sfruttamento è aumentata dall’8,3% all’11,3%. I dati sono stati ottenuti tramite analisi statica e dinamica, analisi dei componenti software (SCA) e penetration test manuali.

Tuttavia, ci sono anche segnali positivi. La quota di applicazioni con vulnerabilità open source è diminuita dal 70% al 62% e la “prevalenza complessiva dei difetti” è scesa dall’80% al 78%.

I ricercatori osservano che l’aumento del numero di problemi rilevati è in parte spiegato dal maggiore utilizzo di strumenti di test: gli specialisti stanno individuando più bug che in precedenza semplicemente non avevano individuato. Il numero di falsi positivi è sconosciuto, quindi il quadro reale potrebbe non essere così preciso.

Tuttavia, Veracode sottolinea anche un altro fattore: il ritmo delle release sta accelerando, con l’aggiunta di nuovo codice più veloce di quanto le vecchie vulnerabilità vengano corrette.

Anche la complessità tecnica sta aumentando, in parte a causa del crescente volume di codice generato dall’intelligenza artificiale, che complica il processo di patching.

Gli esperti sottolineano l’importanza della supervisione umana sugli strumenti di intelligenza artificiale, sebbene ciò non sia sempre vero nella pratica.

La sicurezza è spesso relegata in secondo piano o delegata interamente all’intelligenza artificiale, con tutte le limitazioni e le conseguenze che ciò comporta. È stato inoltre osservato che gli strumenti di intelligenza artificiale generano spesso un gran numero di falsi positivi, creando un carico di lavoro eccessivo per i revisori.

“La velocità di sviluppo nell’era dell’intelligenza artificiale rende irraggiungibile una sicurezza completa”, afferma il rapporto. “L’arretrato di patch per le vulnerabilità ha raggiunto proporzioni critiche. I miglioramenti incrementali non sono più sufficienti: sono necessari cambiamenti radicali”.

Gli esperti non specificano esattamente cosa debba cambiare. Molto probabilmente, il settore offrirà ancora più strumenti di intelligenza artificiale in risposta a questa esigenza, anche se per ora questo non fa che aggravare la situazione.