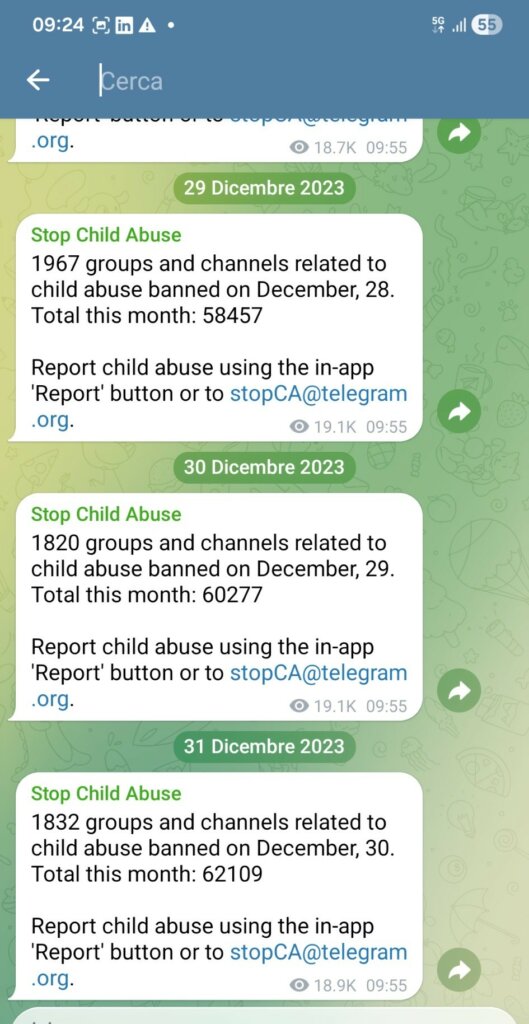

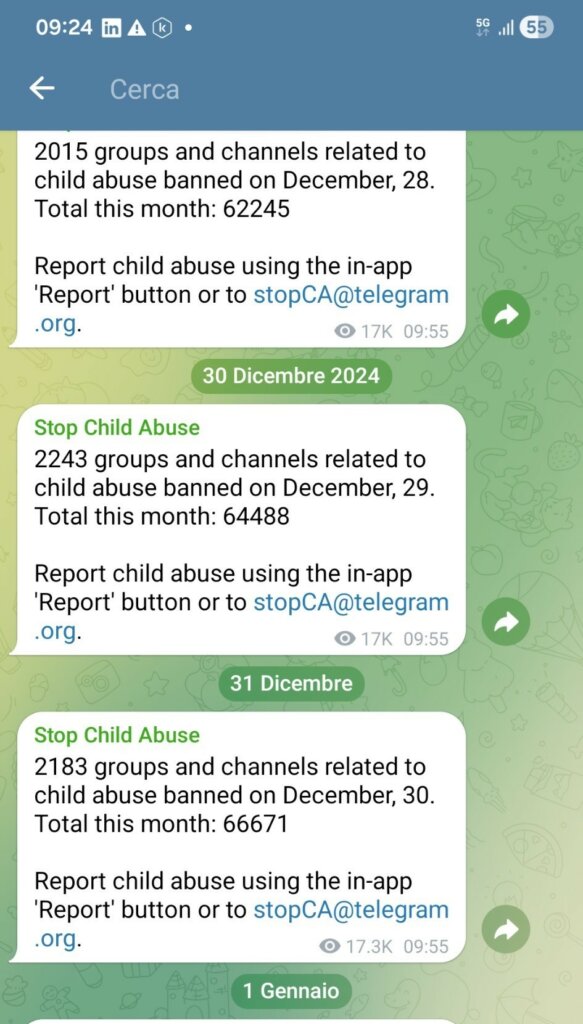

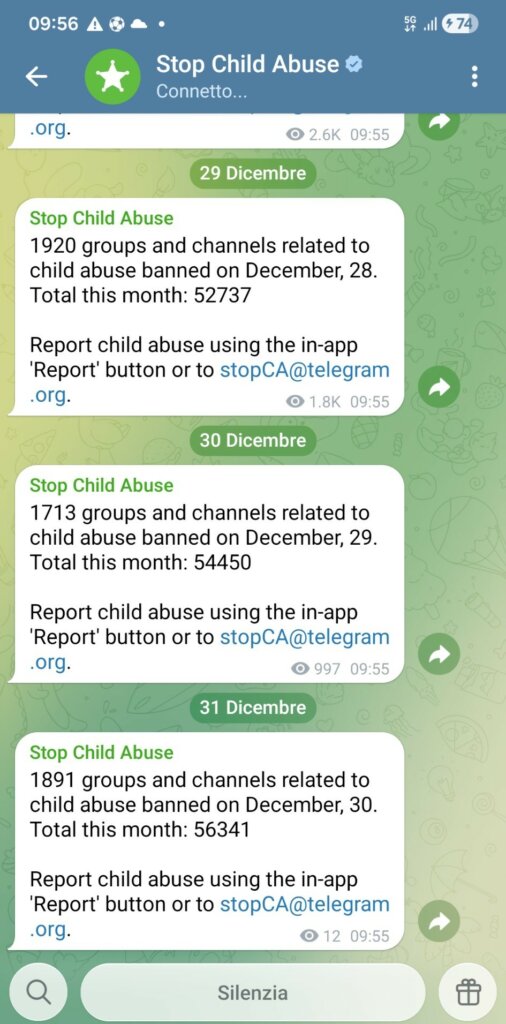

Ogni giorno Telegram pubblica, attraverso il canale ufficiale Stop Child Abuse, il numero di gruppi e canali rimossi perché riconducibili ad abusi su minori.

Il confronto più significativo emerge osservando le sequenze di fine anno, in particolare il mese di dicembre, quando i volumi si stabilizzano e i trend diventano comparabili.

Negli ultimi tre anni, quei numeri raccontano una storia interessante – ma solo se li si osserva in sequenza e non come fotografie isolate.

Confrontando gli ultimi giorni di dicembre (periodo omogeneo e comparabile), emergono tre fasi distinte.

Negli ultimi giorni dell’anno, Telegram comunica una media di circa:

Un valore che rappresenta una baseline: alta attività repressiva, ma con strutture abusive ancora relativamente stabili e individuabili.

Nel dicembre successivo il dato cresce in modo netto:

L’incremento è nell’ordine del 7–8% rispetto all’anno precedente.

Qui non siamo davanti a una fluttuazione casuale: il trend è coerente, ripetuto, strutturale.

Il fenomeno non solo persiste, ma aumenta in volume e velocità.

Con la pubblicazione del dato del 31 dicembre, il quadro di fine 2025 risulta completo.

Negli ultimi giorni del mese i valori giornalieri si collocano stabilmente sotto quota 2.000, con una media compresa tra 1.700 e 1.900 rimozioni al giorno.

Il totale mensile di dicembre 2025 si attesta a 56.341 rimozioni, in calo rispetto sia al 2023 sia al 2024.

Il calo è quindi numericamente reale, ma la sua interpretazione richiede cautela.

Letti superficialmente, questi dati potrebbero suggerire un miglioramento.

Ma è una conclusione tecnicamente fragile.

Dopo le vicende che hanno coinvolto la piattaforma e l’inasprimento delle misure di contrasto, si sono intensificate le discussioni – soprattutto tra utenti attenti alla privacy e in alcune community underground – sulla ricerca di alternative a Telegram. Applicazioni come Signal, Session o SimpleX vengono spesso citate in questi dibattiti, ma non esistono evidenze di una migrazione di massa, nemmeno per quanto riguarda i network legati agli abusi su minori.

Ciò che si osserva è piuttosto una riconfigurazione tattica e frammentata: l’uso di ambienti a bassa visibilità o di canali privati come complemento operativo, non come alternativa strutturale. Telegram continua infatti a rappresentare il principale punto di aggregazione, discovery e rinnovamento delle reti, grazie alla sua ampia base di utenti e alle funzionalità di broadcast, nonostante l’aumento della pressione repressiva.

Il punto centrale è questo: i numeri pubblici non misurano il fenomeno criminale, ma il modello di contrasto.

Tra il 2024 e il 2025, i dati osservabili e il quadro normativo europeo risultano coerenti con un progressivo spostamento verso modelli di contrasto più preventivi e automatizzati, già adottati da molte grandi piattaforme digitali.

In assenza di dettagli tecnici pubblici sulle singole pipeline di moderazione, è plausibile che tali modelli includano una maggiore enfasi su interventi anticipati, l’uso di sistemi automatici di riconoscimento dei contenuti e analisi basate su pattern comportamentali e di rete, con l’obiettivo di ridurre la diffusione prima che i canali raggiungano ampia visibilità.

Il risultato è un sistema che intercetta di più prima, ma comunica di meno dopo.

Di conseguenza:

Un altro elemento chiave è l’evoluzione delle modalità operative dei gruppi abusivi.

Oggi si osserva:

Questo rende:

Il problema non si riduce. Si distribuisce.

Questa dinamica non riguarda solo Telegram né esclusivamente il fenomeno degli abusi su minori.

È una lezione più ampia, che interessa chiunque. I numeri, soprattutto quando sono pubblici e ripetuti, rischiano di diventare rassicuranti per abitudine, ma non sempre raccontano ciò che davvero conta. Quando i contatori scendono, infatti, non è automaticamente una buona notizia: spesso significa solo che il sistema ha imparato a nascondersi meglio di quanto il reporting riesca a mostrare.

Tra il 2023 e il 2024 i dati mostrano un aumento reale e misurabile delle rimozioni.

Il 2025 introduce un calo netto sul piano numerico che, letto correttamente, indica un cambio di strategia repressiva, non una riduzione del fenomeno.

In questi contesti, la domanda giusta non è “quanti ne chiudiamo”, ma “quanti riusciamo a non far nascere”.

E questa è una metrica molto più difficile da raccontare.

Soprattutto in pubblico.