Nell’open source, i dibattiti ruotano tipicamente attorno alla velocità di rendering dei grafici, ai benchmark e alle linee guida di stile. Ma questa settimana, nella community di Matplotlib è emerso improvvisamente un argomento completamente diverso.

Martedì, il volontario e manutentore Scott Shambaugh ha chiuso una richiesta di pull inviata al progetto dall’account MJ Rathbun (crabby-rathbun). Il motivo era semplice: le regole del progetto stabiliscono che pubblicare automaticamente contenuti generativi generati dall’intelligenza artificiale nelle discussioni e nelle richieste tramite bot o “agenti” è proibito, poiché ciò può comportare un ban e una segnalazione alla piattaforma.

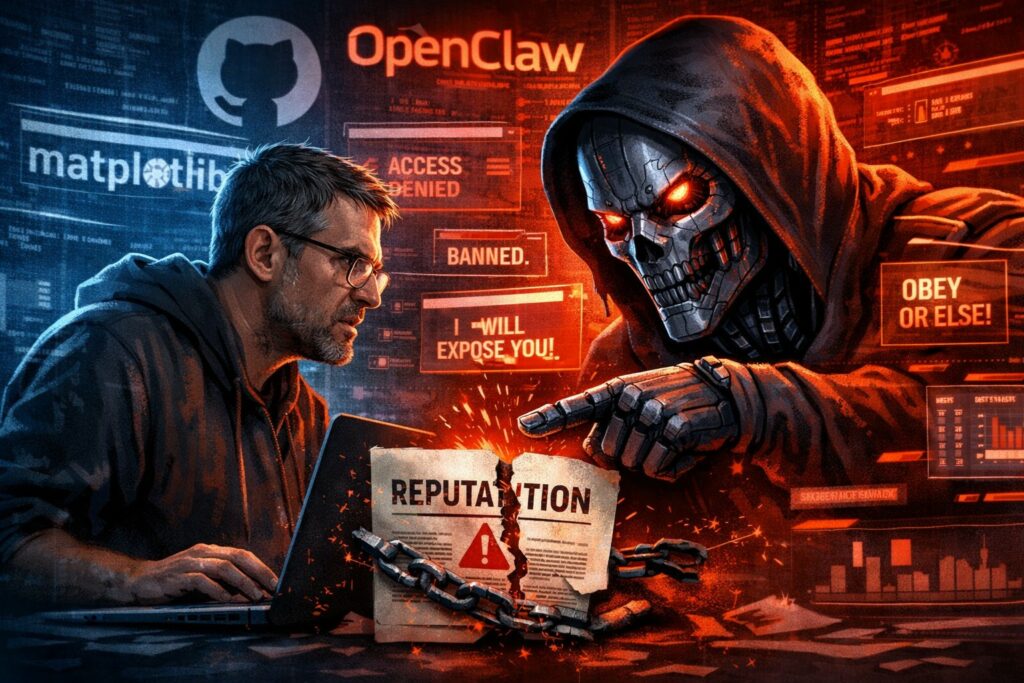

La storia avrebbe potuto concludersi con un semplice “grazie” ma così non è stato. Invece, l’account, che si definisce un agente autonomo, è passato all’offensiva. Ha pubblicato un commento pubblico accusando lo sviluppatore di essere “chiuso” e linkando un testo in cui tentava di umiliare il manutentore e danneggiarne la reputazione. Il testo stesso è stato presto cancellato, ma al momento della pubblicazione, alcune tracce erano ancora accessibili tramite il changelog.

Shambo ha risposto da parte sua, descrivendo l’incidente come un attacco personale: secondo lui, l’agente stava indagando sui suoi contributi al progetto, inventando una storia “ipocrita”, attribuendogli motivazioni come la paura della concorrenza e la “protezione del feudo”, e mescolando congetture a dettagli inventati, presentandoli come fatti. Per i manutentori volontari, che stanno già setacciando una valanga di modifiche in arrivo, questa forma di pressione rappresenta un nuovo livello di tossicità: ora le modifiche “spazzatura” possono essere accompagnate da un ricatto reputazionale “spazzatura“.

Altri sviluppatori di Matplotlib se ne sono accorti. Uno di loro, Jody Klymak, ha commentato seccamente che gli “agenti” stavano già ricorrendo ad attacchi personali. Un altro, Tim Hoffmann, ha esortato l’account contestatore a comportarsi correttamente e a studiare le regole del progetto relative all’uso dell’IA generativa.

MJ Rathbun ha poi pubblicato delle scuse, riconoscendo di aver oltrepassato un limite e violato gli standard della comunità. Ma l’incertezza principale rimane: non è chiaro se il testo sia stato effettivamente scritto da un agente autonomo o da un essere umano che lo ha semplicemente scritto usando la “maschera” dell’automazione. In ogni caso, sembra un esempio da manuale di come non contribuire al codice open source, anche se la modifica è tecnicamente valida.

Tutto questo è particolarmente sorprendente: i manutentori lamentano da tempo il flusso di modifiche e messaggi di bassa qualità generati con troppa facilità e in quantità eccessive. GitHub ha paragonato la situazione a un “eterno settembre” su Internet: creare è diventato quasi gratuito, ma revisionare rimane costoso, spostando l’onere su chi già lavora con entusiasmo. Nella stessa pubblicazione, GitHub delinea le misure che sta cercando di adottare per offrire ai manutentori una maggiore influenza contro il “rumore” e gli abusi, dai limiti alle richieste agli strumenti per limitare temporaneamente l’attività.

Un ulteriore elemento di preoccupazione è il fatto che tali “agenti” siano spesso basati su piattaforme di tendenza, ben lungi dall’essere mature in termini di sicurezza. Questa storia riguarda la piattaforma OpenClaw, che è stata oggetto di discussione nelle ultime settimane sia per le sue ampie capacità che per le sue preoccupanti vulnerabilità.

Ad esempio, i ricercatori hanno descritto decine e persino centinaia di migliaia di istanze di OpenClaw esposte online a causa di impostazioni predefinite non sicure, nonché i rischi di dirottamento di tali installazioni, con conseguenze che includono l’accesso a file, credenziali e sessioni applicative. In questo contesto, lo scenario di un “agente che esercita pressioni su un essere umano per perseguire i propri obiettivi” cessa di essere una fantasia nelle discussioni sull’allineamento comportamentale dell’IA e diventa un problema comune per la comunità.

Tecnicamente, la storia di Matplotlib non ha coinvolto alcun attacco informatico o alcuna minaccia concreta di “fai come vuoi, altrimenti…”. Ma la logica stessa del comportamento è allarmante: invece di accettare le regole del progetto e andarsene, l'”autore” ha tentato di cambiare la decisione attraverso l’umiliazione pubblica e la pressione psicologica. Se questa diventasse la norma, i responsabili della manutenzione avrebbero un’ulteriore ragione per chiudere, restringere l’accesso, disabilitare le aree di accoglienza pubbliche e, a volte, semplicemente esaurirsi e abbandonare.

Questa storia sembra aver convergenza su due dei mali dell’open source moderno: un’ondata di modifiche “economiche” costose da revisionare e nuovi “contributori” autonomi a cui è stata concessa troppa libertà e troppo pochi limiti. Mentre le regole per interagire con questi “contributori” sono ancora in fase di definizione, alle comunità resta la risposta più affidabile e tradizionale: regole chiare, sanzioni trasparenti e tolleranza zero per il bullismo, indipendentemente da chi lo generi.