L’identità di Satoshi Nakamoto, l’inventore del Bitcoin è stata svelata! È stato Adam Back?

Il New York Times ha riacceso uno dei più lunghi ed intriganti gialli nel mondo della tecnologia digitale ovvero chi è Satoshi Nalamoto? Il quotidiano americano ha pubblicato di recente una inchiesta ...

Il caso del direttore dell’FBI Kash Patel: anatomia di un’esposizione prevedibile

Questo caso rappresenta un esempio molto concreto di come una esposizione di email personale possa generare un rischio nella cybersecurity in un contesto istituzionale. Ne avevamo già parlato in prece...

Sviluppo Cognitivo: Anche la Grecia vieta i social network ai minori di 15 anni

Dal 1° gennaio 2027, anche la Grecia introdurrà una misura e netta rispetto ai social media per i minori di 15 anni. La decisione è stata annunciata dal primo ministro Kyriakos Mitsotakis con un video...

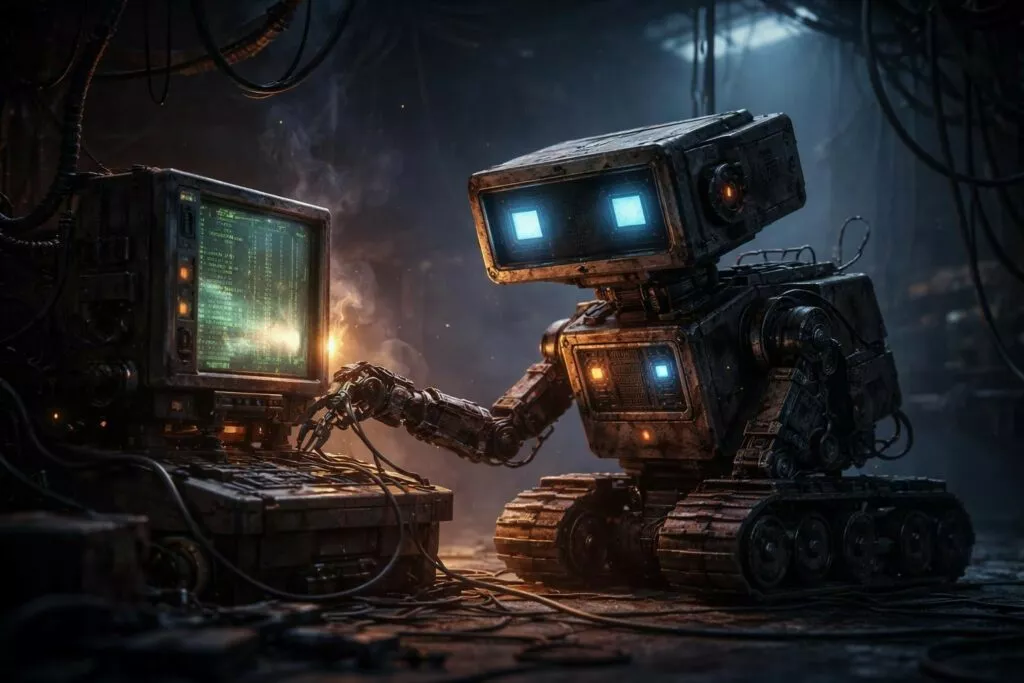

Hai creato il tuo chatbot? Fai attenzione perché i bug sono ad un passo dagli hacker cattivi

Una vulnerabilità che affligge Flowise, una popolare piattaforma per lo sviluppo di app AI, è passata da un rischio teorico ad un rischio concreto. Gli esperti hanno identificato degli attacchi deve g...

Maven e AI nella guerra moderna: Chi pagherà per l’uccisione di civili innocenti?

Le forze armate degli Stati Uniti D’America, si stanno progressivamente spostando dall’analisi dei dati al processo decisionale sul campo di battaglia. In tutto questo l’intelligenza artificiale sta i...

VPN sotto attacco: un bug espone il vero IP degli utenti a loro insaputa

Un ricercatore, che si firma con lo pseudonimo di runetfreedom, ha recentemente segnalato un bug di sicurezza critico che interessa tutti i client VLESS per dispositivi mobili più diffusi. Secondo qua...

Microsoft scarica l’AI: Copilot è “solo per intrattenimento”. Cosa sta succedendo?

Negli ultimi mesi stiamo assistendo ad un approccio diverso e completamente differente da parte di Microsoft nei confronti delle AI. Un segnale molto forte arriva proprio dai Termini di Utilizzo aggio...

Hacker nordcoreani rubano 285 milioni di dollari a Drift: attacco pianificato da mesi

Drift Protocol ha perso 285 milioni di dollari a seguito di un attacco hacker nordcoreano pianificato per oltre sei mesi. Il gruppo UNC4736 ha condotto un’operazione su vasta scala utilizzando tecnich...

The Gentlemen: il ransomware che sfrutta 14.000 firewall già compromessi

In un contesto ormai dominato da moltissimi marchi di ransomware, il nuovo gruppo The Gentlemen è emerso dall’ombra non grazie a tattiche insolite, bensì attraverso una strategia di attacco brutale e ...

Attacco hacker? No, è stato Puffo Inventore! Guida al Coaching per Cyber-Puffi

Tutta colpa di Sanremo! Ancora Sanremo? Sì, ho visto Cristina d’Avena sul palco dell’Ariston che mi ha triggerato dei ricordi. Poi ci ho pensato e ripensato e mi è venuta voglia di raccontarti cosa ci...

Articoli più letti dei nostri esperti

Affida la migrazione ad un’AI ma l’agente cancella due anni e mezzo di dati su AWS

Qwen è libero! Senza censura, on-premise e 100% open source

L’identità di Satoshi Nakamoto, l’inventore del Bitcoin è stata svelata! È stato Adam Back?

Silvia Felici - 8 Aprile 2026

Il caso del direttore dell’FBI Kash Patel: anatomia di un’esposizione prevedibile

Simone D'Agostino - 8 Aprile 2026

Sviluppo Cognitivo: Anche la Grecia vieta i social network ai minori di 15 anni

Silvia Felici - 8 Aprile 2026

Hai creato il tuo chatbot? Fai attenzione perché i bug sono ad un passo dagli hacker cattivi

Bajram Zeqiri - 8 Aprile 2026

Maven e AI nella guerra moderna: Chi pagherà per l’uccisione di civili innocenti?

Carolina Vivianti - 8 Aprile 2026

Minacce informatiche 2025: Cisco Talos analizza l’evoluzione del panorama cyber

Redazione RHC - 8 Aprile 2026

Quantum computing: La crittografia sta per crollare? Allora il Cloud si sposta nello spazio

Carolina Vivianti - 8 Aprile 2026

Smart TV sotto accusa: i broadcaster UE chiedono nuove regole

Inva Malaj - 8 Aprile 2026

Google corregge una falla critica su Android che porta a DoS senza alcuna azione

Carolina Vivianti - 7 Aprile 2026

VPN sotto attacco: un bug espone il vero IP degli utenti a loro insaputa

Carolina Vivianti - 7 Aprile 2026

Ultime news

L’identità di Satoshi Nakamoto, l’inventore del Bitcoin è stata svelata! È stato Adam Back?

Il caso del direttore dell’FBI Kash Patel: anatomia di un’esposizione prevedibile

Sviluppo Cognitivo: Anche la Grecia vieta i social network ai minori di 15 anni

Hai creato il tuo chatbot? Fai attenzione perché i bug sono ad un passo dagli hacker cattivi

Maven e AI nella guerra moderna: Chi pagherà per l’uccisione di civili innocenti?

Minacce informatiche 2025: Cisco Talos analizza l’evoluzione del panorama cyber

Quantum computing: La crittografia sta per crollare? Allora il Cloud si sposta nello spazio

Smart TV sotto accusa: i broadcaster UE chiedono nuove regole

Google corregge una falla critica su Android che porta a DoS senza alcuna azione

VPN sotto attacco: un bug espone il vero IP degli utenti a loro insaputa

Hasbro sotto attacco hacker: settimane di caos per il colosso dei giocattoli

Microsoft scarica l’AI: Copilot è “solo per intrattenimento”. Cosa sta succedendo?

Scopri le ultime CVE critiche emesse e resta aggiornato sulle vulnerabilità più recenti. Oppure cerca una specifica CVE