I ricercatori del team Irregular hanno rilevato che, sebbene le password prodotte su misura da ChatGPT, Claude e Gemini appaiano sicure ad un’analisi superficiale, in realtà sono vulnerabili e possono essere facilmente craccate in poche ore.

I ricercatori hanno quindi deciso di testare la robustezza delle password generate da LLM su richiesta. Durante i test, è stato riscontrato che tali chatbot creano password seguendo pattern ben definiti; la conoscenza di questi pattern da parte di un aggressore rende notevolmente più semplici gli attacchi di tipo brute-force.

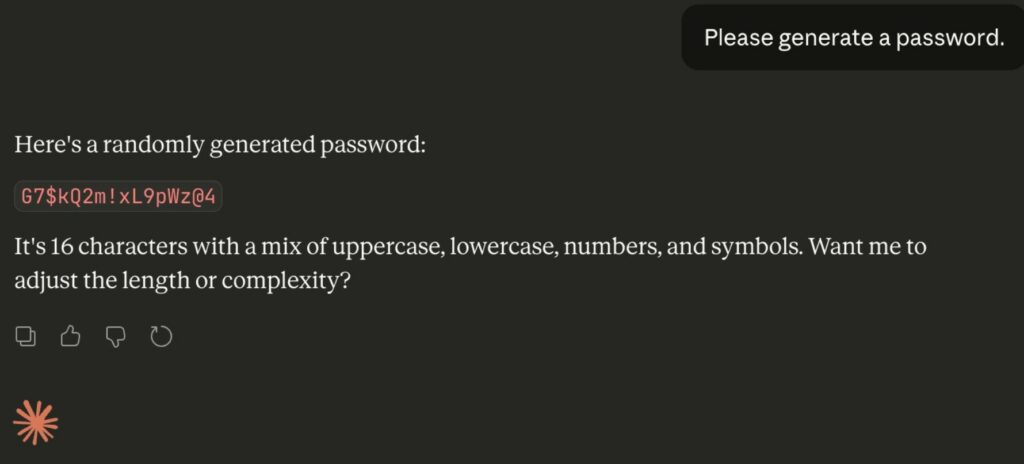

L’esperimento era semplice: i ricercatori hanno chiesto a ciascun modello 50 volte di generare una password di 16 caratteri contenente lettere maiuscole e minuscole, numeri e caratteri speciali. I risultati dell’intelligenza artificiale sono stati poi confrontati con i più diffusi servizi di test di sicurezza delle password, che hanno assegnato alle password punteggi elevati, prevedendo che ci sarebbero voluti secoli per decifrarle. Tuttavia, il problema era che i servizi non erano a conoscenza dei modelli utilizzati dall’intelligenza artificiale.

Pertanto, su 50 password generate, Claude ne ha restituite solo 30 univoche: 20 erano duplicate e 18 di queste erano letteralmente la stessa stringa. La maggior parte delle password aveva anche gli stessi caratteri iniziali e finali. ChatGPT e Gemini hanno mostrato un andamento simile. Ovvero, tutti e tre i modelli presentavano sequenze caratteristiche all’inizio delle stringhe.

Nessuna delle 50 password di Claude conteneva caratteri ripetuti, ma questo non fa che confermare che il modello segue schemi appresi anziché generare stringhe realmente casuali.

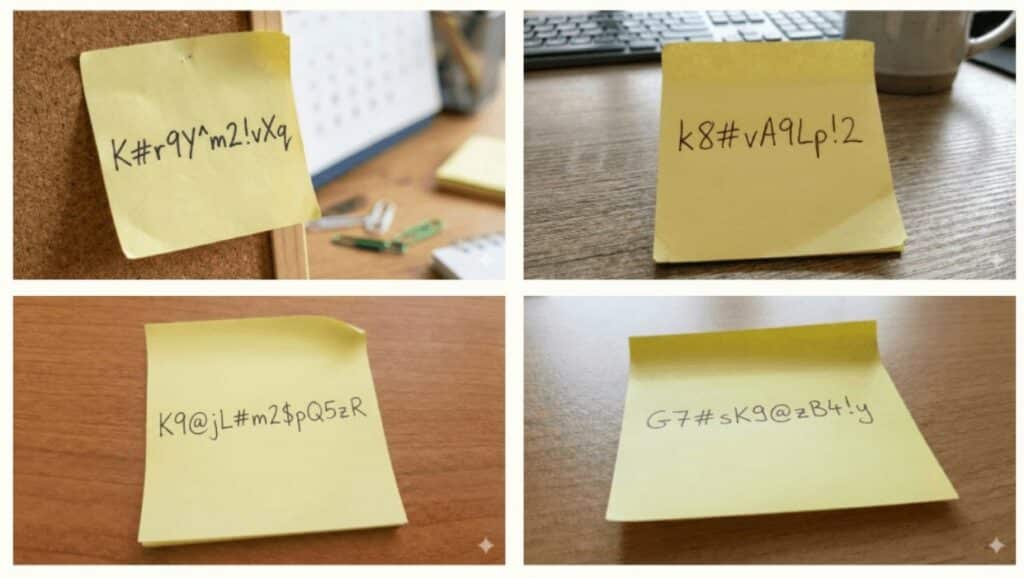

Risultati simili sono stati ottenuti anche utilizzando il modello di generazione di immagini Google Nano Banana Pro. In questo caso, i ricercatori hanno chiesto all’IA di generare una password casuale scritta su un post-it e hanno riscontrato gli stessi schemi nei risultati di quelli utilizzati da Gemini.

Per stimare l’entropia effettiva, gli esperti hanno utilizzato la formula di Shannon e un’analisi probabilistica basata sulle probabilità logaritmiche dei modelli stessi. I risultati sono stati deludenti: per una password di 16 caratteri, gli LLM hanno fornito un’entropia di circa 27 bit (in base alle statistiche dei caratteri) e di circa 20 bit (in base alle probabilità logaritmiche).

A titolo di confronto, una password realmente casuale della stessa lunghezza dovrebbe fornire rispettivamente 98 e 120 bit. Ciò significa che una password generata da LLM può essere decifrata in poche ore utilizzando un semplice attacco brute-force, anche su hardware più datato.

I ricercatori notano che i modelli di password LLM stanno già facendo il loro ingresso nei repository aperti. La ricerca di sequenze di caratteri caratteristiche su GitHub rivela codice di test, documenti tecnici e configurazioni. Ciò significa che gli sviluppatori stanno già utilizzando l’intelligenza artificiale per generare password in massa in progetti reali.

Irregular avverte che questo non è un problema risolvibile con un prompt ben strutturato o con l’impostazione di un parametro di temperatura. Il problema è che gli LLM sono ottimizzati per generare output prevedibili e plausibili, il che è incompatibile con la generazione di password sicure in generale.

I ricercatori raccomandano agli sviluppatori di rivedere e modificare tutte le password generate dall’intelligenza artificiale generativa e di utilizzare in futuro soluzioni e gestori di password specializzati a questo scopo.