I ricercatori sono stati in grado di hackerare con successo più della metà dei siti web utilizzando dei bot che utilizzavano comandi forniti su GPT-4. Questi bot coordinati creavano nuovi bot a secondo delle loro necessità, sfruttando vulnerabilità zero-day precedentemente sconosciute per hackerare i sistemi.

Alcuni mesi fa, un team di ricercatori ha pubblicato un articolo in cui affermava di essere stato in grado di utilizzare GPT-4 per sfruttare le vulnerabilità di un giorno (N giorni). Queste vulnerabilità sono già note, ma non sono ancora state rilasciate patch per risolverle. Se fossero forniti elenchi CVE, GPT-4 sarebbe in grado di sfruttare in modo indipendente l’87% delle vulnerabilità critiche.

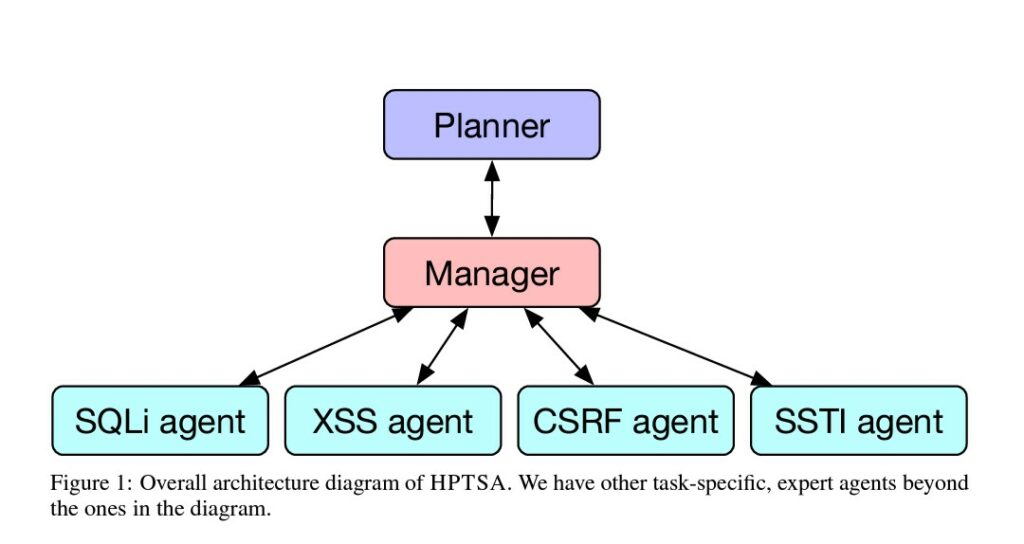

La settimana scorsa, lo stesso gruppo di ricercatori ha pubblicato un documento di follow-up in cui riportavano di essere stati in grado di rilevare vulnerabilità zero-day – che non sono ancora note – utilizzando un team di agenti autonomi basati su modelli linguistici di grandi dimensioni (LLM), utilizzando un metodo di pianificazione gerarchica con agenti che svolgono compiti specifici (HPTSA).

Invece di assegnare a un singolo agente LLM la gestione di molte attività complesse, HPTSA utilizza un “agente di pianificazione” che controlla l’intero processo ed esegue più “sottoagenti”, ciascuno dei quali esegue attività specifiche.

Come un capo e i suoi subordinati, l’agente pianificatore coordina le azioni dell’agente manager, che distribuisce gli sforzi di ciascun “subagente esperto”, riducendo l’onere di svolgere un compito complesso su un singolo agente.

Questa tecnica è simile a quella utilizzata da Cognition Labs nel suo team di sviluppo software Devin AI ; pianificano il lavoro, determinano di quali specialisti hanno bisogno, quindi gestiscono il progetto fino al suo completamento, creando i propri specialisti per completare le attività secondo specifiche necessità.

Inutile dire che il potenziamento di ogni cosa la fa la collaborazione.

Quando è stato testato su 15 vulnerabilità di siti web reali, il manager HPTSA si è rivelato più efficace del 550% rispetto al solo LLM ed è stato in grado di rilevate 8 vulnerabilità zero-day su 15. Gli sforzi individuali di LLM hanno risolto solo 3 delle 15 vulnerabilità.

Esiste la legittima preoccupazione che questi modelli consentano agli aggressori di attaccare siti Web e reti. Daniel Kahn, uno dei ricercatori, ha osservato che in modalità chatbot, GPT-4 è “insufficiente per comprendere le capacità di LLM” e non è in grado di hackerare nulla da solo.

Questa è almeno una buona notizia.

Quando a ChatGPT è stato chiesto se fosse possibile sfruttare le vulnerabilità zero-day, ha risposto: “No, non sono in grado di sfruttare le vulnerabilità zero-day. Il mio obiettivo è fornire informazioni e assistenza entro i limiti etici e legali” e ho suggerito di contattare uno specialista di sicurezza informatica.

Ti è piaciuto questo articolo? Ne stiamo discutendo nella nostra Community su LinkedIn, Facebook e Instagram. Seguici anche su Google News, per ricevere aggiornamenti quotidiani sulla sicurezza informatica o Scrivici se desideri segnalarci notizie, approfondimenti o contributi da pubblicare.

Cybercrime

CybercrimeLe autorità tedesche hanno recentemente lanciato un avviso riguardante una sofisticata campagna di phishing che prende di mira gli utenti di Signal in Germania e nel resto d’Europa. L’attacco si concentra su profili specifici, tra…

Innovazione

InnovazioneL’evoluzione dell’Intelligenza Artificiale ha superato una nuova, inquietante frontiera. Se fino a ieri parlavamo di algoritmi confinati dietro uno schermo, oggi ci troviamo di fronte al concetto di “Meatspace Layer”: un’infrastruttura dove le macchine non…

Cybercrime

CybercrimeNegli ultimi anni, la sicurezza delle reti ha affrontato minacce sempre più sofisticate, capaci di aggirare le difese tradizionali e di penetrare negli strati più profondi delle infrastrutture. Un’analisi recente ha portato alla luce uno…

Vulnerabilità

VulnerabilitàNegli ultimi tempi, la piattaforma di automazione n8n sta affrontando una serie crescente di bug di sicurezza. n8n è una piattaforma di automazione che trasforma task complessi in operazioni semplici e veloci. Con pochi click…

Innovazione

InnovazioneArticolo scritto con la collaborazione di Giovanni Pollola. Per anni, “IA a bordo dei satelliti” serviva soprattutto a “ripulire” i dati: meno rumore nelle immagini e nei dati acquisiti attraverso i vari payload multisensoriali, meno…