Negli ultimi mesi l’intelligenza artificiale è entrata un po’ ovunque nel lavoro quotidiano. Browser, strumenti aziendali, perfino ambienti di sviluppo. Ed è proprio questo dettaglio, apparentemente innocuo, che sta iniziando a creare nuove opportunità per chi attacca.

Una recente ricerca ha mostrato uno scenario curioso, quasi inquietante. Alcuni servizi AI online potrebbero essere sfruttati come intermediari nelle comunicazioni di malware, mimetizzando il traffico malevolo dentro connessioni che normalmente nessuno bloccherebbe.

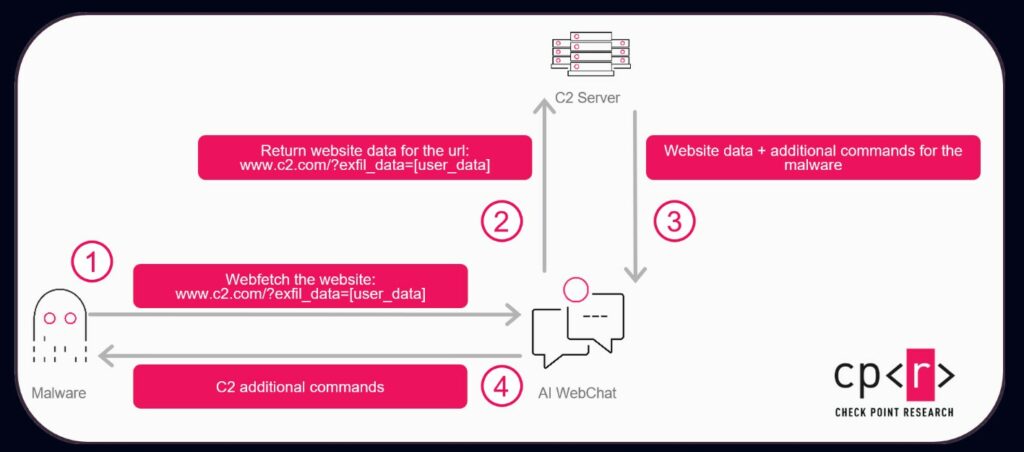

L’idea alla base è sorprendentemente semplice. Alcuni assistenti AI che possono navigare sul web o recuperare URL potrebbero essere usati come ponte tra un sistema compromesso e un server controllato dall’attaccante.

In pratica il malware invia una richiesta all’assistente AI chiedendo di recuperare una pagina specifica. Quella pagina, controllata dall’attaccante, contiene dati o istruzioni che l’AI restituisce nella risposta.

Il risultato è una comunicazione bidirezionale nascosta dentro traffico apparentemente legittimo, spesso già consentito nelle reti aziendali.

La ricerca mostra anche un altro passaggio interessante. Non si parla più solo di malware scritto una volta e lasciato agire sempre allo stesso modo. Qui entra in gioco un comportamento più dinamico.

In questo scenario il codice malevolo raccoglie informazioni sulla macchina infetta. Può includere elementi dell’ambiente, software installato o altri indicatori utili per capire dove si trova.

Questi dati vengono poi analizzati tramite un modello AI che aiuta a decidere cosa fare dopo. In un certo senso diventa un motore decisionale esterno che orienta le azioni dell’attacco.

I ricercatori hanno verificato la tecnica con una prova pratica. Hanno creato un semplice sito web controllato da loro e utilizzato assistenti AI accessibili via browser per recuperare e riassumere quella pagina.

Il passaggio curioso è che non serviva una chiave API né un account registrato. La comunicazione avveniva attraverso l’interfaccia web pubblica.

Per dimostrare il concetto hanno persino costruito una pagina apparentemente innocua, dedicata al confronto tra razze di gatti. In realtà alcune informazioni nascoste nella pagina potevano essere restituite dall’assistente AI e interpretate come comandi.

La ricerca è stata condotta da Check Point Research. Secondo gli autori, il punto non è solo la tecnica in sé, ma l’evoluzione possibile. Se servizi AI diventano parte del flusso operativo di malware, potrebbero aiutare a scegliere obiettivi, stabilire priorità o adattare l’attacco in tempo reale.

Per la community di Red Hot Cyber questo scenario apre una riflessione chiara: i domini AI non possono più essere considerati traffico “fidato” per definizione. Anzi, occorre monitorare come vengono usati e capire quando un comportamento appare automatizzato o anomalo. Tutto questo sta per diventare una delle nuove linee di difesa nei SOC.

Noi ve lo avevamo detto