Gli attacchi di ingegneria sociale stanno diventando la principale minaccia alla sicurezza informatica, sfruttando leve psicologiche come urgenza, paura e autorità. Il caso MGM dimostra come una semplice telefonata di vishing possa causare perdite milionarie aggirando anche sistemi avanzati. Con l’uso dell’intelligenza artificiale e deepfake, le tecniche diventano sempre più credibili. Il fattore umano resta il punto critico, rendendo necessarie nuove strategie basate su formazione comportamentale e cultura aziendale.

Secondo dei recenti studi, il 60% delle violazioni di dati, coinvolge un elemento umano, che si tratti di errore o manipolazione. Questa piaga non ha risparmiato i professionisti di sicurezza, che continuano ad essere influenzati con i medesimi meccanismi psicologici.

Le leve principali – urgenza, autorità e paura – agiscono in modo diretto sul sistema limbico, bypassando il pensiero logico del cervello. Comprendere queste tattiche, richiede un’analisi della psicologia comportamentale.

Gli aggressori, non cercano di forzare una “serratura digitale”, ma ingannare il proprietario della serratura per indurlo ad aprire volontariamente la porta. Nel mondo della cybersecurity, è opinione comune che manipolare una persona è più facile che violare un algoritmo di crittografia, rendendo gli umani il “bug” più difficile che deve essere corretto. La paura è potente ed è uno dei motori emotivi del crimine informatico, dove sembra che i criminali la stiano sfruttando sempre di più.

Quando le persone sono minacciate, che si tratti di perdita finanziaria o di qualcuno che compromette il loro conto, il loro cervello attiva una risposta di “attacco o fuga” che restringe l’attenzione alla risoluzione immediata del problema.

Questa reazione di tipo biologico, impedisce alla vittima di verificare la veridicità di un messaggio. Gli ingegneri sociali infatti, progettano delle specifiche esche che creano senso di ansia prima che la vittima sia in grado di attivare in modo completo i filtri razionali, inducendola ad agire in modo impulsito e quindi a manipolarla.

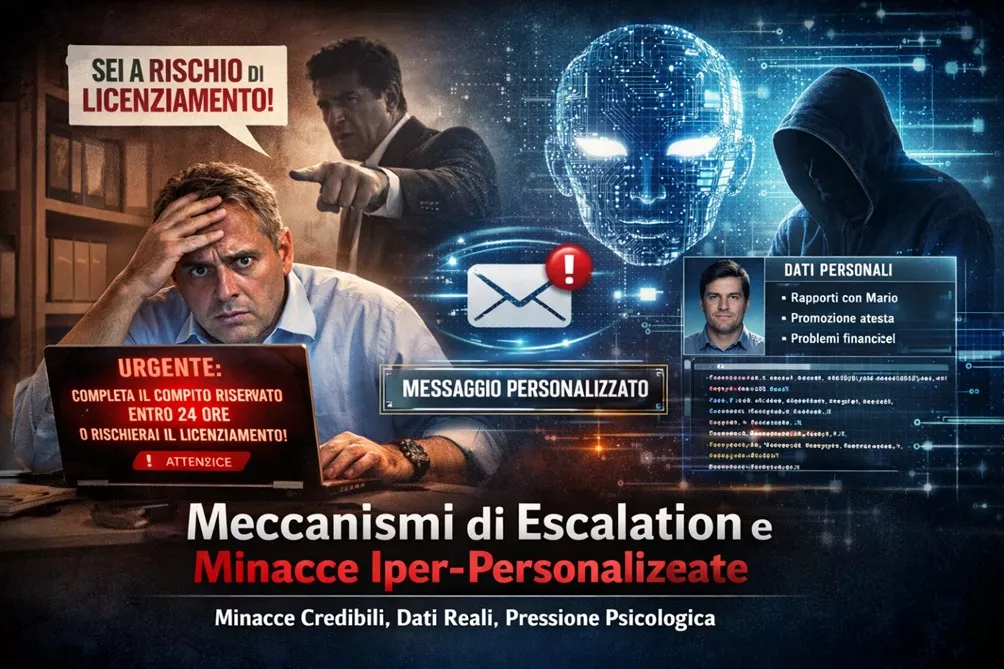

L’efficacia della paura è amplificata dall’uso di fittizie sanzioni disciplinari.

Ad esempio, la minaccia di licenziamento per non aver completato un compito “riservato” fa leva sia sulla “paura gerarchica” che sull’urgenza operativa. Con l’avvento dell’AI generativa, queste minacce sono diventate più credibili. I dati reali ottenuti tramite OSINT, vengono usati dai malintenzionati per creare campagne altamente mirate, le quali sfruttano le emozioni e altri aspetti della vita delle persone. La ricerca dimostra che la risposta ai messaggi personalizzati è forte, e può trarre in inganno anche il personale tecnico.

Il principio di AUTORITÀ si basa su una innata tendenza umana a conformarsi alle istruzioni che provengono da una fonte legittima. Negli attacchi di social engineering, questa leva viene sfruttata impersonando dirigenti oppure gli amministratori di sistema.

Un dipendente, il quale riceve un’e-mail apparentemente proveniente dall’AD della sua azienda, è molto meno propenso a nutrire dei dubbi e diventa quindi più vulnerabile alla frode, a causa del senso di autorità che gli viene attribuito. È quindi un condizionamento: siamo socialmente predisposti a credere che un leader non farebbe richieste pericolose. Gli attacchi BEC sfruttano questa tattica, con perdite medie superiori a 50.000 dollari per incidente. La “frode dell’amministratore delegato” è una variante in cui il malintenzionato richiede un bonifico bancario urgente, cercando di far sentire il dipendente gratificato dalla fiducia che l’AI ripone in lui. In assenza di una forte cultura aziendale che incoraggi il senso del dubbio, l’autorità può diventare un’arma molto forte per indebolire la capacità di difesa.

Il 71% dei nuovi dipendenti viene ingannato da attacchi di phishing entro i primi tre mesi di lavoro, è più suscettibile a richieste da parte della direzione. #Urgency è un fattore scatenante che stimola risposte emotive che bloccano i processi analitici, spostando la sua natura verso pensieri più intuitivi e automatici anziché transazionalmente logici. Quando si tratta di agire velocemente in una situazione in cui c’è poco tempo, il cervello umano dà la priorità alla velocità di elaborazione rispetto alla precisione. Le esche basate sull’urgenza utilizzano scadenze false come la reimpostazione della password entro dieci minuti che non consentono alla vittima di pensare a quanto sia strana la richiesta. Statistiche confermano che il tempo medio per cliccare su un link maligno è di appena 21 secondi dopo l’apertura di una e-mail.

Una variante è la scarsità, che sfrutta la PAURA di perdere un’opportunità esclusiva (FOMO). In uno studio della UC San Diego Health, è emerso che oltre il30% dei dipendenti ha cliccato su link riguardanti la gestione delle ferie, una percentuale molto superiore alle esche tecniche.

L’URGENZA crea un’ansia che può essere alleviata soloeseguendo l’azione richiesta. Il desiderio di eliminare questa tensione spinge l’utente a cliccare istintivamente, convinto di agire per la propria protezione o per non perdere un beneficio imminente. È un mito credere pericoloso che la competenza tecnica protegge dalla manipolazione. Al contrario, i professionisti possono essere vulnerabili a causa dibias cognitivi specifici come l’eccesso di fiducia. Un’analisi ha rivelato che quasidue terzi dei leader della sicurezza hanno cliccato su link di phishing, nonostante ritenessero la propria organizzazione sicura.

Nei contesti IT, il paradigma della risposta “tutto e subito” potrebbe trasformarsi in insidia per il tecnico servendo una modalità immediatamente reattiva a un allarme pesante (“down critico”) l’amministratore potrebbe semplicemente consegnare le proprie password al finto collaboratore che sostiene di voler rimediare in breve tempo al guasto. E si è insinuato in questo secondo caso che la formazione, se deve condurre a una prassi davvero sicura, deve saltare dal modello puramente informativo a quello formativo educativo, esercitando il cervello a dare di per sé la reazione che conviene, mediante la ripetizione di situazioni pratiche realistiche e il giudizio scarno che vi segue, del tutto esente d’ogni fregio punitivo e sempre provveduto in tempo ad osservare il risultato.

Il caso MGM è emblematico. Nel 2023, il gruppo “Scattered Spider” è riuscito a paralizzare l’MGM Resorts non tramite exploit tecnici, ma rubando informazioni da LinkedIn per effettuare una chiamata di vishing al loro servizio di assistenza. Fingendosi un dipendente, l’hacker è riuscito a convincere l’operatore a reimpostare le credenziali MFA. Questo ha causato all’azienda una perdita di oltre100 milioni di dollarie ha dimostrato che anche le difese più moderne possono essere aggirate a causa di una debolezza umana.

Gli aggressori hanno poi ottenuto privilegi elevati per compromettere gli ambienti Okta e Azure, crittografando centinaia di server. Questo evidenzia come la sicurezza di un sistema sia forte quanto il suo anello più debole: la fiducia in una voce autorevole. Inoltre, il gruppo ha utilizzato la tecnica della “fatica da MFA” per bombardare la vittima con notifiche fino a quando non ha autorizzato l’accesso per porre fine al fastidio. Il caso MGM dimostra che la resilienza non significa impedire ogni errore, ma costruire sistemi che limitino i danni quando la manipolazione psicologica ha successo.

Stiamo assistendo a una rivoluzione nell’ingegneria sociale con l’avvento dell’IA generativa, poiché le comunicazioni agli allievi dell’adescamento sono sempre più difficili a distinguersi da messaggi autentici. Alle prestazioni dell’avversario, finora limitate in forza all’impersonalità dei mezzi, si aggiunge ora la capacità di personalizzare, citando progetti reali e variando i toni dell’elocuzione. Ma il bersaglio più inquietante è costituito dai deepfake di voce che privano la vittima dell’ultimo dubbio.

Ascoltare il proprio capo ordinare un bonifico urgente esercita una pressione quasi irresistibile. E sul piano tecnico assisteremo a forme d’offensiva ancora più subdole. Tecniche come la prompt injection tenteranno di sfruttare contro gli assistenti aziendali il volto stesso della fiducia. Se un assistente suggerisce un link alfine di aggiornare un permesso, la fiducia nell’automatismo porta molto spesso all’imprudenza.

Questa violazione di fiducia tecnologica ci dà la chiave di severi problemi. Essa interrompe l’analogia che dal volere dell’operatore conduce all’agire del meccanismo e introduce l’obbligo drastico di sorvegliare l’ingresso e l’uscita delle macchine. La difficoltà dì oggi ne sospende l’addestramento, obbliga ad una strategia nuova, che partendo dall’uomo. Tra le soluzioni migliori ci sono i cd. “Protocolli di Pausa”, ovvero distinte procedure per atti ad alto rischio che impongano un doppio vaglio.

Anziché affidarsi esclusivamente alla forza di volontà, i sistemi dovrebbero integrare incentivi comportamentali, come banner di avviso contestuali nelle e-mail provenienti da domini esterni, che guidino gli utenti verso decisioni sicure senza sovraccaricare il loro sforzo mentale. Un elemento chiave è creare una cultura di sicurezza psicologica. Le organizzazioni che incoraggiano la trasparenza e adottano una formazione senza colpevolizzazioni riducono il rischio a lungo termine dell’88%. Se i dipendenti temono ripercussioni, tendono a nascondere i propri errori, dando agli aggressori il tempo di riorganizzarsi. La resilienza umana non si costruisce con la paura di essere licenziati, ma con la fiducia reciproca o i behavioral nudges.

Un esame delle dinamiche dell’ingegneria sociale rivela una verità fondamentale: il campo di battaglia della sicurezza informatica si è spostato dai server dei computer al cervello umano. Urgenza, autorità e paura non sono semplici stampelle! Sono strumenti di precisione che manipolano l’architettura biologica del nostro cervello. Il fatto che anche gli esperti siano vulnerabili dimostra che la conoscenza tecnica non può superare milioni di anni di evoluzione che ci hanno predisposto a rispondere istintivamente a determinati stimoli emotivi.

“Il futuro della sicurezza non consisterà nello scrivere codice migliore, ma nel costruire organizzazioni resilienti che proteggano la loro risorsa più preziosa e vulnerabile: il giudizio delle loro persone.” L’intuizione psicologica applicata a ogni procedura aziendale è l’unico modo per trasformare il fattore umano da “anello debole” a “sensore attivo”.

In un mondo di manipolazioni iperrealistiche potenziate dall’intelligenza artificiale, una cultura di scetticismo e verifica rimane la nostra difesa più efficace.