Zero-day su Microsoft Defender senza patch: exploit pubblici usati in attacchi reali

Il ricercatore Chaotic Eclipse, che in precedenza aveva pubblicato l’exploit BlueHammer per una vulnerabilità non corretta di Windows, ha continuato la sua “crociata” contro Microsoft e ha pubblicato ...

Lo Zero Trust? Era già tutto scritto 2000 anni fa

In questi anni lavorando in cybersecurity ho capito che la cybersecurity è più vicina alla filosofia di quanto si possa pensare. Vi accompagnerò quindi in un percorso insolito e vi farò toccare con ma...

NIS 2 e cybersecurity: perché il CdA non può più ignorare il CISO

Se la Nis 2 ed il Decreto legistavo 138/2024 rappresentano per certi versi un punto di svolta in materia di cyber security, per i “soggetti essenziali” ed i “soggetti importanti”, le determinazioni em...

Zero EDR. Zero Firewall. Zero… Trust. L’unico punto debole sei tu!

Secondo dei recenti studi, il 60% delle violazioni di dati, coinvolge un elemento umano, che si tratti di errore o manipolazione. Questa piaga non ha risparmiato i professionisti di sicurezza, che con...

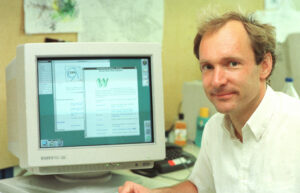

Il Caso Claude Mythos di Anthropic. Ha trovato davvero migliaia di vulnerabilità?

Patrick Garrity, specialista di VulnCheck, ha cercato di determinare quante vulnerabilità il nuovo modello di intelligenza artificiale Claude Mythos di Anthropic abbia effettivamente individuato nell’...

Allarme Microsoft: la patch di aprile possono bloccare l’autenticazione aziendale

I rappresentanti di Microsoft hanno avvertito che, dopo l’installazione degli aggiornamenti di aprile, alcuni controller di dominio Windows potrebbero entrare in un ciclo di riavvio infinito a causa d...

E se la guerra che stai seguendo su X tra Iran e Stati Uniti fosse falsa?

Si parla di oltre un miliardo di visualizzazioni in 30 giorni, e un progetto che non nasce per caso. Nel primo mese di guerra con l’Iran, una galassia di account presenti sul social network X, ha iniz...

Una scuola italiana finisce nel Dark Web! Leak da 1.9GB di dati sensibili online

C’è un momento ben preciso, in cui le storie emergono Inizialmente sono silenziose, quasi marginali, ma poi iniziano a fare rumore. È quello che sta accadendo con un post comparso nelle prime ore dell...

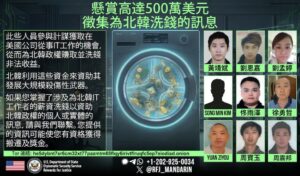

18 anni di reclusione per i complici degli hacker nordcoreani infiltrati in 10 aziende USA

I procuratori federali definiscono questo un sofisticato attacco alla sicurezza nazionale. Due residenti del New Jersey, sono stati condannati a delle pene detentive significative per aver gestito una...

Campagna di Phishing a tema MyKey di Intesa Sanpaolo: facciamo Attenzione

È stata individuata recentemente, una nuova campagna di phishing creata dai malintenzionati, che vuole impersonare il brand di Intesa Sanpaolo. Si tratta di una campagna in lingua italiana che si basa...

Articoli più letti dei nostri esperti

La Nuova Cortina di Ferro è Digitale: L'Europa è in Fuga dal Cloud USA

Zero-day su Microsoft Defender senza patch: exploit pubblici usati in attacchi reali

Chiara Nardini - 21 Aprile 2026

Lo Zero Trust? Era già tutto scritto 2000 anni fa

Daniela Farina - 21 Aprile 2026

AI in Italia: adozione da record ma la governance resta pericolosamente indietro

Silvia Felici - 21 Aprile 2026

Mozilla cambia il bug bounty per Firefox: solo bug critici e ben documentati

Bajram Zeqiri - 21 Aprile 2026

NIS 2 e cybersecurity: perché il CdA non può più ignorare il CISO

Paolo Galdieri - 21 Aprile 2026

Zero EDR. Zero Firewall. Zero… Trust. L’unico punto debole sei tu!

Massimo Dionisi - 21 Aprile 2026

Il Caso Claude Mythos di Anthropic. Ha trovato davvero migliaia di vulnerabilità?

Carolina Vivianti - 21 Aprile 2026

Allarme Microsoft: la patch di aprile possono bloccare l’autenticazione aziendale

Carolina Vivianti - 20 Aprile 2026

Rubati 292 milioni in pochi minuti: un hacker sconosciuto ha colpito il protocollo Kelp DAO

Bajram Zeqiri - 20 Aprile 2026

E se la guerra che stai seguendo su X tra Iran e Stati Uniti fosse falsa?

Chiara Nardini - 20 Aprile 2026

Ultime news

Zero-day su Microsoft Defender senza patch: exploit pubblici usati in attacchi reali

Lo Zero Trust? Era già tutto scritto 2000 anni fa

AI in Italia: adozione da record ma la governance resta pericolosamente indietro

Mozilla cambia il bug bounty per Firefox: solo bug critici e ben documentati

NIS 2 e cybersecurity: perché il CdA non può più ignorare il CISO

Zero EDR. Zero Firewall. Zero… Trust. L’unico punto debole sei tu!

Il Caso Claude Mythos di Anthropic. Ha trovato davvero migliaia di vulnerabilità?

Allarme Microsoft: la patch di aprile possono bloccare l’autenticazione aziendale

Rubati 292 milioni in pochi minuti: un hacker sconosciuto ha colpito il protocollo Kelp DAO

E se la guerra che stai seguendo su X tra Iran e Stati Uniti fosse falsa?

Una scuola italiana finisce nel Dark Web! Leak da 1.9GB di dati sensibili online

18 anni di reclusione per i complici degli hacker nordcoreani infiltrati in 10 aziende USA

Scopri le ultime CVE critiche emesse e resta aggiornato sulle vulnerabilità più recenti. Oppure cerca una specifica CVE