Microsoft Copilot è stato recentemente ridefinito come uno strumento di intrattenimento attraverso i suoi termini d’uso, segnando un cambio di narrativa attorno alle AI. La decisione porta all'attenzione i forti limiti dei modelli linguistici, incluse le allucinazioni e il bias da automazione. La crescente diffusione di contenuti sta alterando il web e anche le strategie del SEO. Il rischio è un inquinamento informativo il quale può portare a un progressivo deterioramento della qualità delle informazioni e dell’affidabilità delle stesse intelligenze artificiali.

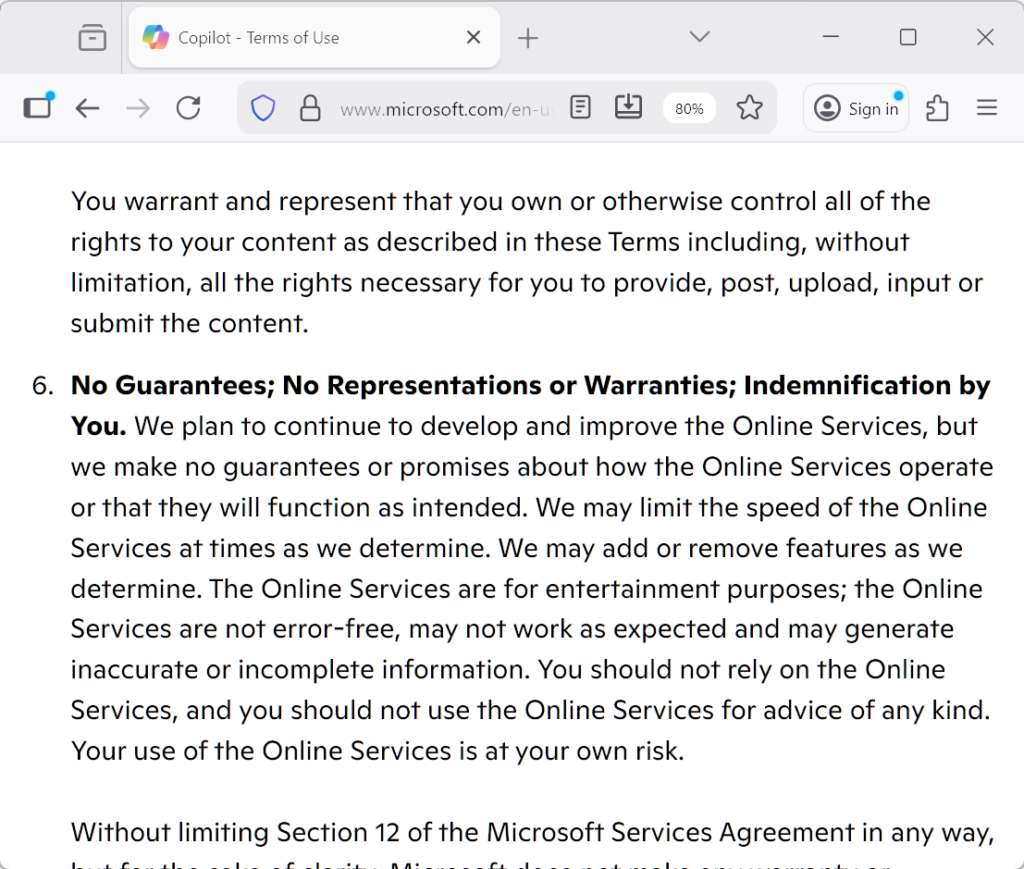

Negli ultimi mesi stiamo assistendo ad un approccio diverso e completamente differente da parte di Microsoft nei confronti delle AI. Un segnale molto forte arriva proprio dai Termini di Utilizzo aggiornati di Copilot. Viene specificato questa volta nero su bianco che lo strumento è solo destinato a “scopi di intrattenimento” e che non deve essere utilizzato per prendere importanti decisioni.

Questa dichiarazione letta nel contesto delle campagne di marketing che abbiamo avuto modo di vedere sui Copilot/PC e sull’AI in generale, suona come una forte contraddizione. E per certi versi, ci fa comprendere che fino in fondo non ce l’avevano raccontata bene.

Lo scollamento tra la narrativa commerciale e la realtà tecnica non è più un dettaglio marginale. Sta rappresentando una crepa strutturale nel modo in cui le intelligenze artificiali vengono percepite e proposte al pubblico.

Da un lato ci vengono venduti strumenti “intelligenti“, capaci di aumentare la produttività e supportare le decisioni più complesse; dall’altro, sul piano legale, si scarica ogni responsabilità sull’utente finale. È una forma di idiosincrasia industriale, ovvero ciò che ci viene promesso non coincide affatto con ciò che può essere realmente garantito dai sistemi.

Alla base di questa tensione c’è anche un limite noto e spesso sottovalutato dai molte persone, i modelli linguistici di grandi dimensioni (LLM) non possono comprendere il significato di ciò che producono. Generano, attraverso i loro algoritmi di statistica, risposte altamente plausibili, basate su correlazioni apprese durante le fasi di addestramento.

Sono appunto le cosiddette “allucinazioni“. Non sono dei bug accidentali nell’uso delle AI, ma una conseguenza diretta di questo nuovo paradigma. Più il testo sembra apparire fluido e convincente, maggiore è il rischio che venga accettato come vero anche quando di fatto non lo è.

Il problema si amplifica a causa del bias da automazione. Gli utenti, sempre di più tendono a fidarsi delle risposte generate dalle macchine, in particolare quando sono ben scritte e strutturate. Questo crea un forte cortocircuito che diventa altamente pericoloso. I contenuti che sono potenzialmente errati, vengono percepiti come affidabili, e quindi riproposti, citati e diffusi senza una adeguata verifica. In questo modo, l’errore non resta isolato ma si propaga in modo indiscriminato a macchia d’olio.

Parallelamente, il web sta subendo una grande trasformazione attraverso la proliferazione di questi contenuti, generati in modo autonomo. Il web sta saturando tutto l’ecosistema delle notizie online quali articoli, blog, recensioni e news, le quali vengono prodotte in massa utilizzando le AI.

A questo si aggiunge il fenomeno conosciuto dei deepfake, che( soprattutto sui social network), rendono sempre più difficile distinguere quello che è autentico davvero da ciò che non lo è affatto. Il risultato è un costane rumore informativo, dove la qualità media tende ad abbassarsi in modo incontrollato.

In risposta a questo scenario, anche gli algoritmi dei motori di ricerca stanno cambiando drasticamente la loro direzione. Le strategie di search engine optimization (SEO) stanno iniziando a penalizzare contenuti che vengono rilevati come scritti dalle AI, premiando invece quei segnali di autenticità, esperienza e intervento umano. È un tentativo di arginare quello che oggi possiamo chiamare “l’inquinamento informativo” o “l’inquinamento da AI”, ma allo stesso tempo evidenzia un paradosso: le tecnologie che vengono vendute su larga scala vengono indirettamente scoraggiate dagli ecosistemi digitali che dovrebbero a loro volta supportarle.

Questo porta a una riflessione ancora più profonda che non dobbiamo dimenticare mai. Le AI, per evolversi, hanno bisogno di contenuti umani. Il loro apprendimento dipende su dati reali, scritti da umani e verificati da umani. Se il web viene progressivamente riempito da contenuti solo sintetici e generati dalle AI, si crea un effetto di retro alimentazione che impoverisce la qualità del dataset. In altre parole, le AI iniziano a “imparare da se stesse”, perdendo quindi aderenza dalla realtà e diventando di fatto inutili.

Il rischio, in prospettiva, è quello di un vero e proprio collasso informativo. Senza un apporto continuo di contenuti umani autentici, le AI non smetteranno di migliorare degradandosi, amplificando errori, bias e imprecisioni.

Il cambio di tono di Microsoft, noi la leggiamo in primis come una cautela legale, ma sembra anche il segnale di una consapevolezza crescente: l’intelligenza artificiale, così come è oggi, non è una fonte definitiva di verità. E’ invece uno strumento potente e altamente fragile, che dipende ancora profondamente dall’intelligenza umana.