I tuoi pacchetti Laravel sono già stati compromessi senza che tu lo sappia?

Ricercatori di StepSecurity , Aikido Security e Socket hanno segnalato un insolito attacco alla catena di fornitura che ha colpito i popolari pacchetti di localizzazione Laravel Lang. Questa volta, gl...

TA4922: il gruppo cinese che ha deciso di fare sul serio in Europa – e l’Italia è nel mirino

Il Threat Actor TA4922 sta spostando le sue attività dal far east all’europa con specifica menzione dell’Italia come target delle loro campagne di spear phishing altamente personalizzato, localizzato ...

Il Pentagono accelera sulla cyber security. Gli USA preparano il campo di battaglia digitale

Il Pentagono ha definito la sicurezza informatica e le reti digitali gli elementi centrali della strategia bellica odierna. Il Pentagono ha dichiarato ai senatori che l’intero sistema digitale delle f...

Attacco zero-day a CISCO Catalyst SD-WAN Manager: come proteggersi ora

Cisco ha segnalato che una vulnerabilità di alta gravità nel Catalyst SD-WAN Manager, risulta attualmente sfruttata in attacchi attivi. La falla, nota come CVE-2026-20245, ha un punteggio CVSS pari a ...

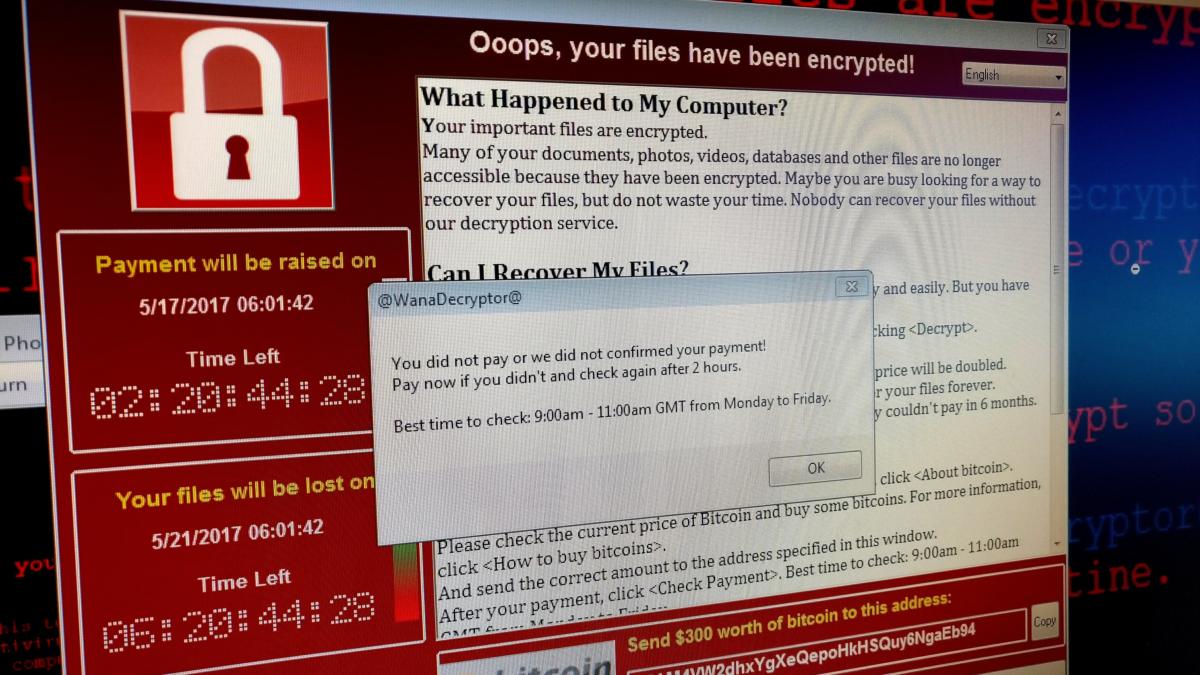

I worm autonomi stanno arrivando! Il Cybercrime 2.0 è oramai è alle porte

È passato tempo da quando Fred Cohen nel lontano 1983 dimostrò in un ambiente di laboratorio, come un programma informatico potesse autoreplicarsi e diffondersi all’interno di un sistema vittima. Intr...

62 milioni di utenti di Stripchat a rischio! Cosa potrebbe avvenire dopo la vendita?

La notte del 2 giugno 2026, alle 03:49, l’utente “Euphoric_Reply_5727” ha pubblicato un post nel forum underground BreachForums dove metteva in vendita i dati di Stripchat. Viene dichiarato nel post d...

La chiusura del forum underground XSS ha cambiato il mondo del cybercrime

Per due decenni, il forum clandestino XSS è rimasto un punto di riferimento fondamentale per i criminali informatici. Qui si cercavano complici, si vendevano gli accessi e si discuteva su malware, phi...

FBI, NSA e CISA avvertono degli attacchi ai serbatoi ATG. Lo spettro di Colonial Pipeline allarma gli USA

Le agenzie federali statunitensi, tra cui l’FBI e la NSA, stanno mettendo in guardia contro un’impennata di attacchi informatici mirati ai sistemi automatici di misurazione del livello del carburante ...

Terrorismo 4.0: come l’Intelligenza Artificiale sta cambiando la propaganda estremista

L’intelligenza artificiale non sta “rimpiazzando” il terrorismo di vecchia scuola, ma ne sta alterando il metabolismo. Gli elementi a supporto, al momento, non si riferiscono agli scenari fantascienti...

Un solo notebook può portare al collasso dei server. Trovato un bug che colpisce mezzo internet

Una nuova vulnerabilità, denominata HTTP/2 Bomb, è stata scoperta da ricercatori di Calif che permette di sovraccaricare la memoria dei popolari web server come Apache, Nginx e Microsoft IIS in pochi ...

Articoli più letti dei nostri esperti

Chi proteggerà le reti quando RSA smetterà di funzionare?

E se domani gli USA spegnessero il cloud? KDE riceve 1,3 milioni dalla Germania

I tuoi pacchetti Laravel sono già stati compromessi senza che tu lo sappia?

Luigi Zullo - 7 Giugno 2026

TA4922: il gruppo cinese che ha deciso di fare sul serio in Europa – e l’Italia è nel mirino

Luca Stivali - 7 Giugno 2026

Scopri come un truffatore ha venduto dati di 7 milioni di anziani americani per anni

Carolina Vivianti - 7 Giugno 2026

Il Pentagono accelera sulla cyber security. Gli USA preparano il campo di battaglia digitale

Luigi Zullo - 7 Giugno 2026

Attacco zero-day a CISCO Catalyst SD-WAN Manager: come proteggersi ora

Carolina Vivianti - 6 Giugno 2026

I worm autonomi stanno arrivando! Il Cybercrime 2.0 è oramai è alle porte

Massimiliano Brolli - 6 Giugno 2026

Caricabatterie elettrici a rischio: Nuovi bug scoperti dai ricercatori sugli XCharge C6

Carolina Vivianti - 6 Giugno 2026

Trump considera il direttore di Palantir Shyam Sankar per guidare il CISA

Luigi Zullo - 6 Giugno 2026

62 milioni di utenti di Stripchat a rischio! Cosa potrebbe avvenire dopo la vendita?

Chiara Nardini - 5 Giugno 2026

La chiusura del forum underground XSS ha cambiato il mondo del cybercrime

Chiara Nardini - 5 Giugno 2026

Ultime news

I tuoi pacchetti Laravel sono già stati compromessi senza che tu lo sappia?

TA4922: il gruppo cinese che ha deciso di fare sul serio in Europa – e l’Italia è nel mirino

Scopri come un truffatore ha venduto dati di 7 milioni di anziani americani per anni

Il Pentagono accelera sulla cyber security. Gli USA preparano il campo di battaglia digitale

Attacco zero-day a CISCO Catalyst SD-WAN Manager: come proteggersi ora

I worm autonomi stanno arrivando! Il Cybercrime 2.0 è oramai è alle porte

Caricabatterie elettrici a rischio: Nuovi bug scoperti dai ricercatori sugli XCharge C6

Trump considera il direttore di Palantir Shyam Sankar per guidare il CISA

62 milioni di utenti di Stripchat a rischio! Cosa potrebbe avvenire dopo la vendita?

La chiusura del forum underground XSS ha cambiato il mondo del cybercrime

FBI, NSA e CISA avvertono degli attacchi ai serbatoi ATG. Lo spettro di Colonial Pipeline allarma gli USA

Terrorismo 4.0: come l’Intelligenza Artificiale sta cambiando la propaganda estremista

Scopri le ultime CVE critiche emesse e resta aggiornato sulle vulnerabilità più recenti. Oppure cerca una specifica CVE