Dipendenza dai social media, verdetto storico negli USA contro le Big Tech e una riflessione

La decisione arriva dagli Stati Uniti e segna una frattura netta. Non è solo una reale sentenza. Una giuria ha scelto di guardare oltre i contenuti proposti dai social network, entrando nel cuore dell...

L’hack dell’account email del direttore FBI è una falla nella sicurezza nazionale

L’hack dell’account di posta personale del direttore FBI Kash Patel, rivendicato dal gruppo filo-iraniano Handala, ha portato alla pubblicazione di foto, email e documenti risalenti anche a oltre diec...

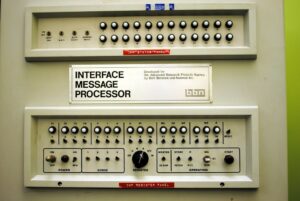

Bruxelles sotto attacco: hacker rubano 350 GB di dati alla Commissione Europea

Il 24 marzo 2026, un gruppo di malintenzionati (che dalle nostre analisi potrebbe essere Shiny Hunters) è entrato nell’ambiente cloud Amazon della Commissione Europea. Non attraverso una vulnerabilità...

IaB: Condannato a 6 anni e mezzo di carcere per aver facilitato gli attacchi ransomware

Sintesi: Aleksei Volkov, cittadino russo di 26 anni, è stato condannato a 81 mesi di carcere federale negli Stati Uniti dopo aver ammesso di aver fornito accessi non autorizzati alle reti di aziende a...

Il DLP non è il Grande Fratello: il problema è la progettazione

Il DLP funziona quando protegge dati classificati su canali selezionati con regole proporzionate. Fallisce quando monitora tutto. Il confine tra sicurezza e sorveglianza non lo traccia il prodotto: lo...

L’AI vuole entrare nell’energia nucleare: la tecnologia c’è, ma il vero ostacolo è nascosto

L’AI applicata all’energia nucleare promette di ridurre tempi e complessità nei processi di progettazione e permitting, ma i risultati attuali sono ancora parziali e circoscritti. Tecnologie come Digi...

OpenAI chiude Sora: il futuro dell’AI non è più Video! Scopriamo cosa sta accadendo

OpenAI ha chiuso Sora, la sua piattaforma di generazione video AI, a causa di scarsa monetizzazione, rischi legali legati al copyright e difficoltà nel controllo dei contenuti. L’azienda sposterà le r...

Il Ransomware è ora Democratico! TeamPCP e BreachForums assieme per elevare il RaaS

L’annuncio di una partnership tra BreachForums, il gruppo ransomware Vect e TeamPCP segnala una possibile evoluzione del cybercrime verso modelli aperti e scalabili. Se confermata, questa alleanza pun...

Attacco informatico all’ospedale Papardo di Messina. Urzì: La Sicilia sempre più esposta

Succede tutto in fretta. I sistemi si fermano e, nel giro di poco, l’intera macchina sanitaria inizia a rallentare fino a bloccarsi. All’ospedale Papardo di Messina è andata così, come riportato da Me...

Typosquatting: la trappola invisibile che svuota i conti con un refuso

Il typosquatting è una tecnica di cybercrime che consiste nel registrare domini web quasi identici a quelli di marchi famosi, sfruttando gli errori di digitazione degli utenti. L’obiettivo è dirottare...

Articoli più letti dei nostri esperti

Affida la migrazione ad un’AI ma l’agente cancella due anni e mezzo di dati su AWS

Dipendenza dai social media, verdetto storico negli USA contro le Big Tech e una riflessione

Massimiliano Brolli - 28 Marzo 2026

L’hack dell’account email del direttore FBI è una falla nella sicurezza nazionale

Chiara Nardini - 28 Marzo 2026

Bruxelles sotto attacco: hacker rubano 350 GB di dati alla Commissione Europea

Luca Stivali - 28 Marzo 2026

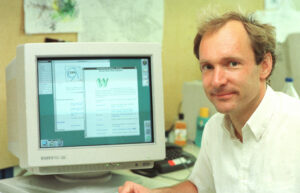

Abbiamo solo 3 anni per salvare Internet! Google Anticipa il Q-Day al 2029

Redazione RHC - 28 Marzo 2026

Cyber security e Critical National Infrastructure: il 93% è stato colpito negli ultimi 12 mesi

Redazione RHC - 27 Marzo 2026

Blind SQL Injection in Zabbix: minaccia reale e come bloccarla subito

Redazione RHC - 27 Marzo 2026

IaB: Condannato a 6 anni e mezzo di carcere per aver facilitato gli attacchi ransomware

Carolina Vivianti - 27 Marzo 2026

Il DLP non è il Grande Fratello: il problema è la progettazione

Matteo Di Pomponio - 27 Marzo 2026

Rete TELCO sotto assedio: BPFDoor è in scena per un attacco senza precedenti

Redazione RHC - 27 Marzo 2026

L’AI vuole entrare nell’energia nucleare: la tecnologia c’è, ma il vero ostacolo è nascosto

Bajram Zeqiri - 27 Marzo 2026

Ultime news

Abbiamo solo 3 anni per salvare Internet! Google Anticipa il Q-Day al 2029

Cyber security e Critical National Infrastructure: il 93% è stato colpito negli ultimi 12 mesi

Blind SQL Injection in Zabbix: minaccia reale e come bloccarla subito

Rete TELCO sotto assedio: BPFDoor è in scena per un attacco senza precedenti

Gli attacchi informatici si evolvono: le API sono nel mirino degli aggressori

Ransomware in evoluzione: il 57% delle aziende colpite, subisce una nuova estorsione

Una vulnerabilità Critica in Dell RecoverPoint Semina il Caos. Il malware GRIMBOLT in azione

Le minacce informatiche stanno cambiando: l’era degli attacchi guidati dall’IA è ora!

Tecnologia quantistica: acceleratore della rivoluzione digitale in Europa

CrackArmor: quando AppArmor smette di proteggere il kernel

Nuovo Kali 2026.1: tante nuove cose, ma la stabilità conta di più

Abbiamo perso il controllo dei robot domestici: migliaia di utenti spiati dentro casa

Scopri le ultime CVE critiche emesse e resta aggiornato sulle vulnerabilità più recenti. Oppure cerca una specifica CVE