Red Hat vittima di attacco alla Suppy Chain: cos’è successo e cosa imparare

L’ecosistema Red Hat è stato colpito da un attacco alla supply chain.Degli aggressori sconosciuti hanno compromesso l’infrastruttura di pubblicazione dei pacchetti @redhat-cloud-services e pubblicato ...

IKEA in emergenza cyber: 180 GB di dati a rischio, il gruppo Lapsus$ colpisce ancora!

IKEA sta verificando le affermazioni del gruppo di hacker Lapsus$, il quale ha riportato nel proprio Data Leak Sites (DLS) di aver ottenuto 180 GB di dati interni da Ingka Group, il più grande affilia...

Documentazione tecnica: un obbligo sottovalutato ma un pilastro della sicurezza

La documentazione tecnica delle infrastrutture di rete, dei sistemi digitali e delle configurazioni, oggi è un elemento ormai imprescindibile per le aziende che operano in conformità ai regolamenti eu...

Relazione annuale ACN 2025 : aumento degli attacchi, ma difese più efficaci

Lo scenario geopolitico e criminale del cyberspazio italiano è descritto in modo minuzioso dalla Relazione annuale 2025 presentata al Parlamento il 26 maggio 2026. Il primo dato che viene evidenziato ...

Il Grande Fratello entra in ufficio: il Garante ferma l’IA che valuta lo stress dei dipendenti

Il Garante per la protezione dei dati personali ha inviato un avvertimento a una start-up italiana che sta sviluppando un plug-in per le piattaforme di messaggistica aziendale Slack e Teams. Questo co...

La connessione internet in Iran: Perché la sua interruzione è un problema serio

Mahmoud Vaezi, vice presidente e capo dell’ufficio politico del partito Moderation and Development, ha sottolineato l’importanza di riportare la connessione internet alle condizioni precedenti ai rece...

Gli hacker criminali colpiscono Carnival. 6 milioni le persone esposte

Carnival Corporation, il più grande operatore mondiale di navi da crociera, ha informato i clienti di una violazione dei dati che ha colpito 5.995.277 persone. L’incidente è avvenuto ad aprile, ma la ...

Vulnerabilità nel plug-in Kirki: migliaia di siti WordPress a rischio

Una minaccia informatica attiva sta prendendo di mira migliaia di ambienti web a livello globale. Nello specifico, una vulnerabilità critica del plug-in Kirki che espone l’infrastruttura web wordpress...

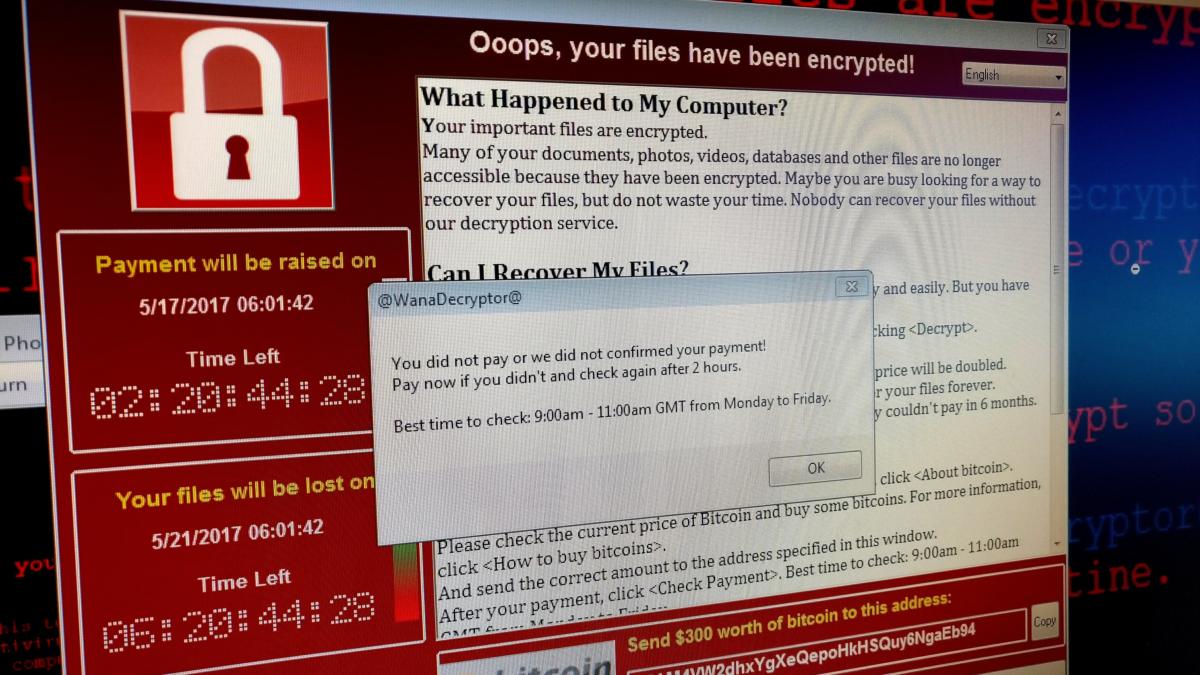

Windows Server sotto attacco: exploit critico Netlogon già attivo nelle reti aziendali

Gli aggressori hanno iniziato a sfruttare attivamente una vulnerabilità critica in uno dei componenti chiave di Windows Server solo poche settimane dopo il rilascio della patch. Il problema riguarda i...

Un semestre da urlo! FamousSparrow e SteppeDriver: Gli Ultimi Obiettivi degli Hacker Cinesi

La mappa globale dello spionaggio informatico è cambiata notevolmente negli ultimi sei mesi: alcuni gruppi hanno monitorato il petrolio, le rotte marittime e le tecnologie di difesa, altri hanno cerca...

Articoli più letti dei nostri esperti

Chi proteggerà le reti quando RSA smetterà di funzionare?

E se domani gli USA spegnessero il cloud? KDE riceve 1,3 milioni dalla Germania

Red Hat vittima di attacco alla Suppy Chain: cos’è successo e cosa imparare

Luigi Zullo - 3 Giugno 2026

Aggiornamenti di sicurezza di giugno per Android: corrette 124 vulnerabilità

Redazione RHC - 3 Giugno 2026

IKEA in emergenza cyber: 180 GB di dati a rischio, il gruppo Lapsus$ colpisce ancora!

Luigi Zullo - 3 Giugno 2026

Documentazione tecnica: un obbligo sottovalutato ma un pilastro della sicurezza

Stefano Toffano - 3 Giugno 2026

Relazione annuale ACN 2025 : aumento degli attacchi, ma difese più efficaci

Paolo Galdieri - 3 Giugno 2026

Il Grande Fratello entra in ufficio: il Garante ferma l’IA che valuta lo stress dei dipendenti

Carolina Vivianti - 3 Giugno 2026

La connessione internet in Iran: Perché la sua interruzione è un problema serio

Silvia Felici - 3 Giugno 2026

Altre 150 aziende nel progetto Glasswing! Energia, servizi idrici, sanità, hardware

Redazione RHC - 2 Giugno 2026

Gli hacker criminali colpiscono Carnival. 6 milioni le persone esposte

Luigi Zullo - 2 Giugno 2026

Vulnerabilità nel plug-in Kirki: migliaia di siti WordPress a rischio

Carolina Vivianti - 2 Giugno 2026

Ultime news

Red Hat vittima di attacco alla Suppy Chain: cos’è successo e cosa imparare

Aggiornamenti di sicurezza di giugno per Android: corrette 124 vulnerabilità

IKEA in emergenza cyber: 180 GB di dati a rischio, il gruppo Lapsus$ colpisce ancora!

Documentazione tecnica: un obbligo sottovalutato ma un pilastro della sicurezza

Relazione annuale ACN 2025 : aumento degli attacchi, ma difese più efficaci

Il Grande Fratello entra in ufficio: il Garante ferma l’IA che valuta lo stress dei dipendenti

La connessione internet in Iran: Perché la sua interruzione è un problema serio

Altre 150 aziende nel progetto Glasswing! Energia, servizi idrici, sanità, hardware

Gli hacker criminali colpiscono Carnival. 6 milioni le persone esposte

Vulnerabilità nel plug-in Kirki: migliaia di siti WordPress a rischio

Windows Server sotto attacco: exploit critico Netlogon già attivo nelle reti aziendali

Solo una parola, signore… Supercalifragili stichespiralidoso: perchè si è sempre fatto così!

Scopri le ultime CVE critiche emesse e resta aggiornato sulle vulnerabilità più recenti. Oppure cerca una specifica CVE