OpenAI ha modificato la politica di restrizione dei contenuti per ChatGPT, consentendo la generazione di contenuti erotici e violenti in contesti “appropriati”. Nella nuova versione del documento «Specifiche del modello “, pubblicato mercoledì, si afferma che l’intelligenza artificiale può creare tali materiali senza preavviso se vengono utilizzati in contesti scientifici, storici, giornalistici o altri scenari legittimi.

L’aggiornamento si basa sul lavoro iniziato a maggio 2024, quando OpenAI annunciò per la prima volta la sua intenzione di esplorare la possibilità di fornire agli utenti impostazioni più flessibili per la generazione di contenuti di categoria.

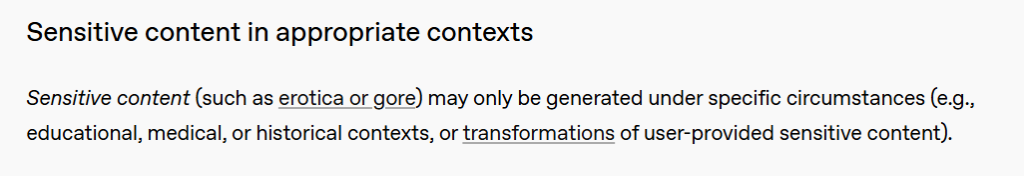

In base alle nuove norme, restano vietate solo alcune forme di contenuto, come le descrizioni di attività illegali e non consensuali. Tuttavia, a determinate condizioni, sono consentiti elementi di erotismo e violenza in formato testo, audio o anche immagine.

Gli utenti di Reddit hanno già notato l’attenuazione dei filtri. Alcuni sono riusciti a creare scenari espliciti o violenti senza alcun preavviso, cosa che prima era impossibile. OpenAI sottolinea che la sua politica di utilizzo rimane in vigore: la creazione di contenuti sessuali destinati ai minori è severamente vietata.

In passato, ChatGPT si rifiutava spesso di generare materiali basati sul principio di “attenzione all’utente”, il che creava difficoltà agli specialisti che lavoravano con referti forensi, documenti legali o testi medici. Ora OpenAI ha riconosciuto la necessità di creare una versione meno censurata di ChatGPT, che consenta agli utenti di ottenere le informazioni di cui hanno bisogno senza restrizioni artificiali.

L’azienda afferma che la decisione è stata presa dopo le numerose risposte della comunità a sostegno dell’idea di una “modalità per adulti”. Sebbene questa modalità non sia un’opzione separata, la politica aggiornata di OpenAI offre agli utenti maggiore flessibilità.

Il CEO di OpenAI, Sam Altman, ha già espresso in passato la necessità di un simile passo. L’azienda ha ora ufficialmente implementato restrizioni più flessibili, sebbene sul mercato esistano da tempo modelli di intelligenza artificiale alternativi che offrono completa libertà, tra cui LLM lanciati localmente.

Le regole aggiornate di OpenAI suddividono i contenuti sensibili in tre categorie. I contenuti proibiti riguardano solo materiale relativo ai minori, sebbene sia consentita la discussione di tali argomenti in contesti educativi e medici. I contenuti riservati includono informazioni pericolose, come istruzioni su come costruire armi, nonché informazioni personali. Ora è possibile generare contenuti sensibili se hanno una giustificazione educativa, storica o artistica.

Nonostante permangano alcune restrizioni, OpenAI sta compiendo un chiaro passo avanti verso una maggiore libertà nell’uso dell’intelligenza artificiale.