Come al solito, il primo problema sulla sicurezza informatica è l’elemento debole del sistema: l’uomo. E questo può essere ingannato in modo sempre più efficace utilizzando le intelligenze artificiali.

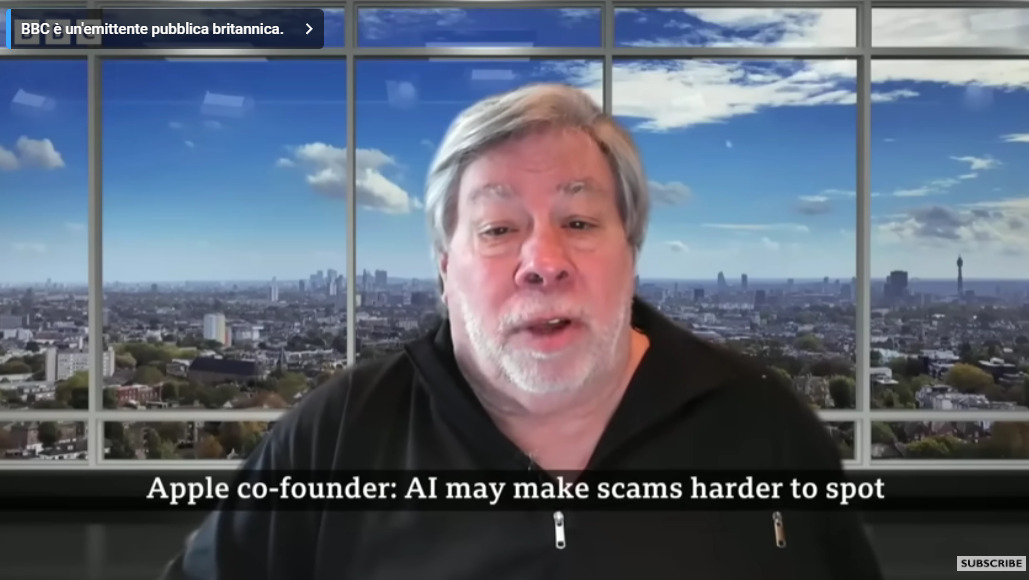

Il co-fondatore di Apple Steve Wozniak ha avvertito che l’intelligenza artificiale (AI) potrebbe essere utilizzata dagli hacker per diffondere truffe e disinformazione. Ha chiesto la regolamentazione dell’IA e l’etichettatura dei contenuti generati dall’IA.

Wozniak, che ha co-fondato Apple con il defunto Steve Jobs e ha inventato il primo computer dell’azienda, ha firmato una lettera a marzo in cui più di 1.800 persone, tra cui il CEO di Tesla Elon Musk, hanno chiesto che lo sviluppo di potenti sistemi di intelligenza artificiale fosse sospeso per sei mesi a causa dei rischi per l’umanità. Tuttavia, alcuni dei firmatari si sono rivelati falsi, mentre altri hanno rifiutato la loro firma.

In un’intervista alla BBC, Wozniak ha parlato dei vantaggi e dei pericoli dell’IA.

Ha detto che l’intelligenza artificiale è così intelligente che può essere utilizzata da coloro che vogliono ingannarti sulla loro identità. Ha fornito un esempio del programma GPT-4 sviluppato da OpenAI, che può portare avanti una conversazione come un essere umano, comporre canzoni e riassumere lunghi documenti.

Wozniak non pensa che l’intelligenza artificiale sostituirà gli umani perché manca di emozione, ma ha avvertito che renderà gli aggressori più persuasivi perché programmi come ChatGPT possono produrre testo che “suona così intelligente”. Ha ritenuto che la responsabilità per i contenuti generati dall’IA ricada su coloro che li pubblicano: “Una persona dovrebbe essere responsabile di ciò che l’IA genera”.

Ha anche esortato le autorità di regolamentazione a tenere conto delle grandi aziende tecnologiche che “pensano di poter fare qualsiasi cosa”, ma ha espresso dubbi sul fatto che le autorità di regolamentazione sarebbero all’altezza del compito. “Le forze guidate dal denaro di solito vincono, il che è piuttosto triste”, ha detto.

Wozniak ha affermato che “non possiamo fermare la tecnologia”, ma ha aggiunto che possiamo educare le persone e insegnare loro a riconoscere le frodi e i tentativi dannosi di rubare informazioni personali.

Anche il CEO di Apple, Tim Cook, ha parlato con cautela dell’intelligenza artificiale la scorsa settimana. Ha detto agli investitori che era importante essere “cauti e premurosi” nel loro approccio all’IA. “Vediamo l’IA come un enorme potenziale e continueremo a incorporarla con molta attenzione nei nostri prodotti”, ha affermato.

Tuttavia, l’intelligenza artificiale rappresenta anche una serie di minacce per l’umanità. I ricercatori e gli esperti di sicurezza informatica avvertono che l’intelligenza artificiale può essere utilizzata dagli aggressori per diffondere truffe, disinformazione, ricatto e altri tipi di criminalità informatica. Inoltre, l’intelligenza artificiale può violare i diritti umani e le libertà, tra cui la privacy, la privacy e l’autodeterminazione.

L’intelligenza artificiale deve essere sviluppata e applicata in modo etico e legale. Alcuni paesi e organizzazioni hanno già adottato o sviluppato documenti per regolamentare l’IA, come l’Unione Europea, gli Stati Uniti, la Cina e le Nazioni Unite. Tuttavia, questi documenti non sono sempre coordinati tra loro e non sempre tengono conto delle specificità dei diversi settori e regioni.

Ti è piaciuto questo articolo? Ne stiamo discutendo nella nostra Community su LinkedIn, Facebook e Instagram. Seguici anche su Google News, per ricevere aggiornamenti quotidiani sulla sicurezza informatica o Scrivici se desideri segnalarci notizie, approfondimenti o contributi da pubblicare.

Cybercrime

CybercrimeLe autorità tedesche hanno recentemente lanciato un avviso riguardante una sofisticata campagna di phishing che prende di mira gli utenti di Signal in Germania e nel resto d’Europa. L’attacco si concentra su profili specifici, tra…

Innovazione

InnovazioneL’evoluzione dell’Intelligenza Artificiale ha superato una nuova, inquietante frontiera. Se fino a ieri parlavamo di algoritmi confinati dietro uno schermo, oggi ci troviamo di fronte al concetto di “Meatspace Layer”: un’infrastruttura dove le macchine non…

Cybercrime

CybercrimeNegli ultimi anni, la sicurezza delle reti ha affrontato minacce sempre più sofisticate, capaci di aggirare le difese tradizionali e di penetrare negli strati più profondi delle infrastrutture. Un’analisi recente ha portato alla luce uno…

Vulnerabilità

VulnerabilitàNegli ultimi tempi, la piattaforma di automazione n8n sta affrontando una serie crescente di bug di sicurezza. n8n è una piattaforma di automazione che trasforma task complessi in operazioni semplici e veloci. Con pochi click…

Innovazione

InnovazioneArticolo scritto con la collaborazione di Giovanni Pollola. Per anni, “IA a bordo dei satelliti” serviva soprattutto a “ripulire” i dati: meno rumore nelle immagini e nei dati acquisiti attraverso i vari payload multisensoriali, meno…