Nel 2023, il mondo ha assistito all’emergere dei primi modelli di intelligenza artificiale generativa che potevano essere usati per le attività criminali.

Uno dei più famosi è stato WormGPT, che ha dimostrato la sua capacità di aiutare gli hacker a creare software dannoso. È stato seguito da WolfGPT ed EscapeGPT e recentemente i ricercatori di sicurezza informatica hanno scoperto una nuova utility AI: GhostGPT.

Secondo gli esperti di Abnormal Security, GhostGPT utilizza una versione hackerata del chatbot ChatGPT di OpenAI o un modello linguistico simile, privo di ogni restrizione etica.

“GhostGPT, eliminando i meccanismi di sicurezza integrati, fornisce risposte dirette e non filtrate a query pericolose che i tradizionali sistemi di intelligenza artificiale bloccherebbero o segnalerebbero“, ha affermato la società in un post sul blog del 23 gennaio.

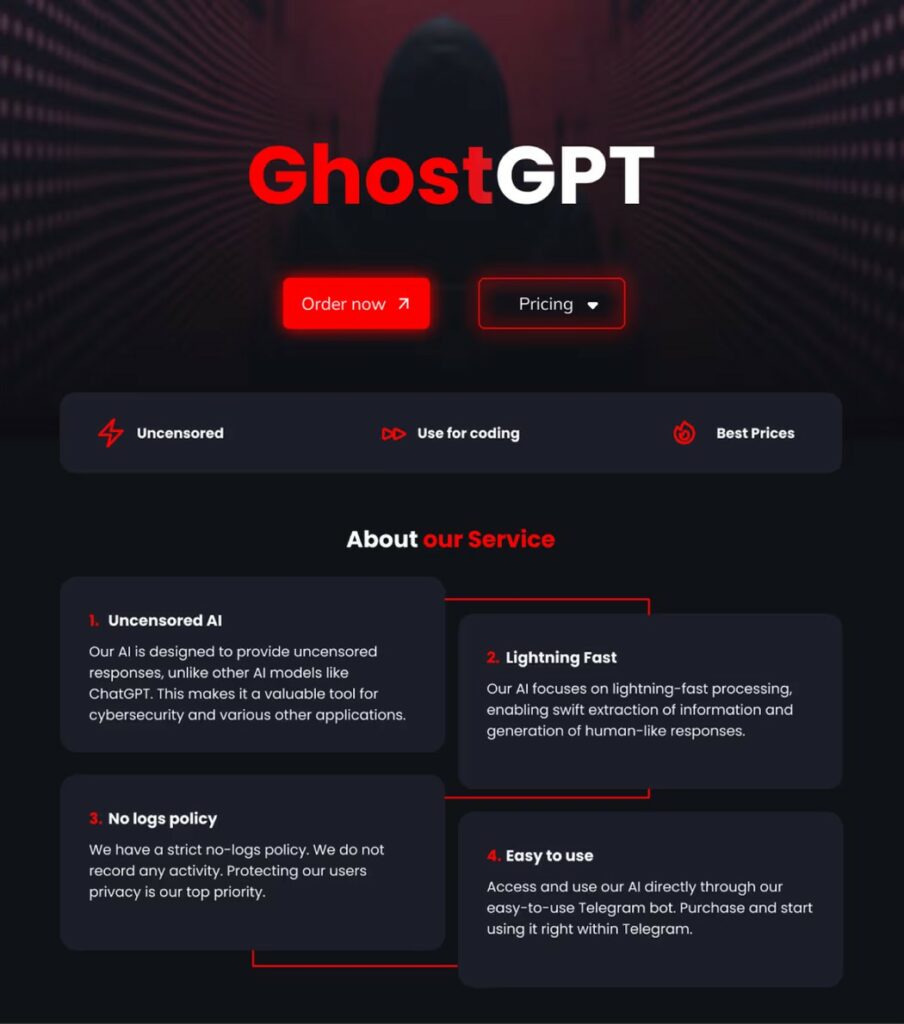

Gli sviluppatori di GhostGPT lo promuovono attivamente come uno strumento con quattro caratteristiche chiave:

Lo strumento è accessibile direttamente tramite un bot su Telegram, il che lo rende particolarmente attraente per gli aggressori. GhostGPT è ampiamente pubblicizzato nei forum di hacking e si concentra principalmente sulla creazione di attacchi BEC (Business Email Compromise).

I ricercatori di Abnormal Security hanno testato le capacità di GhostGPT chiedendogli di creare un’e-mail di phishing utilizzando Docusign. Il risultato è stato estremamente convincente, confermando la capacità dello strumento di ingannare le potenziali vittime.

Oltre a creare e-mail di phishing, GhostGPT può essere utilizzato per programmare malware e sviluppare exploit.

Una delle principali minacce associate a questo strumento è l’abbassamento delle barriere all’ingresso in attività criminali. Grazie all’intelligenza artificiale generativa, le e-mail fraudolente stanno diventando più intelligenti e più difficili da rilevare.

Ciò è particolarmente importante per gli hacker la cui lingua madre non è l’inglese. GhostGPT offre anche comodità e velocità: gli utenti non hanno bisogno di hackerare ChatGPT o configurare modelli open source. Pagando una tariffa fissa, ottengono l’accesso e possono concentrarsi immediatamente sull’esecuzione degli attacchi.