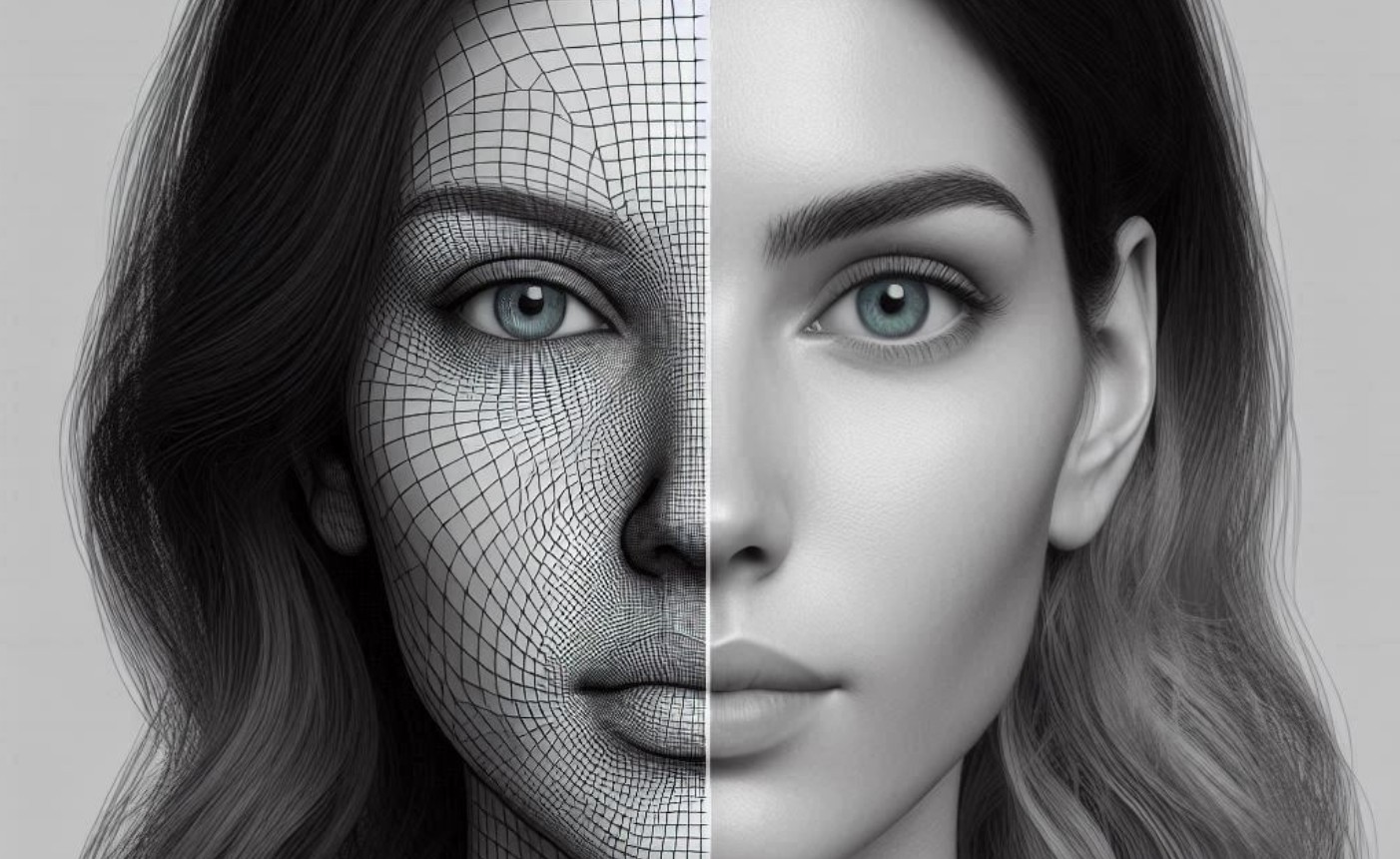

I moderni strumenti di intelligenza artificiale generativa hanno reso la creazione di pornografia deepfake accessibile a tutti. Un rapporto del 2023 della società di revisione dei servizi di protezione dai furti di identità Home Security Heroes ha scoperto che sono necessarie solo un’immagine chiara di un volto e meno di 25 minuti per creare un video pornografico deepfake di 60 secondi. Ciò è reso possibile grazie a strumenti gratuiti.

La questione è stata portata all’attenzione del pubblico nel gennaio 2023 da immagini grafiche deepfake di Taylor Swift che sono circolate sui social media e hanno ricevuto 47 milioni di visualizzazioni prima di essere rimosse. Casi simili hanno colpito non solo le star dello spettacolo, come le pop star coreane, ma anche la gente comune. Secondo il rapporto, il 99% delle vittime di tali video sono donne e ragazze.

Questa situazione provoca un’azione attiva da parte delle donne. La fondatrice di startup, Nadia Lee, ha dichiarato: “Se la tecnologia di sicurezza non si evolve alla stessa velocità dell’intelligenza artificiale, siamo diretti verso il disastro”. Nonostante la ricerca sul rilevamento dei deepfake, questi strumenti non hanno tenuto il passo con la tecnologia utilizzata per crearli. Inoltre, la loro efficacia dipende dalla volontà delle piattaforme di combattere i deepfake e la maggior parte di questi video vengono pubblicati su siti specializzati.

L’azienda di Lee, That’sMyFace , sviluppa strumenti di riconoscimento delle immagini per clienti aziendali per impedire che i loro loghi, uniformi o prodotti appaiano nella pornografia. In futuro, si prevede di creare uno strumento per scansionare Internet alla ricerca di immagini o video deepfake con i volti degli utenti.

La fondatrice della startup Alecto AI , Breeze Liu, è stata vittima della pornografia deepfake nel 2020, scoprendo più di 800 collegamenti a video falsi. La polizia era impotente e ha dovuto monitorare e cancellare essa stessa i video. Liu ha deciso di utilizzare l’intelligenza artificiale per combattere l’intelligenza artificiale e ha creato un’applicazione per verificare l’utilizzo delle immagini facciali degli utenti sulle principali piattaforme social.

Liu è in trattative con Meta su un programma pilota che fornirà la moderazione automatizzata dei contenuti. In futuro, lo strumento potrebbe entrare a far parte dell’infrastruttura dell’identità online, consentendo di controllare i profili falsi sui social network e sui siti di incontri.

Rimuovere i contenuti deepfake dai social media è un compito difficile, e dalle piattaforme pornografiche ancora più difficile. Gli avvocati della difesa contro le aggressioni sessuali affermano che è necessaria un’azione legislativa. Susanna Gibson, che ha fondato l’organizzazione no-profit MyOwn dopo un’esperienza personale con i deepfake, ha fatto emettere in Virginia nel 2023 delle leggi contro la “pornografia per vendetta”. Nonostante gli sforzi, tali leggi non sono ancora diffuse a livello federale.

Quarantanove stati degli Stati Uniti, più il Distretto di Columbia, hanno leggi contro la distribuzione non autorizzata di immagini intime, ma la loro efficacia varia. Le leggi spesso richiedono la prova dell’intenzione dell’aggressore di causare danni, cosa difficile da dimostrare. Inoltre, non esiste consenso tra le giurisdizioni sul fatto se la distribuzione di pornografia deepfake debba essere considerata un reato penale o civile e se i distributori o le piattaforme debbano essere ritenuti responsabili.

Nel 2023, il Regno Unito ha approvato una legge che criminalizza la distribuzione di pornografia deepfake e l’Unione Europea ha adottato una direttiva contro la violenza informatica, compresi i deepfake, con attuazione fino al 2027. Anche Australia e Corea del Sud hanno leggi contro la distribuzione di tali materiali. Esistono restrizioni alla distribuzione di contenuti sintetici in Cina , ma la loro efficacia non è stata ancora dimostrata.

Anche se le misure legislative non sortiscono l’effetto desiderato, startup come Alecto AI e That’sMyFace vengono in soccorso. Tuttavia, queste misure sono utili ma non sufficienti. La società deve agire maggiormente per prevenire la violenza sessuale in tutte le sue forme soprattutto in questo periodo che la tecnologia deepfake sta diventando sempre più diffusa ed accessibile a tutti.

Ti è piaciuto questo articolo? Ne stiamo discutendo nella nostra Community su LinkedIn, Facebook e Instagram. Seguici anche su Google News, per ricevere aggiornamenti quotidiani sulla sicurezza informatica o Scrivici se desideri segnalarci notizie, approfondimenti o contributi da pubblicare.

Cybercrime

CybercrimeLe autorità tedesche hanno recentemente lanciato un avviso riguardante una sofisticata campagna di phishing che prende di mira gli utenti di Signal in Germania e nel resto d’Europa. L’attacco si concentra su profili specifici, tra…

Innovazione

InnovazioneL’evoluzione dell’Intelligenza Artificiale ha superato una nuova, inquietante frontiera. Se fino a ieri parlavamo di algoritmi confinati dietro uno schermo, oggi ci troviamo di fronte al concetto di “Meatspace Layer”: un’infrastruttura dove le macchine non…

Cybercrime

CybercrimeNegli ultimi anni, la sicurezza delle reti ha affrontato minacce sempre più sofisticate, capaci di aggirare le difese tradizionali e di penetrare negli strati più profondi delle infrastrutture. Un’analisi recente ha portato alla luce uno…

Vulnerabilità

VulnerabilitàNegli ultimi tempi, la piattaforma di automazione n8n sta affrontando una serie crescente di bug di sicurezza. n8n è una piattaforma di automazione che trasforma task complessi in operazioni semplici e veloci. Con pochi click…

Innovazione

InnovazioneArticolo scritto con la collaborazione di Giovanni Pollola. Per anni, “IA a bordo dei satelliti” serviva soprattutto a “ripulire” i dati: meno rumore nelle immagini e nei dati acquisiti attraverso i vari payload multisensoriali, meno…