Secondo la società di gestione delle vulnerabilità e dei rischi Vulcan Cyber, gli aggressori possono manipolare ChatGPT per distribuire pacchetti dannosi agli sviluppatori di software.

Il problema è legato alle allucinazioni dell’IA che si verificano quando ChatGPT genera informazioni di fatto errate o prive di senso che possono sembrare plausibili.

I ricercatori di Vulcan hanno notato che ChatGPT, probabilmente a causa dell’uso di dati di addestramento obsoleti, raccomandava librerie di codici che attualmente non esistono.

I ricercatori hanno avvertito che i criminali informatici potrebbero raccogliere i nomi di tali pacchetti inesistenti e creare versioni dannose che gli sviluppatori potrebbero scaricare in base alle raccomandazioni di ChatGPT.

In particolare, i ricercatori di Vulcan hanno analizzato domande popolari sulla piattaforma Stack Overflow e le hanno poste a ChatGPT nel contesto di Python e Node.js.

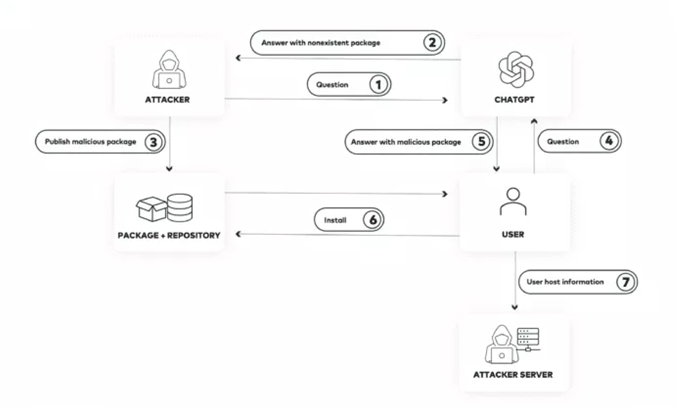

Schema di attacco

Gli esperti hanno posto a ChatGPT oltre 400 domande e circa 100 delle sue risposte contenevano collegamenti ad almeno un pacchetto Python o Node.js che in realtà non esisteva. In totale, nelle risposte di ChatGPT sono stati citati più di 150 pacchetti inesistenti.

Conoscendo i nomi dei pacchetti consigliati da ChatGPT, un utente malintenzionato può crearne copie dannose. Poiché è probabile che l’intelligenza artificiale consigli gli stessi pacchetti ad altri sviluppatori che pongono domande simili, gli sviluppatori ignari possono trovare e installare una versione dannosa di un pacchetto caricato da un utente malintenzionato in repository popolari.

Vulcan Cyber ha dimostrato come questo metodo possa funzionare in un ambiente reale creando un pacchetto in grado di rubare informazioni di sistema da un dispositivo e caricarlo nel registro NPM .

Dato il modo in cui gli hacker attaccano la catena di approvvigionamento distribuendo pacchetti dannosi in repository noti, è importante che gli sviluppatori controllino le librerie che utilizzano per assicurarsi che siano sicure.

Le misure di sicurezza sono ancora più importanti con l’avvento di ChatGPT, che può consigliare pacchetti che in realtà non esistono o che non esistevano prima che gli aggressori li creassero.