Gli scienziati di Google e dell’Università di Osaka in Giappone sono stati in grado di ricreare la musica basata sull’attività del cervello umano. Il modello è stato chiamato Brain2Music.

L’esperimento è iniziato con un gruppo di soggetti che ascoltavano campioni di musica di vari generi (rock, classica, metal, hip-hop, pop, jazz e altri).

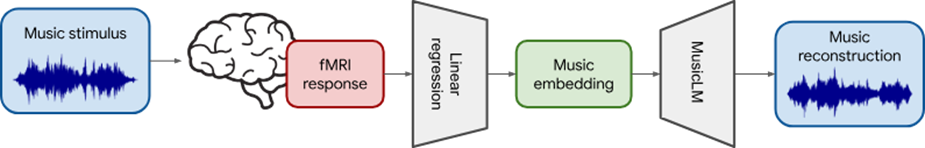

Mentre ascoltavano, gli scienziati hanno utilizzato la risonanza magnetica funzionale (fMRI) per registrare l’attività cerebrale degli ascoltatori. I dati risultanti sono stati quindi utilizzati per addestrare la rete neurale a rilevare attività associate a varie caratteristiche della musica, come genere, umore e strumentazione.

Schema di studio

Un passaggio chiave nella ricerca ha comportato l’utilizzo del modello MusicLM di Google. Questo modello genera musica sulla base di descrizioni testuali.

Dopo aver collegato il database MusicLM con i dati fMRI, gli scienziati sono stati in grado di sviluppare un modello di intelligenza artificiale che ha ricreato la musica ascoltata dai soggetti. Invece delle istruzioni testuali per MusicLM, l’attività cerebrale ha fornito il contesto per l’output musicale.

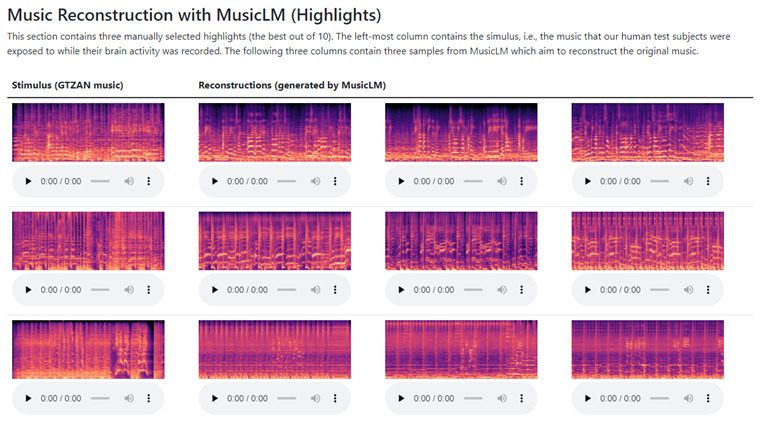

Gli scienziati forniscono esempi delle migliori generazioni di Brain2Music

La musica ricreata è semanticamente simile al motivo musicale originale, poiché l’IA crea musica che riproduce i motivi ascoltati dai soggetti del test in termini di proprietà semantiche, come genere, strumentazione e umore.

Ad esempio, nella “copia” di una canzone, il suono degli strumenti e il ritmo corrispondevano bene all’originale, ma le parole erano illeggibili. Secondo gli scienziati, il modello Brain2Music si concentra sulla ricreazione della strumentazione e dello stile, non del testo.

Gli esperti hanno notato che lo studio fornisce per la prima volta un’interpretazione quantitativa da un punto di vista biologico. Nonostante i progressi nei modelli di testo in musica, il funzionamento interno di tali modelli è ancora poco compreso.

Tuttavia, la possibilità di ricreare melodie perfettamente orchestrate basate sull’attività cerebrale potrebbe diventare una realtà nel prossimo futuro. Gli scienziati affermano che il prossimo passo sarà cercare di ricreare la musica o l’armamentario musicale dall’immaginazione umana.