“Ora che il genio è uscito dalla lampada, è impossibile rimetterlo dentro!”. Quante volte abbiamo scritto queste parole riguarda l’intelligenza artificiale?

Ora che il genio è fuori, come nei racconti delle Mille e una notte, non possiamo far finta che nulla sia cambiato. Le tecnologie basate sull’IA ci stanno cambiando rapidamente – e profondamente – in ogni aspetto della nostra vita. Scriviamo con l’AI, parliamo con l’AI, disegniamo con l’AI, scriviamo musica con l’AI e ancora programmiamo, impariamo e perfino pensiamo con l’AI.

Ma siamo davvero pronti?

A guardarci indietro, da Alan Turing a John von Neumann passando da Marvin Minsky a John McCarthy – l’uomo che coniò il termine “intelligenza artificiale” nel 1956 e che partecipò al Tech Model Railroad Club dell’MIT di Boston dove è nata la cultura hacker – di strada ne abbiamo fatta tanta. Ma nonostante le intuizioni geniali, questi pionieri difficilmente avrebbero potuto immaginare che un giorno, nella tasca di miliardi di persone, ci sarebbero stati degli assistenti intelligenti in grado di conversare, scrivere codice, comporre musica e generare immagini in pochi istanti.

Eppure, per quanto il progresso sia stupefacente, il rischio più grande che oggi corriamo non è l’estinzione dell’umanità per mano di una super intelligenza, come ci ricorda la cultura cyberpunk con skynet e terminator. La cosa è molto più sottile. È la perdita progressiva della nostra capacità di pensare. Di ragionare. Di collegare, immaginare e valutare criticamente.

Lo chiamano “decadimento mentale”. Ed è l’ombra che incombe dietro ogni promessa dell’intelligenza artificiale.

Per controllare i computer intelligenti, abbiamo bisogno di esseri umani ancora più intelligenti dei computer, ma l’intelligenza artificiale ci spinge solo a scaricare le informazioni e a lasciare che siano i computer a pensare per noi.

È questa la riflessione – sempre più condivisa da studiosi, educatori e filosofi – che dovrebbe farci riflettere. Come osserva anche Yuval Noah Harari, autore di Homo Deus, se le persone iniziano a delegare le loro decisioni agli agenti intelligenti, perderanno progressivamente la capacità di decidere.

Il punto cruciale è il seguente: tutto sta diventando troppo facile.

Scrivere un tema? C’è l’AI. Fare un’analisi di mercato? C’è l’AI. Riassumere un libro, pianificare un viaggio, interpretare un testo difficile, progettare una strategia aziendale? C’è sempre l’AI. E questo sta progressivamente indebolendo il nostro “muscolo cognitivo”. Ed è tutto direttamente proporzionale: più diventa facile, più diventiamo pigri.

Infatti molte persone iniziano a praticare quello che gli anglosassoni chiamano raw-dogging con l’intelligenza artificiale, per descrivere il rapporto diretto e privo di filtri che alcuni utenti stanno iniziando ad avere con l’IA. Questo conferma lo studio di Microsoft e della Carnegie Mellon University, che ha rilevato che una maggiore dipendenza dagli strumenti di intelligenza artificiale sul lavoro era collegata a una riduzione delle capacità di pensiero critico. Inoltre, anche uno studio del Massachusetts Institute of Technology (MIT) ha analizzato cosa succede nel nostro cervello con un uso intensivo di ChatGPT correlandolo al deficit cognitivo.

Si, di studi ne stanno uscendo molti e tutti concordano nella stessa direzione.

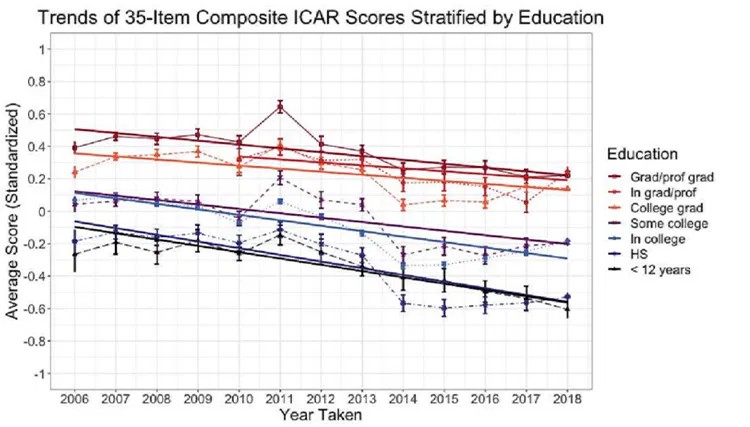

Ma a dire il vero, il solco era già stato tracciato. A partire dal 1973 si sono osservati segnali di una progressiva riduzione del quoziente intellettivo, fenomeno che alcuni studiosi collegano all’introduzione massiva della televisione nelle case. Quello che per decenni è stato un trend positivo nei Paesi industrializzati — noto come effetto Flynn — sta oggi mostrando una pericolosa inversione di tendenza che viene chiamata dagli studiosi “reverse effect flynn”.

I decrementi recenti vengono attribuiti a fattori ambientali, sistemi educativi sempre più “semplificati”, uso massiccio dei media digitali, calo della lettura profonda e delega cognitiva a strumenti esterni.

E l’IA è la ciliegina sulla torta in tutto questo.

Ma oltre al rischio del decadimento mentale, l’impatto dell’intelligenza artificiale è molto più ampio: investe numerosi ambiti e riguarda l’intera società. Questo perchè:

l’intelligenza artificiale non è neutrale!

È uno strumento potente nelle mani di pochi. Oggi i modelli più avanzati sono controllati da una manciata di big player globali: Microsoft (con OpenAI), Google (con Gemini), Apple (con i suoi nuovi agenti Siri), Amazon, Meta. E non bisogna farsi illusioni: il loro mandato non è migliorare la condizione umana o la fame nel mondo, è sempre e soltanto uno: generare profitto.

Questo fa si che l’economia diventa “polarizzata”, dove pochi traggono vantaggio dalla sostituzione del lavoro umano con l’IA, e molti ne subiscono gli effetti. Inoltre, le loro risorse computazionali, i loro data center e la loro capacità di accesso a enormi moli di dati non sono replicabili dai comuni mortali, né tantomeno dagli Stati più poveri.

Ad esempio il report “The Work of the Future: Building Better Jobs in an Age of Intelligent Machines” pubblicato nel 2020 dal MIT Task Force on the Work of the Future evidenzia chiaramente come, nonostante la crescita della produttività, i frutti dell’automazione e dell’IA questi siano distribuiti in modo fortemente squilibrato.

Questo significa che l’AI rischia di ampliare il divario già esistente tra ricchi e poveri, tra Nord e Sud del mondo, tra chi ha accesso agli strumenti e chi ne è escluso. Secondo un’analisi del World Economic Forum del 2024, l’80% dei benefici dell’automazione intelligente si sta concentrando nei Paesi G7, mentre in Africa e America Latina si assiste a una crescita dell’automazione senza una corrispondente crescita nelle competenze digitali. Un abisso che rischia di diventare incolmabile.

E in questo abisso si nasconde la vera minaccia: che l’intelligenza artificiale non è solo un acceleratore di disuguaglianze economiche, ma anche culturali ed esistenziali. Perché chi possiede gli algoritmi possiede anche la capacità di orientare pensieri, i consumi e i comportamenti. E mentre i più fortunati potranno permettersi di “affittare” intelligenze artificiali per potenziare la propria mente, miliardi di persone rischiano di diventare solo utenti passivi di un sistema progettato altrove, incapaci di partecipare, di capire e persino di scegliere.

È qui che la tecnologia, da strumento per liberare l’uomo, rischia di trasformarsi definitivamente in una gabbia invisibile e insuperabile gestita completamente dalle macchine.

Nel prossimo decennio, l’IA non si limiterà più a rispondere alle nostre domande o a generare contenuti su richiesta: diventerà onnipresente e invisibile all’interno delle nostre vite. Ogni individuo avrà un assistente IA personalizzato, che gestirà dalla pianificazione quotidiana alla salute mentale,

I sistemi di intelligenza artificiale evolveranno fino a conoscere ogni dettaglio di noi, anticipando desideri e paure, adattando in tempo reale notizie, intrattenimento e relazioni sociali per massimizzare la nostra attenzione.

Vivremo circondati da assistenti digitali talmente raffinati da sembrare persone vere, capaci di accompagnarci in ogni scelta quotidiana, fino a influenzare ciò che sogniamo di diventare.

In parallelo, la nostra stessa mente rischia di cambiare. Con l’abitudine di delegare processi creativi, analitici e decisionali, assisteremo ad una trasformazione silenziosa ma profonda come visto nel capitolo precedente “pensiamo sempre meno con la nostra testa”.

Saremo quindi un’umanità sempre più abituata a risposte immediate e sempre meno allenata alla complessità. Il pensiero critico e la capacità di sostenere il dubbio potrebbero apparire superflui, sostituiti da algoritmi che semplificano ogni questione. La memoria diventerà esterna, archiviata nei server, mentre l’immaginazione verrà condivisa e plasmata da reti neurali che pensano più in fretta di noi.

Al tempo stesso, la disuguaglianza tecnologica potrebbe generare nuove fratture sociali. Chi avrà accesso agli strumenti più avanzati sarà in grado di amplificare il proprio talento e la propria influenza, mentre una vasta parte della popolazione rischierà di rimanere spettatrice, incapace di comprendere o controllare le logiche che governano il mondo digitale anche costretta da futuri “Muri digitali“. Le democrazie dovranno affrontare la sfida di piattaforme sempre più potenti, in grado di orientare il consenso e alimentare “polarizzazioni” mai viste prima.

La differenza tra chi controlla l’IA e chi ne subisce gli effetti potrebbe diventare la nuova linea di confine tra potere e impotenza.

E probabilmente, dopo esserci spinti così oltre e aver realizzato che l’uomo rischia di trasformarsi in un servitore delle macchine, qualche stato potrà capire che sia necessario invertire la rotta. Potrebbe nascere l’idea di educare le nuove generazioni riscoprendo metodi didattici d’inizio ’900, anche se questo è un esempio. Si potrebbero ipotizzare la creazione di “sacche” di de-digitalizzazione. Ne parlavo nell’articolo del 2020 introducendo il concetto di de-digitalization. E questo modo di agire consentirebbe di eliminare, agenti AI fuori controllo, sorveglianza di massa, dipendenza tecnologica e influenza disconnettendosi da internet e creare reti indipendenti supervisionare dagli stati o da federazioni di stati che appoggiano politiche di de digitalizzazione.

In sintesi, Runet, Great Firewall of China, dazi, terre rare, sono solo parte di un percorso che porterà il mondo ad erigere questi “muri”, per creare un cyber space isolati, dove i tempi della collaborazione tra i popoli verrà dimenticato perché il predominio del mondo è di carattere tecnologico e non più umano.

Se sapremo immaginare una tecnologia che non sostituisce l’umano, ma lo potenzia, potremmo entrare in un’era dove l’intelligenza artificiale diventa alleata della creatività e della conoscenza condivisa. Potremmo creare ecosistemi digitali che proteggono la privacy, favoriscono l’inclusione e restituiscono il tempo per pensare, sperimentare, sbagliare.

Ma l’umano non ragiona così. Pensa sempre al suo interesse.

Quando le macchine diventeranno così brave da farci confondere (e avverrà a breve) tra statistica e anima, la discussione sarà se abbiano o meno dei diritti oppure no. il tema in quel momento sarà chiedersi: cos’è l’anima? Può essere rappresentata da un corpo in silicio mosso da pura statistica? E li ne vedremo delle belle.

Una volta le grandi sfide erano prettamente tecnologiche: creare il primo computer, inviare un uomo sulla Luna, costruire reti sempre più potenti. Oggi, invece, la vera sfida non riguarda più soltanto la tecnologia, ma l’uomo stesso. In un’epoca in cui le macchine iniziano a “pensare”, progettare sistemi più avanzati diventa secondario rispetto a una questione ben più profonda: come proteggere ciò che ci rende umani.

Non è un caso che già si inizi a parlare di linguaggio “human” per comunicare con queste intelligenze artificiali (quasi AGI, premesso che qualcuno sappia capire cosa voglia dire questo termine), ma comunque sempre più pervasive. Alla London Technology Week di giugno, qualcuno ha scherzosamente affermato che «il nuovo linguaggio di programmazione del futuro dovrebbe chiamarsi Human!». Una battuta, certo, ma che fotografa perfettamente il momento storico che stiamo vivendo: le macchine ci costringono a rapportarsi con loro con il linguaggio naturale, con il nostro stesso linguaggio, non più per dominare la tecnologia, ma per riuscire a dialogare con essa senza perdere noi stessi.

In questo scenario, psicologia e tecnologia si stanno fondendo. Si parlava qualche anno fa di etica e di differenze di genere. Sono problemi già dimenticati e superati purtroppo. Ora si è passati a cosa più serie e si moltiplicano gli studi per capire come l’essere umano possa adattarsi a un mondo digitale dominato da assistenti intelligenti, robot, chatbot e sistemi predittivi, senza sacrificare memoria, spirito critico e creatività. È un equilibrio fragile, in cui la posta in gioco non è solo l’efficienza o la produttività, ma la nostra stessa capacità di ragionare e di pensare con la nostra testa.

Nel frattempo, la politica si trova sospesa tra gli interessi delle big tech – che oggi contano quanto intere economie nazionali – e l’incapacità di leggere davvero i pericoli di lungo termine. Così facendo, si rischia di spalancare le porte a una diffusione capillare degli agenti digitali, che se da un lato ci semplificano la vita, dall’altro erodono lentamente le capacità cognitive dei più giovani.

Un lento scivolare verso un mondo in cui non saremo più padroni delle nostre scelte, ma semplici esecutori di ciò che le macchine ci suggeriscono. E lo faranno talmente bene che ci fideremo totalmente di loro.

Eppure, proprio nella consapevolezza di questo rischio si nasconde un seme di speranza. Perché se la grande sfida è “umana”, allora solo l’uomo può vincerla: riscoprendo la sua lentezza, il pensiero critico e la creatività come valori indispensabili. Forse non riusciremo a fermare il progresso tecnologico, ma possiamo ancora scegliere di non esserne schiavi e scrivere nei nostri brani musicali, nei nostri articoli, nei nostri codici sorgenti la parola “AI Free”, a significare che quanto prodotto è frutto esclusivamente della mente umana. Saremo nel mercato? Probabilmente no, ma sarà un segnale importanti per molti.

Sta a noi decidere se vivere in un mondo governato dalle macchine o in un mondo dove le macchine restano, comunque, al servizio dell’uomo. La domanda non è più se l’intelligenza artificiale cambierà il mondo. Lo sta già facendo.

La vera domanda è: saremo in grado di restare umani, nel senso più profondo e autentico del termine, in un mondo dominato da macchine pensanti?

Sarebbe bello pensare ad un futuro dove l’IA diventa il microscopio e il telescopio della mente umana, aiutandoci a esplorare domande ancora più grandi che fino ad oggi non hanno avuto risposta. Ma purtroppo ancora questo sogno è nel cassetto.

Ora la sfida non è più tecnologica. È culturale, educativa e soprattutto politica.