Una truffa eseguita ad arte, sfruttava una voce generata da un’intelligenza artificiale che impersonava il ministro della Difesa italiano Guido Crosetto per chiedere ad alcuni magnati italiani di trasferire denaro all’estero.

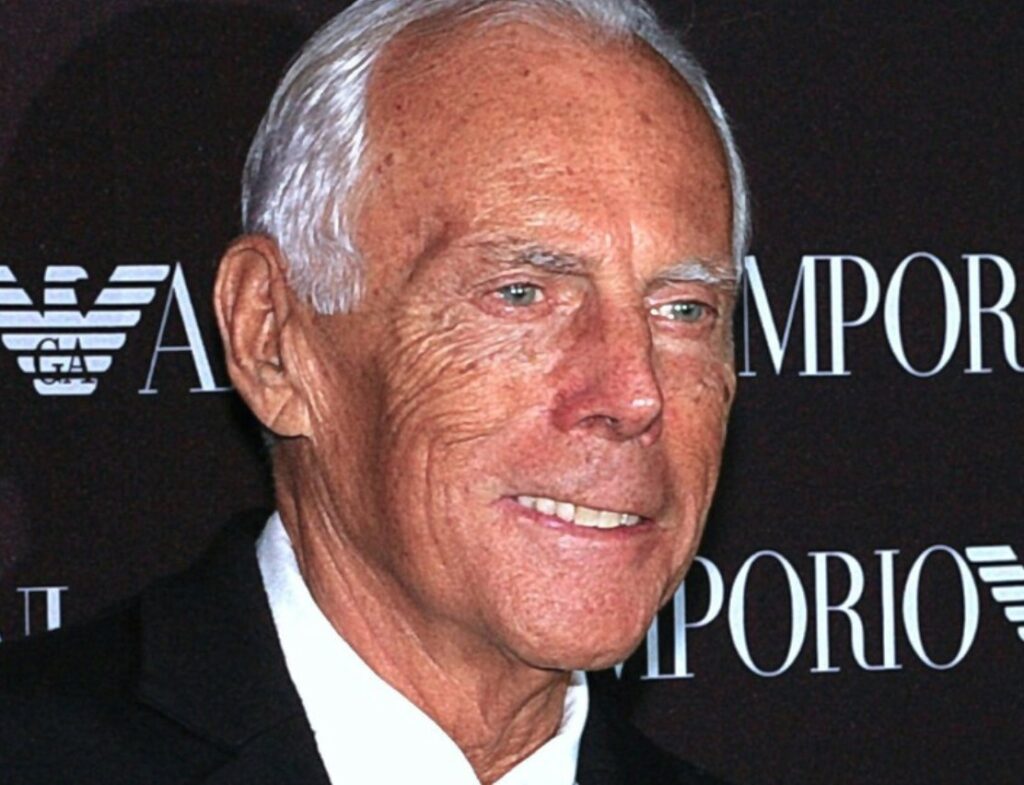

Secondo quanto riportato dai media, i truffatori hanno preso di mira, tra gli altri, lo stilista Giorgio Armani, l’ex proprietario dell’Inter Massimo Moratti, il co-fondatore di Prada Patrizio Bertelli e membri delle famiglie Beretta e Menarini.

La truffa prevedeva telefonate da parte di persone che si spacciavano per Crosetto e il suo staff. Alle vittime veniva chiesto di trasferire una somma di circa 1 milione di euro su un conto bancario con sede a Hong Kong, che, a quanto si diceva, era necessaria per liberare i giornalisti italiani rapiti in Medio Oriente.

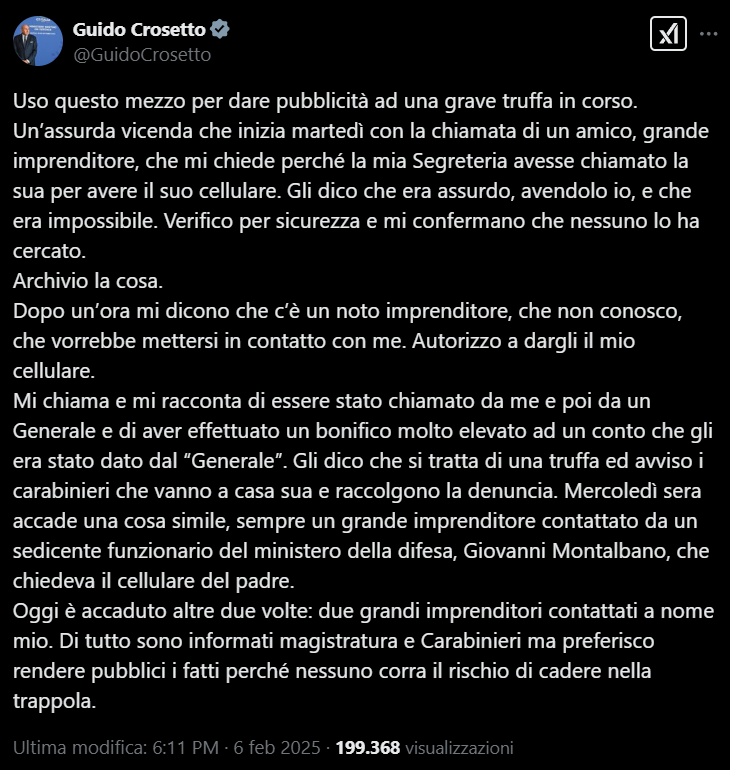

Crosetto ha dichiarato di essere stato contattato da un imprenditore che non conosceva e che aveva trasferito una grossa somma su un conto corrente bancario intestato a un finto “generale Giovanni Montalbano”, dopo aver parlato con qualcuno che l’imprenditore pensava fosse Crosetto.

Il ministro ha affermato di aver informato l’imprenditore che si trattava di una truffa prima di allertare le autorità, che si sono recate a casa dell’individuo per raccogliere informazioni e sporgere denuncia. Crosetto ha affermato che nei giorni successivi ciò si è ripetuto più volte.

“Preferisco rendere pubblici i fatti affinché nessuno corra il rischio di cadere nella trappola”, ha scritto su X. Le autorità italiane stanno ora indagando sulla questione e stanno esaminando l’elenco degli obiettivi. Non è chiaro se la voce di Crosetto fosse un messaggio preregistrato oppure un filtro creato con l’intelligenza artificiale che ha permesso ai truffatori di modificare la sua voce in tempo reale.

La truffa è avvenuta poco dopo che il governo di Giorgia Meloni aveva ottenuto il rilascio di Cecilia Sala , la giornalista italiana detenuta per circa un mese nel famigerato carcere di Evin a Teheran prima di essere liberata a metà gennaio. Tra le persone prese di mira dai truffatori, Moratti avrebbe già sporto denuncia, così come le famiglie Aleotti e Beretta, secondo quanto riportato dai media italiani.

I deepfake sono contenuti multimediali falsificati tramite intelligenza artificiale, capaci di replicare in modo estremamente realistico il volto, la voce e i movimenti di una persona. Questa tecnologia può essere usata per scopi leciti, come il doppiaggio cinematografico o la ricostruzione storica, ma anche per truffe, disinformazione e manipolazione politica.

Esistono due principali tipi di deepfake: quelli video, in cui il volto di una persona viene sostituito o alterato con risultati quasi indistinguibili dalla realtà, e quelli audio, dove la voce viene clonata e utilizzata per creare false dichiarazioni o impersonare individui. Con l’avanzare della tecnologia, queste falsificazioni stanno diventando sempre più difficili da riconoscere a orecchio o a occhio nudo.

Per proteggersi dai deepfake, è fondamentale verificare sempre le fonti di video e registrazioni audio, soprattutto se provengono da canali non ufficiali. Strumenti di analisi forense, software di rilevamento AI e il confronto con fonti affidabili possono aiutare a smascherare manipolazioni sofisticate.

Inoltre, evitare di condividere pubblicamente grandi quantità di contenuti vocali e video personali riduce il rischio di clonazione. La consapevolezza e l’educazione digitale sono le armi migliori per difendersi da questa minaccia in continua evoluzione.