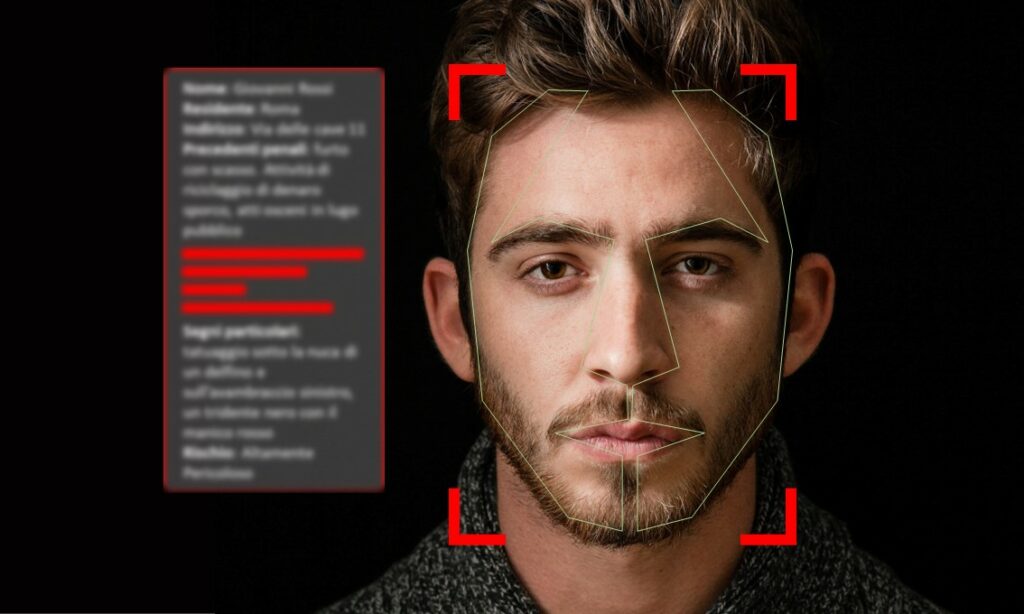

Negli ultimi 30 anni l’AI ha fatto passi da gigante. Con l’ascesa dei Deepfakes, molti ricercatori sono sempre più preoccupati della loro capacità di diffondere informazioni false.

Per fare un esempio, è perfettamente possibile per un gruppo politico creare un deepfake di un avversario, danneggiando così il sistema elettorale attraverso la pura manipolazione.

In questi anni molti deepfake stanno prendendo piede anche nell’industria pornografica, facendo indossare le sembianze del povero malcapitato ad attori professionisti, causando così umiliazioni e danneggiandone la reputazione.

Nella vita di tutti i giorni sono pochi gli strumenti a disposizione dei consumatori per identificare i deepfakes.

Intel annuncia che ha recentemente sviluppato un rilevatore di deepfake in tempo reale, dove si avrà la possibilità da parte degli utenti di caricare file video sospetti per verificare se si tratta effettivamente di Deepfake.

Ha detto Ilke Demir, ricercatore senior nei laboratori Intel

La nuova soluzione davvero innovativa si chiama FakeCatcher, ed utilizza l’hardware e il software di Intel, per analizzare informazioni come il colore della pelle che cambia con il fluire del sangue, che a sua volta varia con il battito cardiaco e il movimento dei muscoli. Si tratta di analizzare dei sottili cambiamenti che spesso sono ignorati nei deepfake.

Secondo Intel, i test preliminari del sistema forniscono un’accuratezza del 96%, un dato importante nella lotta contro questo tipo di tecnologie.

Inoltre, la tecnologia potrà essere utilizzata anche con video in tempo reale, il che consente di difendersi dai flussi live (la tecnologia deepfake consente già di generare video in tempo reale).

Fonte

Intel Introduces Real-Time Deepfake Detector