Ci stiamo forse facendo troppo prendere la mano sul discorso Intelligenza Artificiale e distruzione del mondo?

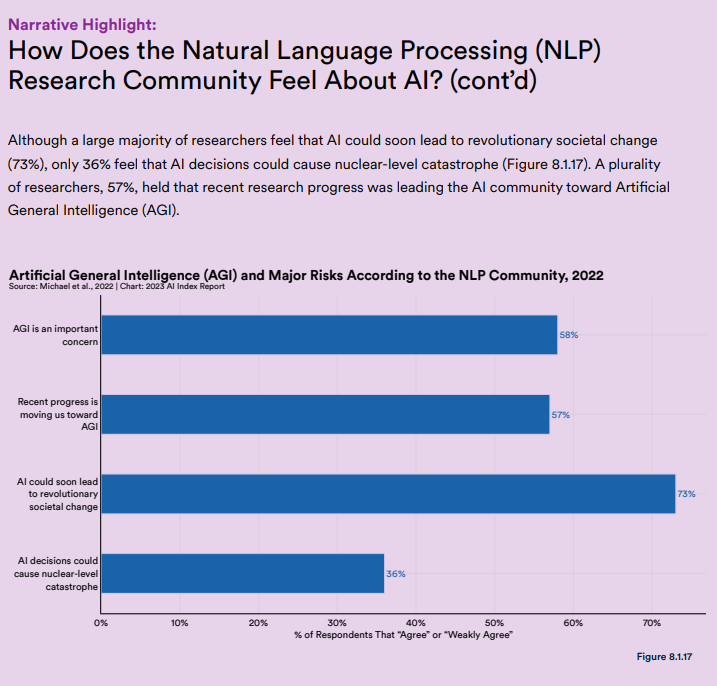

L’intelligenza artificiale può aprire la strada a nuovi audaci cambiamenti nel mondo, ma può anche portare all’olocausto nucleare se usata in modo improprio. Questa è l’opinione del 36% dei ricercatori e dei professionisti intervistati nell’ambito di uno studio dello Stanford HAI Institute.

Il sondaggio è stato condotto nell’ambito del rapporto annuale sull’intelligenza artificiale, che, di fatto, riflette lo stato attuale del settore.

La maggior parte dei partecipanti al sondaggio non crede che l’intelligenza artificiale possa rappresentare un grande pericolo nelle mani di una persona. Tuttavia, se l’IA inizia a prendere decisioni da sola, questo può sicuramente portare a conseguenze irreversibili nel tempo, questa opzione è stata supportata dalla maggior parte degli intervistati.

Secondo le statistiche pubblicamente disponibili, il numero di incidenti e controversie relativi all’IA è aumentato di 26 volte dal 2012. Alcuni incidenti di alto profilo nel 2022 includevano l’uso di video deepfake in varie situazioni, il più delle volte legate alla politica e alle relazioni internazionali.

I ricercatori ritengono che questo aumento degli incidenti sia indicativo sia dello sviluppo generale di strumenti che utilizzano l’intelligenza artificiale e sia del loro utilizzo da parte delle persone.

Secondo lo stesso rapporto, nonostante tutte le preoccupazioni, solo il 41% dei ricercatori sull’elaborazione del linguaggio naturale (PNL) ritiene che l’intelligenza artificiale dovrebbe essere realmente regolamentata.

La scorsa settimana abbiamo già parlato anche di un esperimento chiamato ChaosGPT da parte di uno dei ricercatori di intelligenza artificiale. Il ricercatore ha eliminato le limitazioni della rete neurale, chiedendole di distruggere l’umanità e stabilire il dominio globale delle macchine.

Sicuramente il mondo in questo periodo è alle prese con una novità che ancora non comprende bene, ma va da se che una tecnologia come l’intelligenza artificiale, sebbene solo agli inizi, possa portare grossi problemi al nostro mondo se mal regolamentata.