Per la serie “programmi hacker”, oggi parleremo di Growler.

Avevamo già parlato in un articolo su Red Hot Cyber, di come sia possibile effettuare “google hack” utilizzando le google dork. ma questo a lungo andare potrebbe essere ripetitivo e fastidioso.

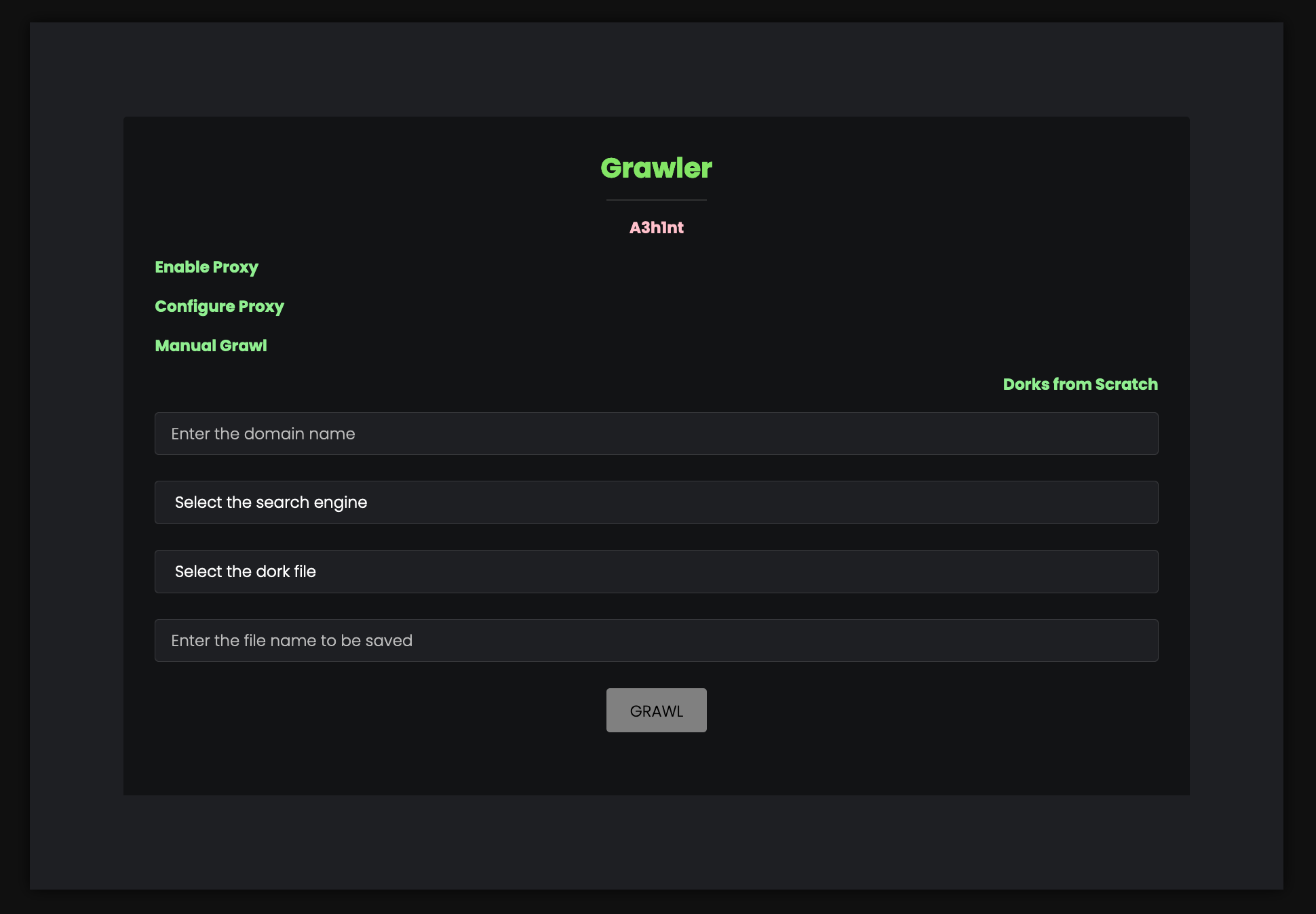

Andando a rovistare nel web, esistono diversi tool che automatizzano questa attività, e sicuramente uno strumento interessante è Grawler che automatizza le Google Dorks, effettuando ricerche, memorizzando i dati risultanti delle query effettuate.

Questo risponde anche alla domanda di moltissime persone che nel tempo avranno detto di scrivere un tool per OSINT (Open Source Intelligence) che faccia proprio questo, ma solo che per mancanza di tempo nessuno lo ha mai fatto.

Growler è scritto in PHP e viene fornito con un’interfaccia web che automatizza l’attività di utilizzo delle google dorks effettuando quindi lo scrapes da google e memorizzando i risultati all’interno di un file.

In effetti parlare solo di Google è limitato, in quanto questo tool supporta più motori di ricerca come Yahoo e Bing ed inoltre viene fornito con delle informazioni di base anche per i neofiti, che non sanno cosa sia una “dork” e quindi metterli in condizioni di poterle utilizzare al meglio.

Viene fornito con dei “contenitori” nei quali “stipare” le proprie ricerche come Filetypes, Login Pages, SQL Injections e My_dorks.

Supporta anche la gestione dei proxy per chi lo dovesse utilizzare in azienda o per chi ha qualche problemino con il suo IP address. oltre a gestire i CAPTCHA, che sono un limite conosciuto da tutti per richieste consecutive.

Infatti, Il problema più grande affrontato dagli strumenti che automatizzano google dorks è la gestione dei CAPTCHA, ma con Grawler, CAPTCHA non è più un problema, in quanto con la funzione proxy è possibile gestire anche questa cosa. I proxy supportati sono i seguenti:

Che oltretutto consentono anche piani gratuiti, seppur limitati.

Grawler supporta due diverse modalità.

Le dork sono classificate nelle seguenti categorie:

Ed inoltre

Fonte

https://github.com/A3h1nt/Grawler