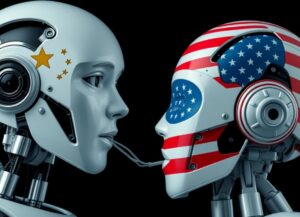

DeepSeek R1-0528: il clone cinese segreto di Google Gemini?

La scorsa settimana, il laboratorio cinese DeepSeek ha presentato una nuova versione del suo modello di intelligenza artificiale R1, denominato R1-0528. Il sistema aggiornato ha ottenuto risultati impressionanti nei test matematici e software, ma ha immediatamente suscitato un’ondata di diffidenza tra gli esperti. Il motivo è la somiglianza con i risultati tipici dell’intelligenza artificiale della linea Gemini di Google. Le fonti dei dati utilizzati per addestrare R1-0528 non sono state divulgate ufficialmente, ma alcuni indizi hanno portato i ricercatori a credere che il modello possa essere stato parzialmente addestrato sull’output di Gemini 2.5 Pro, secondo Sam Pack, uno sviluppatore che testa l’”intelligenza emotiva” dell’IA.