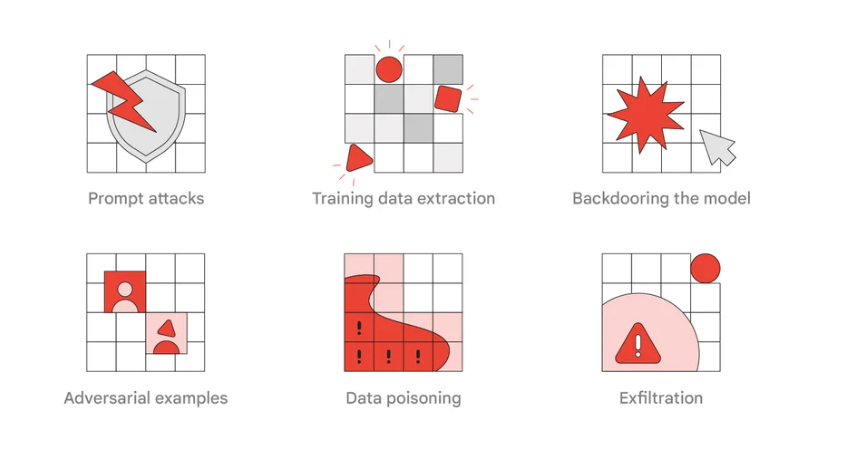

I ricercatori di Google hanno identificato 6 tipi di attacchi ai sistemi di intelligenza artificiale, tra cui la manipolazione dei modelli di linguaggio di grandi dimensioni (Large Language Model, LLM), utilizzati, ad esempio, in ChatGPT e Google Bard.

Tali attacchi possono portare a risultati imprevisti o dannosi, dalla semplice apparizione di foto di una persona comune su un sito di celebrità, a gravi violazioni della sicurezza come il phishing e il furto di dati.

Tra i vettori di attacco rilevati:

Google sottolinea l’importanza di utilizzare metodi tradizionali di sicurezza e red-teaming (Red Team) per garantire la protezione dei sistemi di intelligenza artificiale.

I ricercatori notano inoltre che la combinazione più efficace di questi metodi con competenze nel campo dell’IA crea sistemi di protezione affidabili.

Nel loro rapporto, i ricercatori hanno sottolineato che le attività di red team e le simulazioni di attacco possono svolgere un ruolo fondamentale nella preparazione di ogni organizzazione agli attacchi ai sistemi di intelligenza artificiale.