I worm autonomi stanno arrivando! Il Cybercrime 2.0 è oramai è alle porte

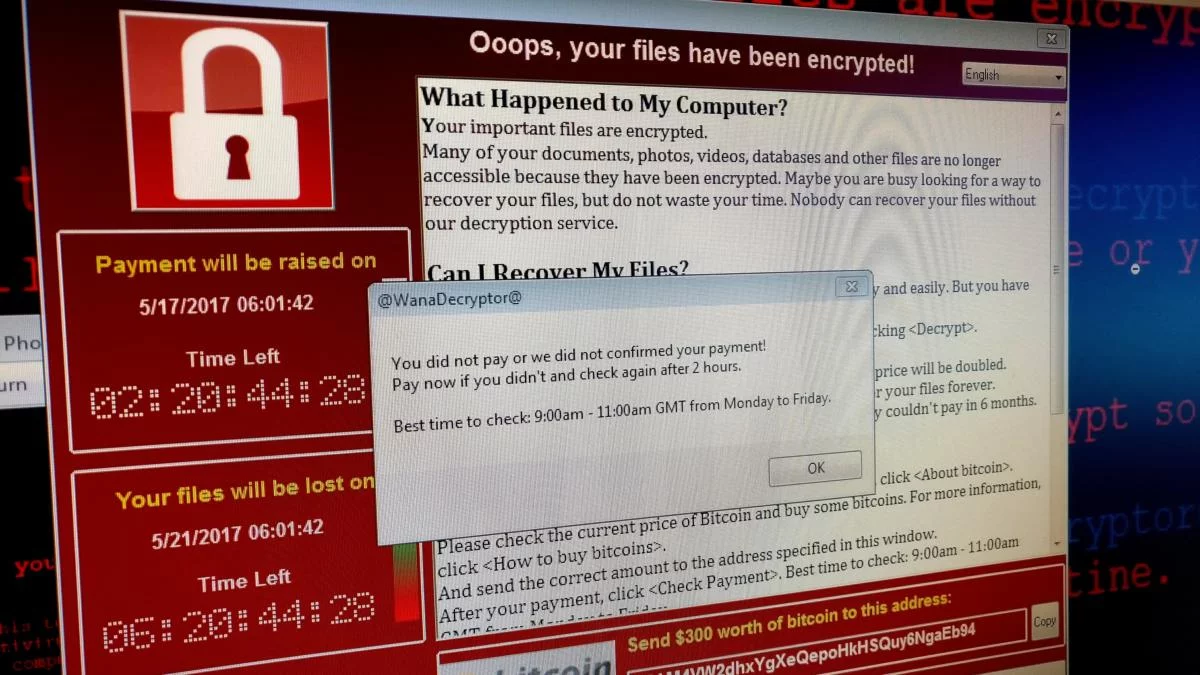

È passato tempo da quando Fred Cohen nel lontano 1983 dimostrò in un ambiente di laboratorio, come un programma informatico potesse autoreplicarsi e diffondersi all’interno di un sistema vittima. Intr...

62 milioni di utenti di Stripchat a rischio! Cosa potrebbe avvenire dopo la vendita?

La notte del 2 giugno 2026, alle 03:49, l’utente “Euphoric_Reply_5727” ha pubblicato un post nel forum underground BreachForums dove metteva in vendita i dati di Stripchat. Viene dichiarato nel post d...

La chiusura del forum underground XSS ha cambiato il mondo del cybercrime

Per due decenni, il forum clandestino XSS è rimasto un punto di riferimento fondamentale per i criminali informatici. Qui si cercavano complici, si vendevano gli accessi e si discuteva su malware, phi...

FBI, NSA e CISA avvertono degli attacchi ai serbatoi ATG. Lo spettro di Colonial Pipeline allarma gli USA

Le agenzie federali statunitensi, tra cui l’FBI e la NSA, stanno mettendo in guardia contro un’impennata di attacchi informatici mirati ai sistemi automatici di misurazione del livello del carburante ...

Terrorismo 4.0: come l’Intelligenza Artificiale sta cambiando la propaganda estremista

L’intelligenza artificiale non sta “rimpiazzando” il terrorismo di vecchia scuola, ma ne sta alterando il metabolismo. Gli elementi a supporto, al momento, non si riferiscono agli scenari fantascienti...

Un solo notebook può portare al collasso dei server. Trovato un bug che colpisce mezzo internet

Una nuova vulnerabilità, denominata HTTP/2 Bomb, è stata scoperta da ricercatori di Calif che permette di sovraccaricare la memoria dei popolari web server come Apache, Nginx e Microsoft IIS in pochi ...

Huawei ringrazia gli Stati Uniti per le sanzioni! Ma gli analisti USA a cosa pensavano nel 2019?

Noi di RHC lo abbiamo sempre sostenuto che il percorso delle sanzioni verso la Cina e la Russia non avrebbero fatto altro che potenziare questi stati piuttosto che gli Stati Uniti d’America. Pertanto ...

NVIDIA vuole reinventare il PC ma non ha tempo per le console dei videogiochi

Nvidia, che tempo fa otteneva la maggior parte dei suoi ricavi dal mercato dei videogiochi, ha cercato di trovare applicazioni per i suoi processori centrali Tegra creando dispositivi portatili. Oggi,...

Glassworm: la botnet che ha infettato gli sviluppatori ora è stata smantellata

CrowdStrike ha annunciato lo smantellamento della botnet Glassworm, che attaccava gli sviluppatori tramite estensioni per editor di codice, pacchetti npm e Python e infettava repository GitHub. L’oper...

Red Hat vittima di attacco alla Suppy Chain: cos’è successo e cosa imparare

L’ecosistema Red Hat è stato colpito da un attacco alla supply chain.Degli aggressori sconosciuti hanno compromesso l’infrastruttura di pubblicazione dei pacchetti @redhat-cloud-services e pubblicato ...

Articoli più letti dei nostri esperti

Chi proteggerà le reti quando RSA smetterà di funzionare?

E se domani gli USA spegnessero il cloud? KDE riceve 1,3 milioni dalla Germania

I worm autonomi stanno arrivando! Il Cybercrime 2.0 è oramai è alle porte

Massimiliano Brolli - 6 Giugno 2026

Caricabatterie elettrici a rischio: Nuovi bug scoperti dai ricercatori sugli XCharge C6

Carolina Vivianti - 6 Giugno 2026

Trump considera il direttore di Palantir Shyam Sankar per guidare il CISA

Luigi Zullo - 6 Giugno 2026

62 milioni di utenti di Stripchat a rischio! Cosa potrebbe avvenire dopo la vendita?

Chiara Nardini - 5 Giugno 2026

La chiusura del forum underground XSS ha cambiato il mondo del cybercrime

Chiara Nardini - 5 Giugno 2026

FBI, NSA e CISA avvertono degli attacchi ai serbatoi ATG. Lo spettro di Colonial Pipeline allarma gli USA

Carolina Vivianti - 5 Giugno 2026

Terrorismo 4.0: come l’Intelligenza Artificiale sta cambiando la propaganda estremista

Massimo Dionisi - 5 Giugno 2026

Un solo notebook può portare al collasso dei server. Trovato un bug che colpisce mezzo internet

Carolina Vivianti - 5 Giugno 2026

Huawei ringrazia gli Stati Uniti per le sanzioni! Ma gli analisti USA a cosa pensavano nel 2019?

Luigi Zullo - 5 Giugno 2026

Rapid7 Labs scopre buffer overflow pericoloso nel telefono HP Poly VVX 450

Luigi Zullo - 4 Giugno 2026

Ultime news

I worm autonomi stanno arrivando! Il Cybercrime 2.0 è oramai è alle porte

Caricabatterie elettrici a rischio: Nuovi bug scoperti dai ricercatori sugli XCharge C6

Trump considera il direttore di Palantir Shyam Sankar per guidare il CISA

62 milioni di utenti di Stripchat a rischio! Cosa potrebbe avvenire dopo la vendita?

La chiusura del forum underground XSS ha cambiato il mondo del cybercrime

FBI, NSA e CISA avvertono degli attacchi ai serbatoi ATG. Lo spettro di Colonial Pipeline allarma gli USA

Terrorismo 4.0: come l’Intelligenza Artificiale sta cambiando la propaganda estremista

Un solo notebook può portare al collasso dei server. Trovato un bug che colpisce mezzo internet

Huawei ringrazia gli Stati Uniti per le sanzioni! Ma gli analisti USA a cosa pensavano nel 2019?

Rapid7 Labs scopre buffer overflow pericoloso nel telefono HP Poly VVX 450

NVIDIA vuole reinventare il PC ma non ha tempo per le console dei videogiochi

Scopri come un clic su Windows può riuscire a compromettere i tuoi dati

Scopri le ultime CVE critiche emesse e resta aggiornato sulle vulnerabilità più recenti. Oppure cerca una specifica CVE