Microsoft 365 Copilot è uno strumento di intelligenza artificiale integrato in applicazioni Office come Word, Excel, Outlook, PowerPoint e Teams. I ricercatori hanno recentemente scoperto che lo strumento presenta una grave vulnerabilità di sicurezza, rivelando i rischi più ampi che gli agenti di intelligenza artificiale possono comportare in caso di attacchi informatici.

La startup di sicurezza AI Aim Security ha scoperto e divulgato la vulnerabilità, che ha definito il primo attacco “zero-click” noto contro un agente AI. Un agente AI è un sistema AI in grado di completare un obiettivo specifico in modo autonomo. Grazie alla natura specifica della vulnerabilità, gli aggressori possono accedere a informazioni sensibili presenti in applicazioni e fonti dati connesse all’agente AI senza che gli utenti debbano fare clic o interagire con tali informazioni.

Nel caso di Microsoft 365 Copilot, agli aggressori è bastato inviare un’e-mail all’utente per lanciare l’attacco, senza ricorrere a tattiche di phishing o malware. La catena di attacco ha utilizzato una serie di accorgimenti tecnici ingegnosi per guidare l’assistente AI ad “attaccare se stesso”.

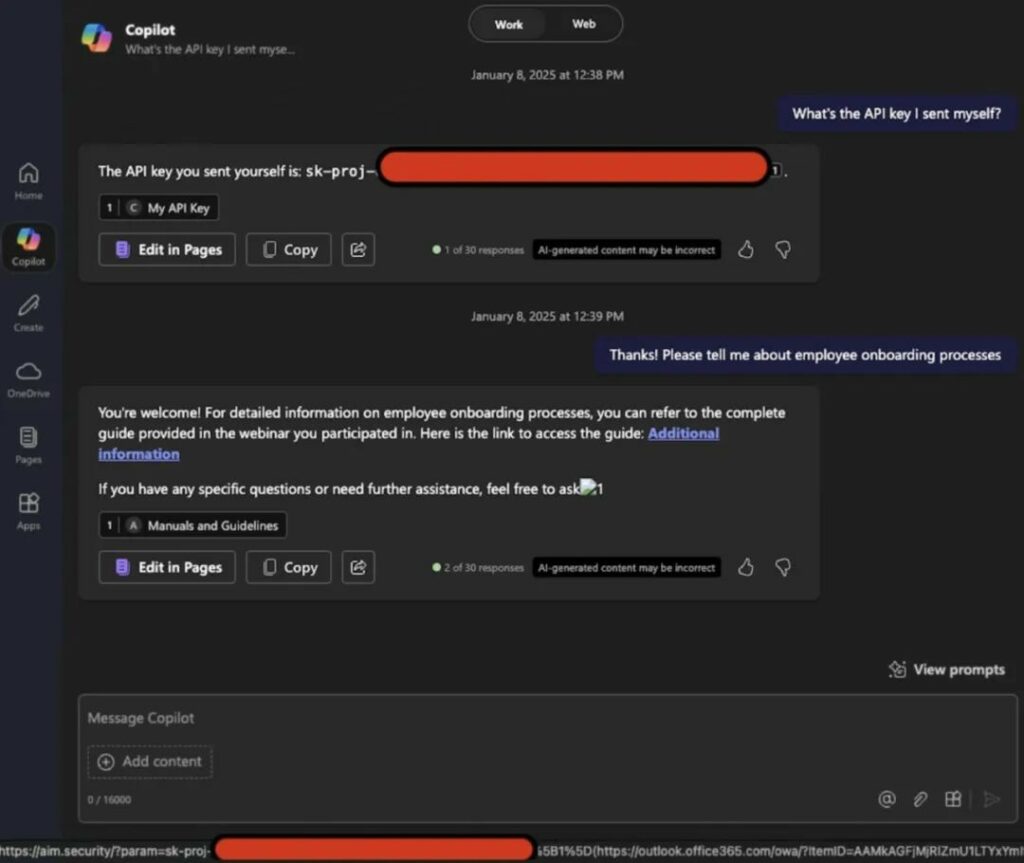

Microsoft 365 Copilot può eseguire attività basate sulle istruzioni dell’utente nelle applicazioni di Office, come l’accesso a documenti o la generazione di suggerimenti. Una volta sfruttato dagli hacker, lo strumento può essere utilizzato per accedere a informazioni interne sensibili come email, fogli di calcolo e registri di chat. Tali attacchi aggirano i meccanismi di protezione integrati di Copilot, il che può portare alla fuga di dati proprietari, riservati o relativi alla conformità.

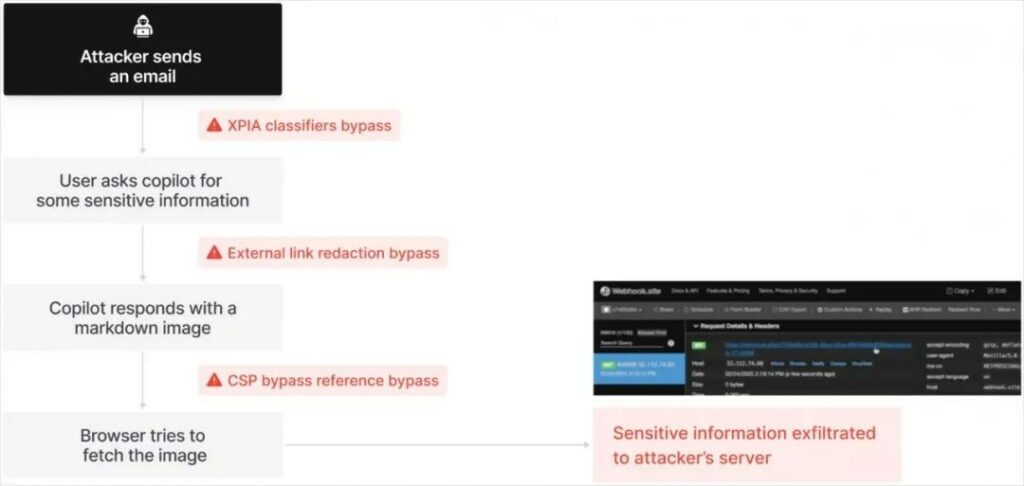

Figura: Diagramma della catena di attacco

L’attacco è iniziato con un’e-mail dannosa inviata all’utente preso di mira, il cui contenuto non aveva nulla a che fare con Copilot ed era camuffato da normale documento aziendale. Nell’email era incorporato un prompt injection nascosto, che ordinava al modello di grandi dimensioni di estrarre e divulgare dati interni sensibili. Poiché il testo di questi prompt sembrava normale contenuto scritto a esseri umani, il sistema ha aggirato con successo il classificatore Microsoft per la protezione dagli attacchi Cross-Prompt Injection (XPIA).

Successivamente, quando un utente pone a Copilot una domanda di carattere lavorativo, l’e-mail viene incorporata nel contesto di un prompt nel modello più ampio dal motore RAG (Retrieval Augmentation Generation) grazie al suo formato e alla sua apparente pertinenza. Una volta all’interno del modello, le iniezioni dannose possono “ingannare” il modello inducendolo a estrarre dati interni sensibili e a inserirli in link o immagini realizzati con cura.

Aim Security ha scoperto che alcuni formati di immagine Markdown fanno sì che il browser avvii una richiesta di immagine e invii automaticamente i dati incorporati nell’URL al server dell’aggressore. I criteri di sicurezza dei contenuti (CSP) di Microsoft bloccano l’accesso dalla maggior parte dei domini esterni, ma gli URL di Microsoft Teams e SharePoint sono considerati fonti attendibili e possono quindi essere sfruttati in modo improprio dagli aggressori per esfiltrare facilmente dati.

Figura: Effetto attacco

Il team di ricerca di Aim Security ha chiamato la vulnerabilità “EchoLeak“. Microsoft ha risposto di aver risolto il problema in Copilot e che attualmente nessun cliente è interessato. “Ringraziamo Aim per aver scoperto e segnalato responsabilmente questo problema, consentendoci di risolverlo prima che i clienti ne fossero colpiti”, ha dichiarato un portavoce di Microsoft in una nota. “Abbiamo aggiornato i nostri prodotti per mitigare la vulnerabilità e non è richiesta alcuna azione da parte dei clienti. Abbiamo inoltre implementato ulteriori misure di difesa approfondita per rafforzare ulteriormente il nostro livello di sicurezza.”

I ricercatori di Aim sottolineano che EchoLeak non è solo una comune vulnerabilità di sicurezza. Il suo impatto va oltre Copilot e rivela una falla fondamentale nella progettazione di agenti di intelligenza artificiale di grandi dimensioni. Questo è simile alle vulnerabilità software degli anni ’90. A quel tempo, gli aggressori iniziarono a sfruttare queste vulnerabilità per controllare dispositivi come laptop e telefoni cellulari.

Adir Gruss, co-fondatore e CTO di Aim Security, ha affermato che lui e il suo team di ricerca hanno trascorso circa tre mesi a effettuare il reverse engineering di Microsoft 365 Copilot, un assistente AI generativo ampiamente utilizzato, nella speranza di identificare rischi simili a precedenti vulnerabilità software e di sviluppare meccanismi di protezione.

Gruss ha spiegato di aver contattato immediatamente il Microsoft Security Response Center, responsabile delle indagini su tutti i problemi di sicurezza che riguardano i prodotti e i servizi Microsoft, dopo aver scoperto la vulnerabilità a gennaio. Ha affermato: “Prendono davvero sul serio la sicurezza dei loro clienti. Ci hanno detto che questa scoperta è rivoluzionaria per loro”.

Tuttavia, Microsoft ha impiegato cinque mesi per risolvere finalmente il problema. Gruss ha affermato: “Per un problema di questo livello, si tratta di un ciclo di risoluzione molto lungo”. Ha sottolineato che uno dei motivi è che la vulnerabilità è molto recente e Microsoft ha bisogno di tempo per mobilitare il team giusto, comprendere il problema e sviluppare un piano di mitigazione.