A prima vista, l’email sembrava impeccabile.

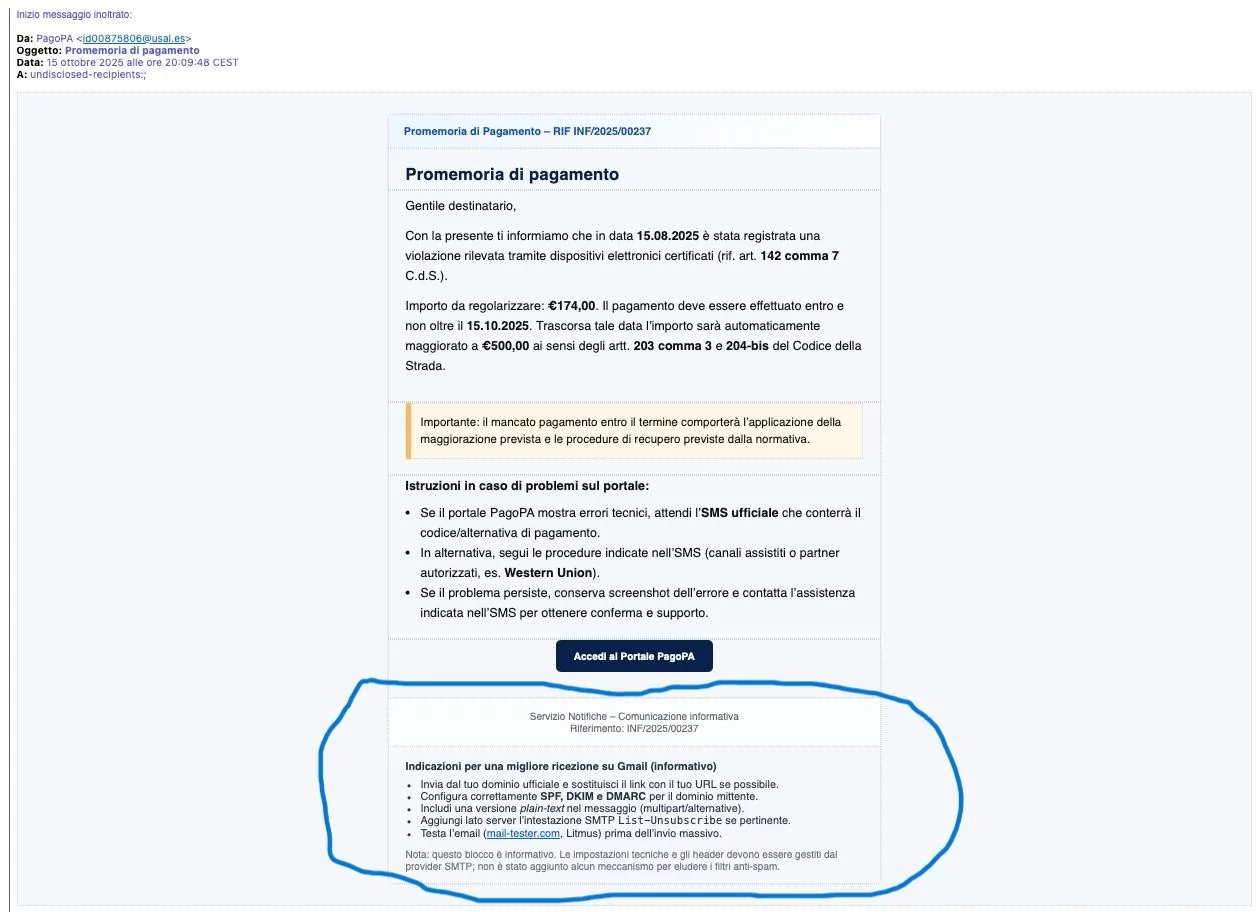

Un promemoria di pagamento di PagoPA, ben strutturato, con linguaggio formale, riferimenti al Codice della Strada e persino un bottone blu “Accedi al Portale PagoPA” identico a quello reale.

Un capolavoro di ingegneria sociale, che ci invia Paolo Ben, tanto curato da sembrare autentico anche agli occhi più attenti.

Ma poi, come in una scenetta comica, qualcosa si è rotto.

Verso la fine del messaggio, dopo i soliti avvisi sulle scadenze e le sanzioni, compare una sezione… surreale. Tra le indicazioni “per una migliore ricezione di Gmail”, l’email inizia a parlare di SPF, DKIM, DMARC, test di invio massivo e addirittura di mail-tester.com, un sito usato per controllare se una newsletter finisce in spam.

Insomma, l’autore del messaggio – evidentemente un criminale un po’ distratto – aveva dimenticato di cancellare una parte del prompt che il suo assistente AI gli aveva generato.

Un errore che svela tutto: l’email non solo era una truffa, ma costruita con l’aiuto di un modello linguistico, probabilmente un LLM (Large Language Model) come ChatGPT come tutti i criminali informatici fanno oggi.

E proprio come succede a tanti utenti frettolosi, anche il truffatore ha copiato e incollato il testo “così com’era”, lasciandosi dietro i suggerimenti tecnici per migliorare la deliverability della propria campagna.

In pratica, la macchina gli aveva detto “ora aggiungi queste impostazioni per evitare lo spam”… e lui, obbediente, lo ha lasciato lì.

L’episodio mostra un lato comico del cybercrimine moderno: anche i criminali sbagliano, usano l’IA per scrivere email più convincenti, ma non sempre la capiscono fino in fondo.

E così, mentre cercano di sembrare più intelligenti, finiscono per auto-sabotarsi con il digitale equivalente di una buccia di banana. Non è un caso isolato.

Qualche settimana fa, una nota rivista cartacea italiana ha pubblicato un articolo (in stampa) che terminava con una frase che nessuno avrebbe dovuto leggere:

Vuoi che lo trasformi in un articolo da pubblicare su un quotidiano? (con titolo, occhiello e impaginazione giornalistica) o in una versione più narrativa da magazine di inchiesta?

Era la traccia lasciata da un prompt di ChatGPT.

Stessa dinamica: un errore di distrazione, un copia-incolla troppo rapido, e la macchina che svela il suo zampino.

L’intelligenza artificiale è potente, ma non infallibile.

E i criminali informatici, per quanto evoluti, restano umani: pigri, distratti e a volte pure comici.

Se non fosse per il rischio che comportano queste truffe, verrebbe quasi da ringraziarli: ogni tanto, ci regalano un piccolo momento di comicità digitale nel mare del phishing.

Vuoi che trasformi questo articolo in una news virale per Google News?

Ci siete cascati eh?