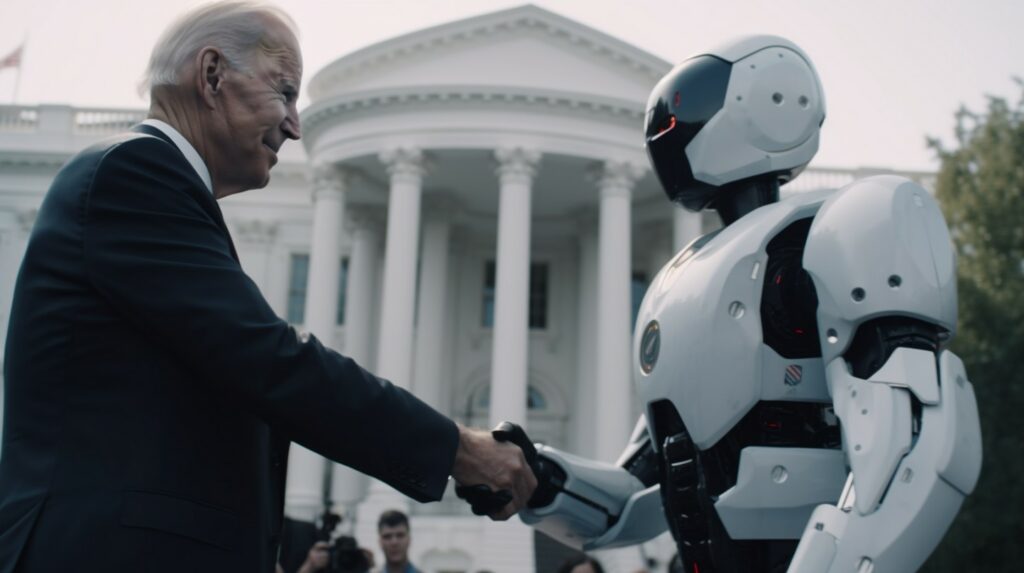

Joe Biden, l’attuale presidente degli Stati Uniti D’America sta cercando di ridurre i rischi legati all’intelligenza artificiale (AI) che può generare in un prossimo futuro. Tutto questo si è trasformato di un nuovo ordine esecutivo che è stato emesso nella giornata di ieri dalla Casa Bianca.

Biden ha detto: “Per realizzare la promessa dell’intelligenza artificiale ed evitare i rischi, dobbiamo governare questa tecnologia. Nelle mani sbagliate l’intelligenza artificiale può rendere più facile per gli hacker sfruttare le vulnerabilità del software che fa funzionare la nostra società.”

Pertanto ha richiesto agli sviluppatori AI che creano sistemi di sicurezza nazionale, economia, salute, ecc… di collaborare co il governo degli Stati Uniti. Sarà quindi necessaria la condivisione dei test di sicurezza svolti dalle aziende con il governo, prima della diffusione pubblica.

La mossa è l’ultimo passo dell’amministrazione per definire i parametri relativi all’intelligenza artificiale. Questo perché l’IA sta ottenendo rapidi guadagni in capacità e popolarità in un ambiente di regolamentazione molto limitato. L’ordinanza ha suscitato risposte contrastanti da parte dell’industria e dei gruppi commerciali.

Inoltre, c’è la necessità di stabilire da parte delle agenzie statunitensi dei nuovi standard per affrontare rischi chimici, biologici, radiologici, nucleari e di sicurezza informatica.

Recentemente la Cina ha ha pubblicato una proposta di requisiti di sicurezza per le aziende che forniscono servizi di intelligenza artificiale generativa. Inoltre ha definito delle soglie di usabilità dei prodotti che possono contenere fino ad un massimo del 5% di output dannosi.

Drew Bagley, VP & Counsel, Privacy and Cyber Policy di CrowdStrike ha riportato: “Troviamo incoraggiante il fatto che il nuovo ordine esecutivo spinga verso principi comuni di intelligenza artificiale (AI). L’IA ha da tempo trasformato la tecnologia moderna, ma i recenti sviluppi hanno abbassato la barriera d’ingresso sia per gli innovatori che per gli avversari. Ciò è particolarmente vero nel campo della sicurezza informatica, dove i difensori devono affidarsi all’IA per rilevare e prevenire i cyberattacchi su scala, in un’epoca dominata da attacchi senza malware e da exploit zero-day. Gli avversari continuano a manifestare interesse nello sfruttare modelli linguistici di grandi dimensioni (LLM) per muoversi più rapidamente e scalare le proprie operazioni. Oltre ai cyberattacchi, in vista delle elezioni del 2024, le campagne di disinformazione guidate dall’IA sono particolarmente preoccupanti per il nostro settore e le stiamo osservando da vicino. In definitiva, è fondamentale che l’IA possa e debba essere sfruttata in modo responsabile. L’interfaccia in linguaggio naturale degli attuali LLM (Large Language Model) ha il potenziale per rendere i ruoli e le responsabilità della cybersecurity più ampiamente accessibili. Questo contribuisce a colmare il divario di competenze in materia di cybersecurity e a migliorare i tempi di risposta, in modo che i difensori possano stare davanti agli avversari – incrementando la sicurezza proattiva in tutte le organizzazioni e le agenzie. Ecco perché investire nell’innovazione responsabile dell’IA è più che mai fondamentale”.

Il nuovo ordine va oltre gli impegni volontari assunti all’inizio di quest’anno da società di intelligenza artificiale come OpenAI, Alphabet GOOGL.O e Meta Platform. Ora occorre un reale cambio di passo all’interno della produzione di una tecnologia che sta sfuggendo di mano.

Scrittori e artisti visivi di spicco hanno intentato numerose cause legali accusando le aziende che producono AI di furto. Le aziende tecnologiche sostengono che il loro utilizzo dei contenuti è protetto dalla dottrina del “fair use” della legge statunitense sul copyright.

Ricordiamo anche che maggio, Samuel Harris CEO di OpenAI si è recato al Senato a Washington, DC, con un appello urgente ai legislatori. Altman ha detto: create regolamenti ponderati che abbraccino la potente promessa dell’intelligenza artificiale – Mitigando contemporaneamente il rischio di superare l’umanità.”