I modelli linguistici di grandi dimensioni (LLM) sono algoritmi avanzati di deep learning in grado di analizzare indizi in diverse lingue, generando successivamente risposte realistiche.

Non devi cercare lontano per trovare degli esempi. ChatGPT può rispondere rapidamente a un’ampia gamma di domande degli utenti e generare contenuti scritti accattivanti. Questo per molti scopi.

Gli scienziati della New York University hanno condotto uno studio per valutare l’efficacia di due modelli linguistici addestrati a riconoscere il sarcasmo nelle persone.

L’analisi del sentiment è un campo di studio che prevede l’analisi di testi tipicamente pubblicati sui social media o altri siti web. Ciò ti consente di avere un’idea di come si sentono le persone riguardo a un determinato argomento. Oggi molte aziende stanno investendo in quest’area perché può aiutarle a capire come migliorare i propri servizi e soddisfare le esigenze dei clienti.

Esistono diversi modelli in grado di elaborare i testi e prevederne il tono emotivo sottostante. Tuttavia, molte recensioni e commenti pubblicati online contengono ironia e sarcasmo, il che può indurre le modelle a classificarli come “positivi” quando in realtà esprimono emozioni negative, o viceversa.

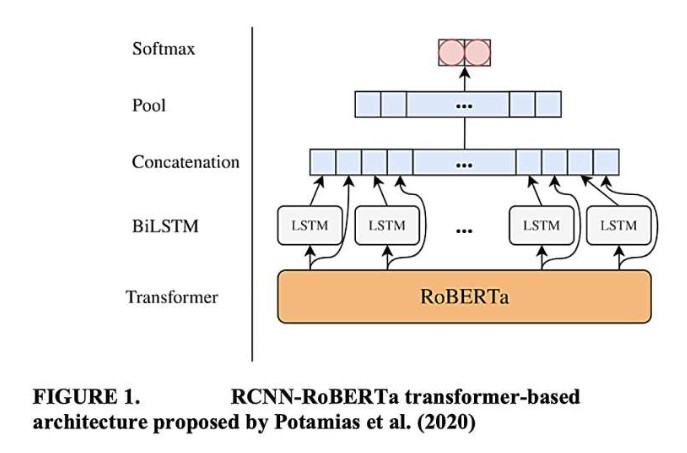

Pertanto, gli scienziati stanno cercando di sviluppare modelli in grado di rilevare il sarcasmo nei testi scritti. Due dei modelli più promettenti, chiamati CASCADE e RCNN-RoBERTa, sono stati presentati nel 2018 da gruppi di ricerca separati.

I ricercatori hanno condotto una serie di test volti a valutare la capacità del modello CASCADE e di RCNN-RoBERTa di rilevare il sarcasmo nei commenti pubblicati su Reddit. Una nota piattaforma online comunemente utilizzata per valutare contenuti e discutere vari argomenti.

La capacità di questi due modelli di rilevare il sarcasmo nei testi campione è stata anche confrontata con la prestazione umana media nello stesso compito e con la prestazione di diversi modelli di text mining di base.